本文為英文版的機器翻譯版本,如內容有任何歧義或不一致之處,概以英文版為準。

SageMaker HyperPod 配方

Amazon SageMaker HyperPod 配方是由 提供的預先設定訓練堆疊 AWS ,可協助您從 Llama、Mistral、Mixtral 或 DeepSeek 等各種模型系列快速開始訓練和微調公開可用的基礎模型 (FMs)。這些配方可自動化端對端訓練迴圈,包括載入資料集、套用分散式訓練技術,以及管理檢查點以更快速地從故障中復原。

SageMaker HyperPod 配方特別有益於可能沒有深度機器學習專業知識的使用者,因為他們可簡化訓練大型模型所涉及的許多複雜性。

您可以在 SageMaker HyperPod 內或作為 SageMaker 訓練任務執行配方。

下列資料表保留在 SageMaker HyperPod GitHub 儲存庫中,並提供有關支援進行預先訓練和微調的模型、其各自配方及啟動指令碼,支援的執行個體類型等的最新資訊。

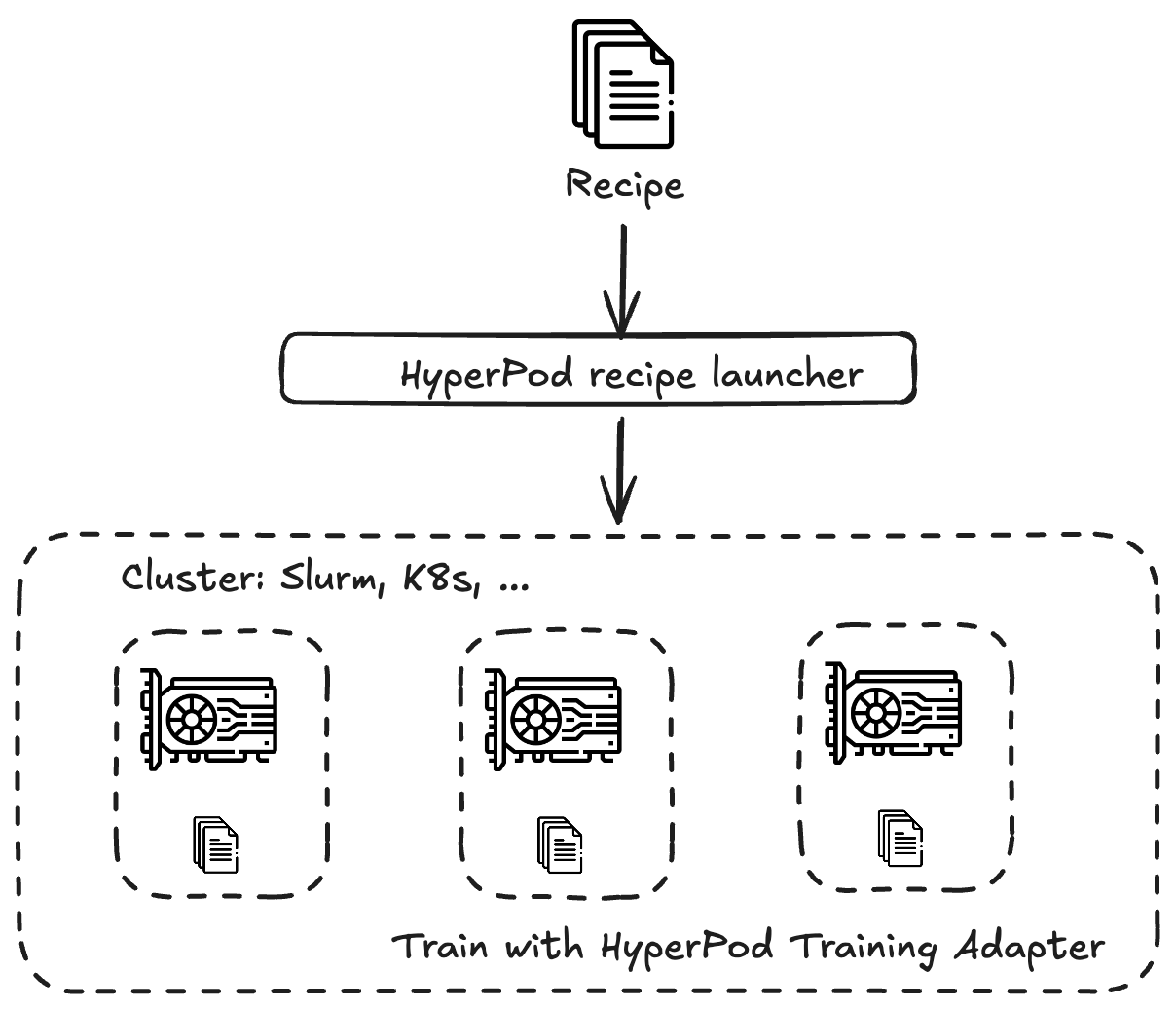

對於 SageMaker HyperPod 使用者,端對端訓練任務流程的自動化來自訓練轉接器與 SageMaker HyperPod 配方的整合。訓練轉接器是建置在 NVIDIA NeMo 架構

您也可以定義自己的自訂配方來訓練自己的模型。

若要開始使用教學課程,請參閱教學。