Le traduzioni sono generate tramite traduzione automatica. In caso di conflitto tra il contenuto di una traduzione e la versione originale in Inglese, quest'ultima prevarrà.

Modelli di orchestrazione: da quelli basati su regole a quelli nativi per l'intelligenza artificiale

Nei sistemi di intelligenza artificiale serverless basati sugli eventi, l'orchestrazione è la logica connettiva che determina il modo in cui gli eventi attivano e modellano il comportamento del sistema. Nel AWS, l'orchestrazione può seguire due modelli principali:

-

L'orchestrazione basata su regole viene definita dagli sviluppatori utilizzando flussi di lavoro e macchine a stati.

-

L'orchestrazione nativa dell'intelligenza artificiale è basata su agenti e modelli di linguaggio di grandi dimensioni (LLMs) che ragionano, pianificano e agiscono in base all'intento e al contesto.

Ogni modello svolge un ruolo distinto nella creazione di sistemi flessibili, reattivi e intelligenti. Insieme, consentono agli sviluppatori di passare dall'automazione procedurale a sistemi autonomi e orientati agli obiettivi.

Orchestrazione basata su regole con AWS Step Functions

Step Functions fornisce un motore di flusso di lavoro visivo per orchestrare servizi come AWS Lambda Amazon, SageMaker Amazon Bedrock, Amazon DynamoDB e Amazon Simple Storage Service (Amazon S3). La logica è deterministica in quanto i passaggi sono definiti in modo esplicito e le transizioni sono basate sulle condizioni.

I vantaggi principali dell'orchestrazione basata su regole con Step Functions includono quanto segue:

-

Elevata verificabilità e visibilità tramite una console visiva per il flusso di lavoro

-

Gestione degli errori, nuovi tentativi e parallelismo integrati

-

Ideale per flussi di controllo lineari o ramificati con percorsi ben definiti

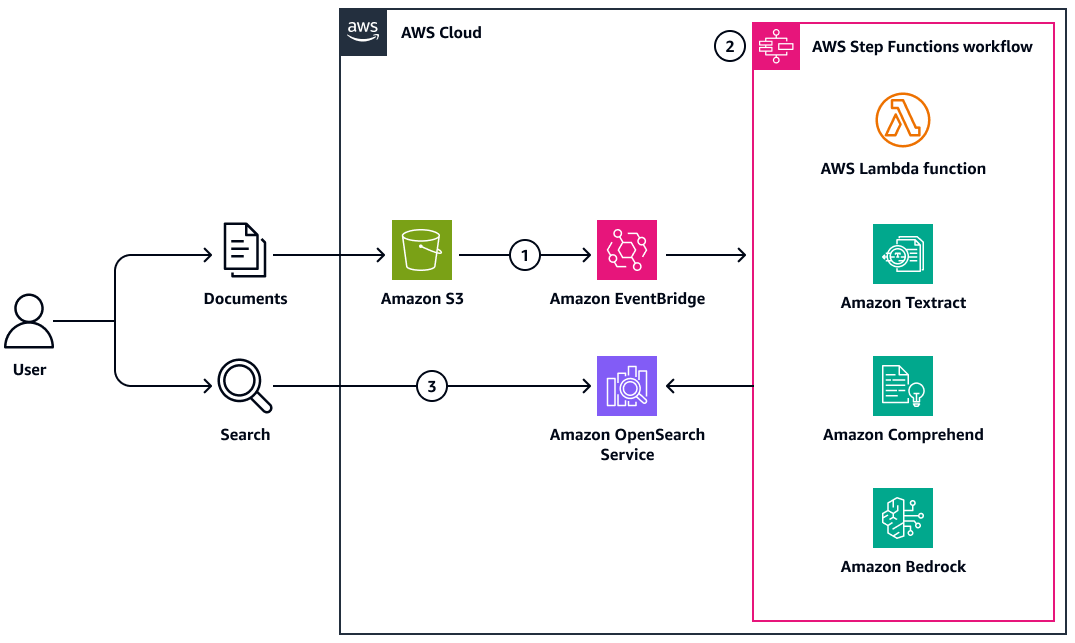

Il diagramma seguente mostra il flusso di lavoro di un esempio di inserimento ed elaborazione di documenti.

In questo esempio, uno studio legale automatizza l'analisi dei contratti caricati nei seguenti passaggi:

-

Attivazione di eventi: i documenti legali vengono caricati in un bucket Amazon S3, che attiva un evento EventBridge Amazon, che viene indirizzato a un flusso di lavoro Step Functions.

-

Workflow — Step Functions esegue le seguenti operazioni:

-

Elaborazione dei documenti: una funzione Lambda pulisce ed esegue il riconoscimento ottico iniziale dei caratteri (OCR) sul documento.

-

Estrazione del testo: Amazon Textract estrae testo e dati chiave dal documento.

-

Analisi: Amazon Comprehend analizza il testo per classificare i livelli di rischio e il sentiment.

-

Riepilogo: Amazon Bedrock genera un riepilogo conciso del contratto.

-

Archiviazione dei dati: i risultati vengono scritti su Amazon OpenSearch Service per l'indicizzazione.

-

-

Recupero: il team legale può cercare, filtrare e visualizzare l'analisi dei contratti tramite dashboard.

Questa architettura sfrutta le funzionalità di integrazione AWS SDK di Step Functions per interagire direttamente con ciascun componente del flusso Servizio AWS di lavoro. Questo approccio riduce la complessità ed elimina la necessità di funzioni Lambda separate tra ogni fase di elaborazione. La scrittura finale su OpenSearch Service viene gestita anche tramite l'integrazione SDK. Di conseguenza, Step Functions può indicizzare i risultati dell'analisi dei documenti, le classificazioni dei rischi, l'analisi del sentiment e i riepiloghi generati dall'intelligenza artificiale direttamente in Service. OpenSearch Il team legale può accedere alle informazioni tramite dashboard per cercare, filtrare e visualizzare l'analisi dei contratti.

Ogni attività è uno stato definito con gestione degli errori integrata. L'IA non prende alcuna decisione e l'orchestrazione è esplicita.

Orchestrazione nativa dell'intelligenza artificiale con Amazon Bedrock Agents

Laddove Step Functions gestisce il modo in cui le cose accadono, gli agenti di Amazon Bedrock decidono cosa deve succedere in base agli obiettivi degli utenti. Uno o più agenti Amazon Bedrock basati su Amazon Bedrock AgentCore combinano quanto segue:

-

Un set di integrazioni di strumenti come le funzioni Lambda (o il client Model Context Protocol (MCP) per eseguire integrazioni MCP)

-

Basi di conoscenza opzionali per la base contestuale

-

Memoria integrata e tracciamento degli obiettivi

Gli agenti interpretano l'input in linguaggio naturale, lo ragionano e richiamano autonomamente gli strumenti per soddisfare le intenzioni dell'utente, scaricando la logica di orchestrazione sul modello.

I vantaggi principali dell'orchestrazione nativa dell'intelligenza artificiale con Amazon Bedrock Agents includono quanto segue:

-

Flessibilità semantica: interpreta diversi input in linguaggio naturale.

-

Autonomia degli strumenti: seleziona gli strumenti giusti in fase di esecuzione.

-

Fondamento contestuale: cita con precisione i contenuti della knowledge base.

-

Manutenzione minima per gli sviluppatori: definisci gli strumenti e non il flusso.

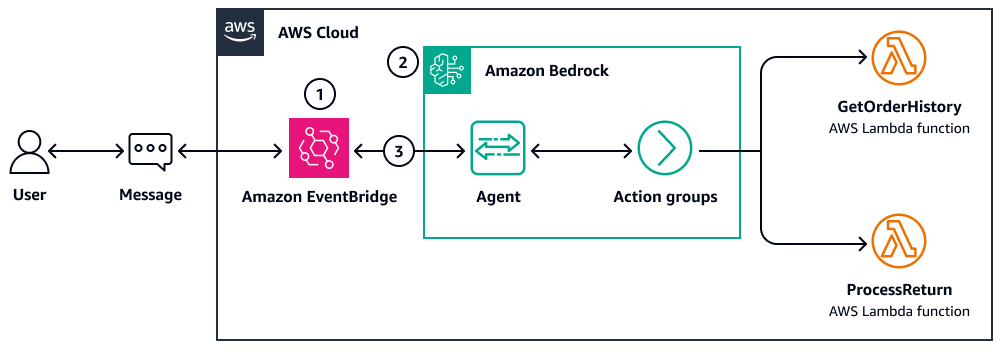

Il diagramma seguente mostra il flusso di lavoro di un esempio di automazione dell'assistenza clienti con Amazon Bedrock Agents.

In questo esempio, un utente di un sito web di vendita al dettaglio digita un messaggio nel chatbot di supporto. Si verifica il seguente flusso di lavoro:

-

Le azioni di attivazione dell'evento sono le seguenti:

-

L'utente invia un messaggio: «Devo restituire le scarpe che ho ordinato la settimana scorsa. Puoi aiutarmi?»

-

Il messaggio viene ricevuto e inoltrato EventBridge.

-

EventBridge attiva l'agente Amazon Bedrock.

-

-

Il processo di ragionamento dell'agente è il seguente:

-

Estrazione dell'intento: l'agente identifica l'intento come «ordine di restituzione».

-

Recupero dati: l'agente interroga il sistema CRM utilizzando la funzione Lambda.

GetOrderHistory -

Controllo dell'idoneità: l'agente chiama la funzione

ProcessReturnLambda per verificare l'idoneità alla restituzione. -

Generazione di risposte: l'agente formula la risposta appropriata.

-

-

L'azione di comunicazione con il cliente si verifica quando l'agente risponde «Il reso è in fase di elaborazione. Aspettatevi un'e-mail di conferma a breve».

L'intero flusso di lavoro dimostra come Amazon Bedrock Agents orchestra una logica di business complessa attraverso gruppi di azioni definiti. Collegando le intenzioni del cliente ai sistemi e ai processi di backend, offre un'esperienza di assistenza clienti automatizzata ma contestualmente appropriata.

Amazon Bedrock AgentCore estende l'ecosistema Amazon Bedrock oltre i singoli agenti per fornire un'architettura di runtime e memoria completa per sistemi di intelligenza artificiale autonomi e basati sugli eventi.

Gli agenti Amazon Bedrock si concentrano sull'orchestrazione di sequenze di ragionamenti e azioni per una singola attività o dominio. AgentCore fornisce l'infrastruttura sottostante per comporre, coordinare e mantenere flussi di lavoro multiagente in ambienti serverless distribuiti.

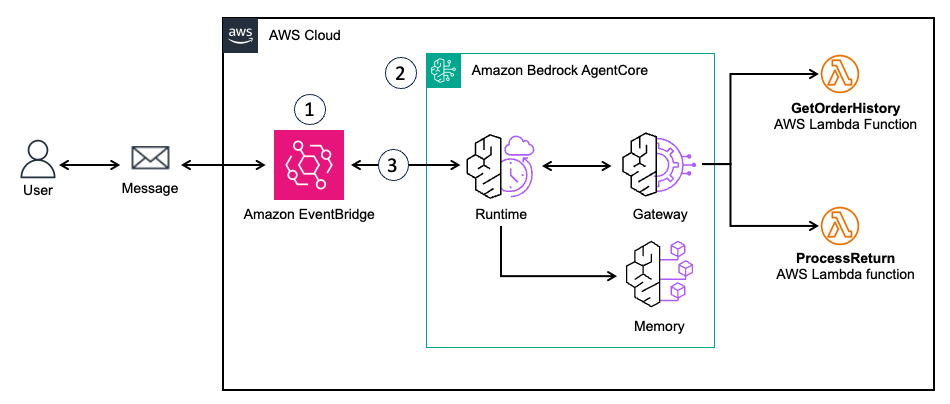

Il diagramma seguente mostra il flusso di lavoro di un esempio di automazione dell'assistenza clienti con. AgentCore

Questo esempio segue le stesse azioni del precedente esempio di Amazon Bedrock Agents: un utente su un sito Web di vendita al dettaglio digita un messaggio nel chatbot di supporto. Si verifica il seguente flusso di lavoro:

-

L'utente invia un messaggio: «Devo restituire le scarpe che ho ordinato la settimana scorsa. Puoi aiutarmi?»

-

Il messaggio viene ricevuto e inoltrato EventBridge.

-

EventBridge attiva l'endpoint AgentCore Runtime.

AgentCore introduce tre funzionalità chiave che completano i modelli di orchestrazione esistenti:

-

AgentCore Runtime: un ambiente di esecuzione gestito per l'esecuzione di una logica di agente personalizzata all'interno. AWS Si integra nativamente con AWS Lambda Amazon ECS per scalare il comportamento degli agenti su richiesta, eliminando la necessità di gestire manualmente container o infrastrutture funzionali.

-

AgentCore Memoria: fornisce uno storage persistente e strutturato per il contesto, lo stato e la cronologia delle attività. Ciò consente agli agenti di mantenere la continuità tra le chiamate e i flussi di lavoro, supportando modalità di memoria sia effimere che a lungo termine. I dati di memoria possono essere sincronizzati con DynamoDB o Amazon Simple Storage Service (Amazon S3) Simple Storage Service (Amazon S3) per garantire osservabilità e conformità.

-

AgentCore Gateway: interfacce gestite per l'invocazione sicura Servizi AWS ed esterne APIs tramite Model Context Protocol (MCP). Questi connettori consentono agli agenti di interagire direttamente con i dati, gli strumenti e le applicazioni aziendali, consentendo un'orchestrazione più ricca senza codice di integrazione personalizzato.

Insieme, questi componenti consentono di creare sistemi adattivi e multiagente che operano su architetture serverless e basate su eventi. Ad esempio, AgentCore Runtime può ospitare più agenti specializzati che si coordinano tramite EventBridge o Step Functions, utilizzando AgentCore Memory per condividere il contesto e garantire risultati deterministici e verificabili.

Collegando le intenzioni del cliente ai sistemi e ai processi di backend, AgentCore offre un'esperienza di assistenza clienti automatizzata ma contestualmente appropriata.

L'orchestrazione non è codificata. L'LLM determina il flusso di lavoro in modo dinamico, rendendo il sistema più resistente alle variazioni e all'ambiguità degli input.

Basato su regole o nativo dell'intelligenza artificiale: quando usare quale?

AWS Step Functions e Amazon Bedrock Agents eccellono ciascuno in diversi scenari di orchestrazione. Come best practice, usa Step Functions per processi controllati e Amazon Bedrock Agents per l'interazione in linguaggio naturale e il raggiungimento flessibile degli obiettivi. La tabella seguente confronta questi servizi in base a vari tipi di casi d'uso.

Tipo di caso d'uso |

Step Functions (basato su regole) |

Agenti Amazon Bedrock (nativi per l'intelligenza artificiale) |

|---|---|---|

Flusso di lavoro deterministico |

Ideale |

Non necessario |

Input utente non strutturato |

Rigido |

Interpreta e adatta. |

Regole aziendali complesse |

Modella utilizzando le condizioni |

Può inferire usando il ragionamento semantico. |

Richiede una pista di controllo dettagliata |

Traccia completa dello stato |

Traccia limitata, a seconda dei registri degli agenti. Tuttavia, strumenti come pesi, distorsioni e registrazione delle chiamate dei modelli possono mitigare questa limitazione. |

Automazione sensibile alla latenza |

Coordinazione in tempo reale |

In tempo reale, anche se leggermente superiore a causa dell'elaborazione LLM. |

Esperienze utente mirate agli obiettivi |

Richiede una progettazione esplicita |

L'agente può dedurre l'obiettivo e comporre il flusso. |

Orchestrazione basata sugli eventi

Che si utilizzi un'orchestrazione basata su regole o basata sull'intelligenza artificiale, gli eventi sono il meccanismo che attiva l'intelligenza in un sistema serverless. In entrambi i modelli di orchestrazione, si verifica la seguente sequenza:

-

Un evento viene emesso attraverso. EventBridge Esempi di evento sono gli input degli utenti, i caricamenti di documenti e le transazioni.

-

Questo evento attiva l'orchestratore appropriato:

-

Step Functions se la logica è deterministica

-

AWS Lambda o attività Amazon ECS per un runtime AWS nativo a cui abbonarsi EventBridge per la progettazione coreografica

-

Amazon Bedrock Agents se la logica è dinamica o conversazionale

-

-

AgentCore gli agenti possono emettere e sottoscrivere EventBridge eventi in modo nativo utilizzando l'SDK. AgentCore

Con questo approccio, gli agenti partecipano direttamente ai flussi di lavoro serverless, mantenendo al contempo un contesto a lungo termine tramite la memoria. AgentCore Questa integrazione forma un doppio livello di comunicazione: -

EventBridge fornisce un routing degli eventi deterministico e verificabile.

-

AgentCore Memory plus the Agent2Agent Protocol (A2A) consente la condivisione semantica dello stato e l'individuazione delle funzionalità.

-

-

Ogni orchestratore coordina i servizi di intelligenza artificiale ed emette ulteriori eventi come completamento, errore e trigger a valle.

Questo modello reattivo garantisce scalabilità, resilienza e design modulare, consentendo a parti del sistema di evolversi in modo indipendente.

Prospettiva strategica

EDA supporta sia l'orchestrazione basata su regole che i modelli di orchestrazione nativi dell'intelligenza artificiale e consente a entrambi i modelli di coesistere. Step Functions fornisce un'automazione affidabile e ripetibile e Amazon Bedrock Agents introduce un'intelligenza dinamica e sensibile al contesto.

Insieme, forniscono alle organizzazioni la possibilità di fare quanto segue:

-

Automatizza i processi ripetitivi e ad alto volume

-

Offri assistenti intelligenti e adattivi rivolti all'utente

-

Scalate l'IA senza intoppi o rigidità architettoniche

L'orchestrazione non riguarda più solo le regole, ma l'interpretazione degli intenti, la selezione degli strumenti e l'esecuzione autonoma. AWS Combinazioni serverless on AWS Step Functions per flussi di lavoro strutturati e Amazon Bedrock Agents per l'orchestrazione semantica. Questo framework unificato consente di creare la prossima generazione di sistemi di intelligenza artificiale agentici e senza server.