Le traduzioni sono generate tramite traduzione automatica. In caso di conflitto tra il contenuto di una traduzione e la versione originale in Inglese, quest'ultima prevarrà.

Dai sistemi basati sugli eventi a quelli basati sulla cognizione aumentata

Le moderne architetture cloud, in particolare quelle basate su principi serverless e basati sugli eventi, si sono tradizionalmente basate su modelli come routing, fan-out e arricchimento per creare sistemi reattivi e scalabili. I sistemi di intelligenza artificiale Agentic si basano su queste basi e le riformulano attorno al ragionamento e alla flessibilità cognitiva basati su LLM. Questo approccio consente funzionalità di automazione e risoluzione dei problemi più sofisticate, rivoluzionando potenzialmente il modo in cui le attività complesse vengono gestite negli ambienti cloud.

Architettura basata su eventi

Il diagramma seguente mostra un tipico sistema distribuito:

-

Un utente invia una richiesta ad Amazon API Gateway.

-

Amazon API Gateway indirizza la richiesta a una AWS Lambda funzione.

-

AWS Lambda esegue l'arricchimento dei dati interrogando un database Amazon Aurora

-

Amazon API Gateway restituisce il payload arricchito al chiamante.

Questa struttura è affidabile e scalabile, ma è fondamentalmente statica. Le regole aziendali e i percorsi logici devono essere codificati in modo esplicito e l'adattamento ai contesti mutevoli o alle informazioni incomplete è limitato.

Flussi di lavoro basati sulla cognizione

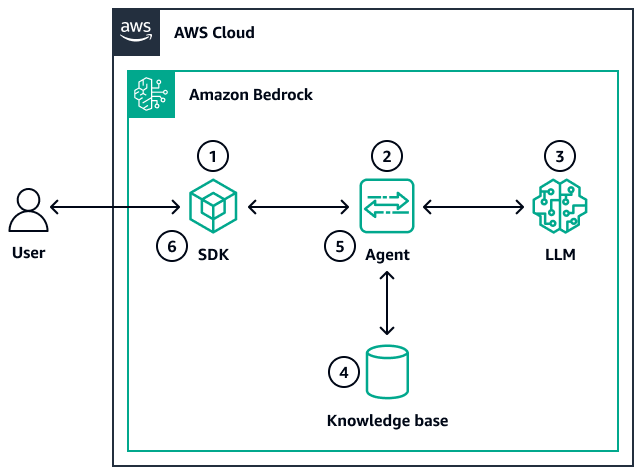

Le architetture agentiche aggiungono l'aumento cognitivo a un sistema basato sugli eventi. Il diagramma seguente mostra un equivalente agentico:

-

Un utente invia una richiesta tramite una chiamata SDK o API.

-

Un agente Amazon Bedrock riceve la richiesta.

-

L'agente interpreta la query richiamando un LLM

-

L'agente esegue l'arricchimento semantico effettuando ricerche nella knowledge base di Amazon Bedrock o in altre fonti di dati esterne.

-

L'LLM sintetizza una risposta ricca di contesto e allineata agli obiettivi.

-

Il sistema restituisce una risposta sintetizzata all'utente.

In questo flusso, l'LLM utilizza la logica, comprende l'intento, recupera e combina il contesto pertinente e quindi decide come rispondere al meglio. Questo modello rispecchia il modello di arricchimento tradizionale, in cui i messaggi vengono arricchiti con dati esterni prima di essere inoltrati ulteriormente. Nei sistemi agentici, tuttavia, questo arricchimento non è una ricerca statica. L'arricchimento è invece dinamico, guidato semanticamente e guidato da uno scopo.

Approfondimenti fondamentali

Ogni flusso di lavoro LLM può essere mappato su un modello di flusso di lavoro agentico, che rispecchia ed evolve gli stili di architettura tradizionali basati sugli eventi. Un elemento fondamentale dei flussi di lavoro agentici è la capacità di ampliare il contesto di un LLM con dati, strumenti e memoria. Questo crea un ciclo di ragionamento informato, adattivo e allineato alle intenzioni dell'utente. Laddove i sistemi tradizionali arricchiscono i messaggi con dati di ricerca, i sistemi agentici consentono al software di agire meno come script e più come collaboratori intelligenti.