Terjemahan disediakan oleh mesin penerjemah. Jika konten terjemahan yang diberikan bertentangan dengan versi bahasa Inggris aslinya, utamakan versi bahasa Inggris.

Agen AI generatif: mengganti logika simbolis dengan LLM

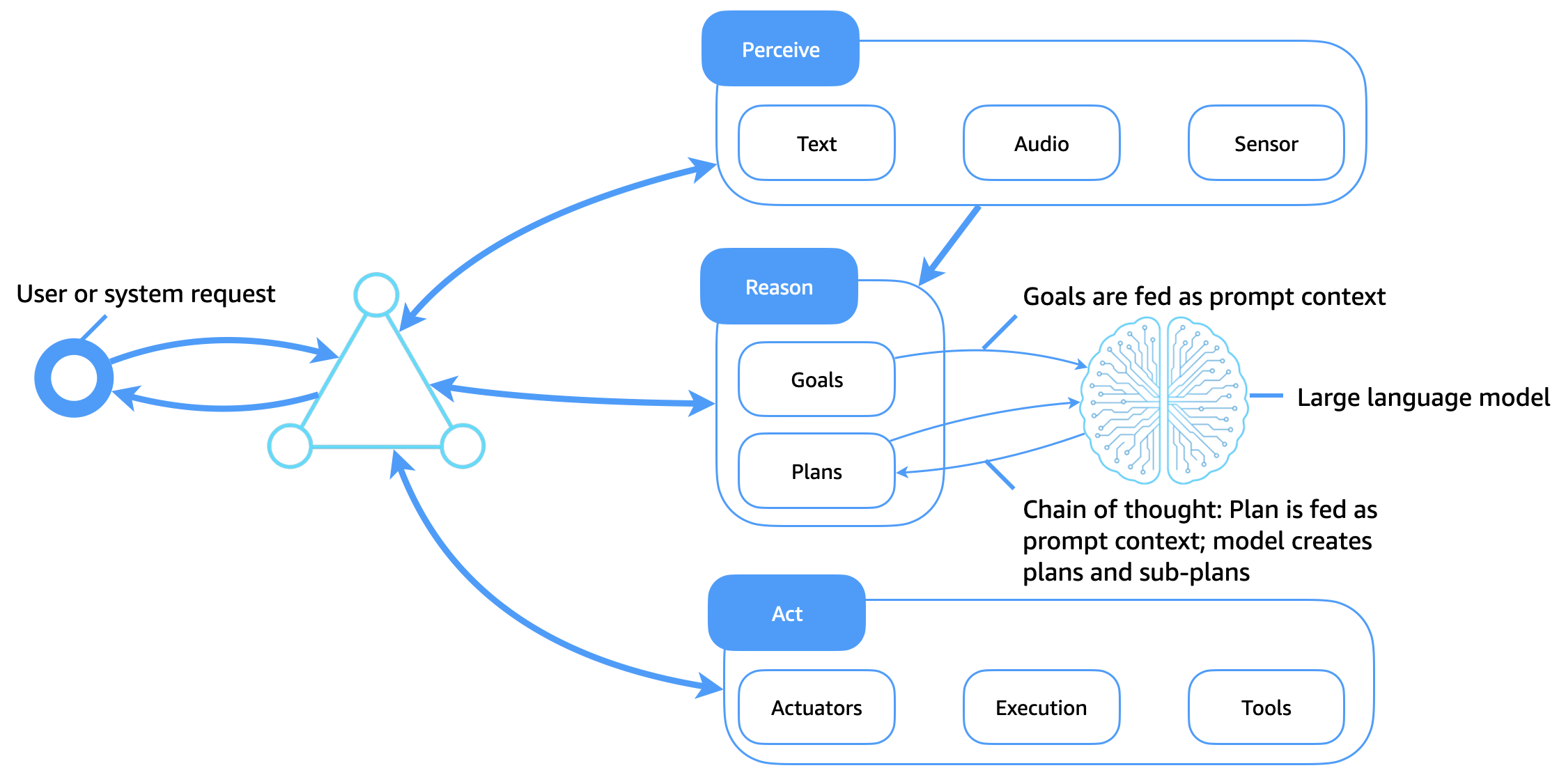

Diagram berikut menggambarkan bagaimana model bahasa besar (LLM) sekarang berfungsi sebagai inti kognitif yang fleksibel dan cerdas untuk agen perangkat lunak. Berbeda dengan sistem logika simbolis tradisional, yang mengandalkan pustaka rencana statis dan aturan kode tangan, LLM memungkinkan penalaran adaptif, perencanaan kontekstual, dan penggunaan alat dinamis, yang mengubah cara agen memandang, bernalar, dan bertindak.

Penyempurnaan kunci

Arsitektur ini meningkatkan arsitektur agen tradisional sebagai berikut:

-

LLM sebagai mesin kognitif: Tujuan, rencana, dan kueri diteruskan ke dalam model sebagai konteks yang cepat. LLM menghasilkan jalur penalaran (seperti rantai pemikiran), menguraikan tugas menjadi sub-tujuan, dan memutuskan tindakan selanjutnya.

-

Penggunaan alat melalui prompt: LLM dapat diarahkan melalui agen penggunaan alat atau penalaran dan acting (ReAct) yang meminta untuk memanggil API dan untuk mencari, menanyakan, menghitung, dan menafsirkan output.

-

Context-aware perencanaan: Agen menghasilkan atau merevisi rencana secara dinamis berdasarkan tujuan agen saat ini, lingkungan input, dan umpan balik, tanpa memerlukan pustaka rencana hardcode.

-

Konteks cepat sebagai memori: Alih-alih menggunakan basis pengetahuan simbolis, agen menyandikan memori, rencana, dan tujuan sebagai token prompt yang diteruskan ke model.

-

Belajar melalui beberapa kesempatan, pembelajaran dalam konteks: LLM mengadaptasi perilaku melalui rekayasa yang cepat, yang mengurangi kebutuhan akan pelatihan ulang eksplisit atau perpustakaan rencana yang kaku.

Mencapai memori jangka panjang pada LLM-based agen

Tidak seperti agen tradisional, yang menyimpan memori jangka panjang dalam basis pengetahuan terstruktur, agen AI generatif harus bekerja dalam batasan jendela konteks LLM. Untuk memperluas memori dan mendukung kecerdasan persisten, agen AI generatif menggunakan beberapa teknik pelengkap: penyimpanan agen, Retrieval-Augmented Generasi (RAG), pembelajaran dalam konteks dan rantai cepat, dan pra-pelatihan.

Toko agen: memori jangka panjang eksternal

Status agen, riwayat pengguna, keputusan, dan hasil disimpan dalam penyimpanan memori agen jangka panjang (seperti database vektor, penyimpanan objek, atau penyimpanan dokumen). Memori yang relevan diambil sesuai permintaan dan disuntikkan ke dalam konteks prompt LLM saat runtime. Ini menciptakan loop memori persisten, di mana agen mempertahankan kontinuitas di seluruh sesi, tugas, atau interaksi.

KAIN

RAG meningkatkan kinerja LLM dengan menggabungkan pengetahuan yang diambil dengan kemampuan generatif. Ketika tujuan atau kueri dikeluarkan, agen mencari indeks pengambilan (misalnya, melalui pencarian semantik dokumen, percakapan sebelumnya, atau pengetahuan terstruktur). Hasil yang diambil ditambahkan ke prompt LLM, yang mendasari pembuatan fakta eksternal atau konteks yang dipersonalisasi. Metode ini memperluas memori efektif agen dan meningkatkan keandalan dan kebenaran faktual.

In-context belajar dan rantai yang cepat

Agen mempertahankan memori jangka pendek dengan menggunakan konteks token dalam sesi dan rantai prompt terstruktur. Elemen kontekstual, seperti rencana saat ini, hasil tindakan sebelumnya, dan status agen, diteruskan di antara panggilan untuk memandu perilaku.

Pretraining lanjutan dan fine-tuning

Untuk agen khusus domain, LLM dapat dilanjutkan dengan pra-pelatihan pada koleksi khusus seperti log, data perusahaan, atau dokumentasi produk. Atau, penyetelan instruksi atau pembelajaran penguatan dari umpan balik manusia (RLHF) dapat menanamkan perilaku seperti agen langsung ke dalam model. Ini menggeser pola penalaran dari logika waktu cepat ke representasi internal model, mengurangi panjang yang cepat, dan meningkatkan efisiensi.

Manfaat gabungan dalam AI agen

Teknik-teknik ini, ketika digunakan bersama, memungkinkan agen AI generatif untuk:

-

Pertahankan kesadaran kontekstual dari waktu ke waktu.

-

Sesuaikan perilaku berdasarkan riwayat atau preferensi pengguna.

-

Buat keputusan dengan menggunakan pengetahuan terkini, faktual, atau pribadi.

-

Skala ke kasus penggunaan perusahaan dengan perilaku yang persisten, patuh, dan dapat dijelaskan.

Dengan menambah LLM dengan memori eksternal, lapisan pengambilan, dan pelatihan lanjutan, agen dapat mencapai tingkat kontinuitas dan tujuan kognitif yang tidak dapat dicapai sebelumnya melalui sistem simbolik saja.