Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

Interprétabilité globale

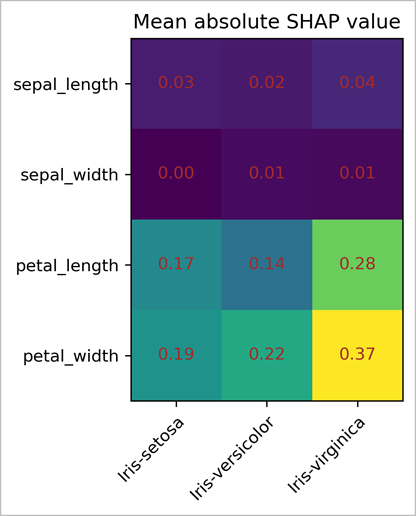

Comprendre comment les fonctionnalités contribuent à la sortie globale d'un modèle fournit des informations générales utiles pour la sélection des fonctionnalités et le développement du modèle. Pour mesurer l'effet de l'ajout d'une nouvelle fonctionnalité, vous exécutez généralement une validation croisée avec et sans la fonctionnalité. Cependant, il est souvent impossible d'exécuter une validation croisée pour toutes les combinaisons de fonctionnalités et tous les types de modèles considérés en raison des coûts de calcul. D'autres méthodes permettant de déterminer l'importance des caractéristiques sont donc utiles pour prendre des décisions rapides. Notre recommandation pour déterminer les attributions globales des fonctionnalités est d'agréger les scores d'attribution des fonctionnalités locales recommandés dans la section précédente pour toutes les données. Nous recommandons également de calculer la modification du score de validation croisée lorsqu'une fonctionnalité est supprimée, si les contraintes de temps et de calcul le permettent. L'exemple suivant illustre l'agrégation des scores d'attribution locaux. Il fait la moyenne des magnitudes des valeurs SHAP pour le modèle de classification de l'iris (à partir de l'aperçu) et les trace sous forme de carte thermique. Vous pouvez constater que les mesures des sépales ne jouent pas un rôle important dans le modèle de détermination de la classe d'iris.

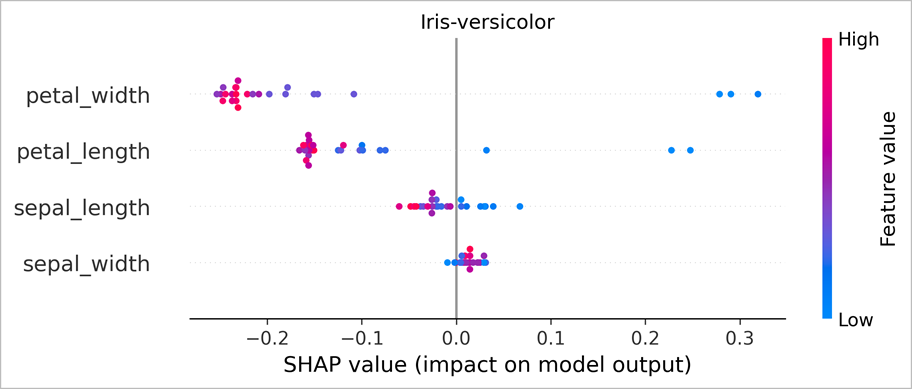

Pour une sortie de modèle spécifiée, la collection de valeurs SHAP entre les instances d'évaluation peut être visualisée dans un diagramme en essaim d'abeilles, comme illustré dans le schéma suivant (pour un sous-ensemble de données du jeu de données iris [4]). Vous pouvez voir ici que l'petal_widthattribut a le plus grand effet sur le résultat du modèle pour la classeIris-versicolor, et qu'une petal_width valeur élevée contribue négativement à la prédiction de la classe. Lorsque plusieurs points de données ont une valeur d'attribution de caractéristique identique ou très similaire, les points sont empilés pour indiquer la prévalence la plus élevée à cet emplacement.