Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

Motifs de saga à enchaînement rapide

En réinventant le chaînage rapide LLM sous la forme d'une saga axée sur les événements, nous ouvrons la voie à un nouveau modèle opérationnel : les flux de travail deviennent distribués, récupérables et coordonnés sémantiquement entre les agents autonomes. Chaque étape de réponse rapide est redéfinie comme une tâche atomique, émise en tant qu'événement, consommée par un agent dédié et enrichie de métadonnées contextuelles.

Le schéma suivant est un exemple de chaînage d'invite LLM :

Chorégraphie de saga

Le modèle de chorégraphie de la saga est une approche de mise en œuvre dans les systèmes distribués qui n'a pas de coordinateur central. Au lieu de cela, chaque service ou composant publie des événements qui déclenchent l'action suivante du flux de travail. Ce modèle est largement utilisé dans les systèmes distribués pour gérer les transactions entre plusieurs services. Dans une saga, le système exécute une série de transactions locales coordonnées. En cas d'échec, le système déclenche des actions de compensation pour maintenir la cohérence.

Le schéma suivant est un exemple de chorégraphie de saga :

-

Inventaire de réserve

-

Autoriser le paiement

-

Créer un bon de commande d'expédition

Si l'étape 3 échoue, le système invoque des actions compensatoires (par exemple, annuler un paiement ou libérer un inventaire).

Ce modèle est particulièrement utile dans les architectures axées sur les événements où les services sont faiblement couplés et où les états doivent être résolus de manière cohérente au fil du temps, même en cas de défaillance partielle.

Schéma de chaînage rapide

Le chaînage rapide ressemble au schéma de la saga, à la fois en termes de structure et d'objectif. Il exécute une série d'étapes de raisonnement qui se développent de manière séquentielle tout en préservant le contexte et en autorisant les annulations et les révisions.

Chorégraphie d'agent

-

LLM interprète une requête utilisateur complexe et génère une hypothèse

-

Le LLM élabore un plan pour résoudre la tâche

-

LLM exécute une sous-tâche (par exemple, en utilisant un appel d'outil ou en récupérant des connaissances)

-

Le LLM affine le résultat ou revoit une étape précédente s'il juge le résultat insatisfaisant

Si un résultat intermédiaire est erroné, le système peut effectuer l'une des opérations suivantes :

-

Réessayez les étapes en utilisant une approche différente

-

Revenir à une demande précédente et replanifier

-

Utiliser une boucle d'évaluateur (par exemple, à partir du modèle évaluateur-optimiseur) pour détecter et corriger les défaillances

À l'instar du modèle de saga, le chaînage rapide permet des mécanismes de progression partielle et de retour en arrière. Cela se fait par le biais d'un raffinement itératif et d'une correction dirigée par le LLM plutôt que par la compensation des transactions de base de données.

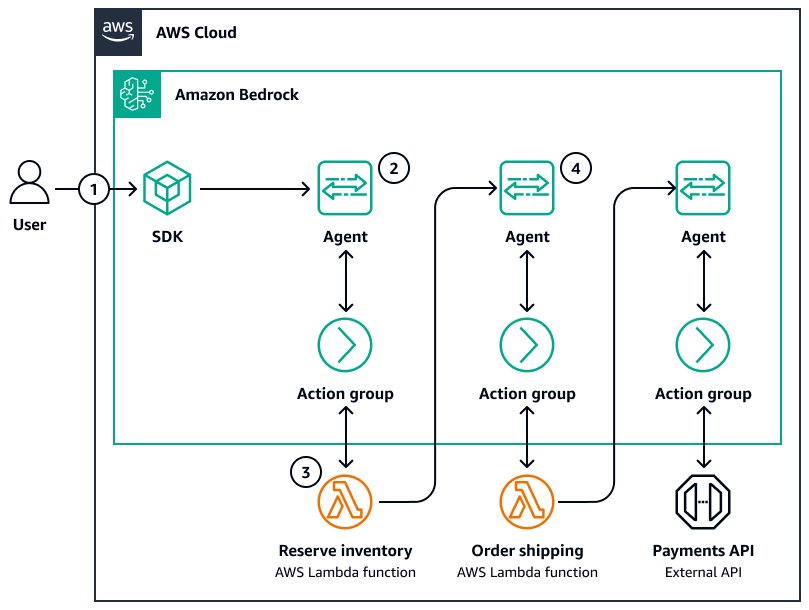

Le schéma suivant est un exemple de chorégraphie d'agent :

-

Un utilisateur soumet une requête par le biais d'un SDK.

-

Un agent Amazon Bedrock orchestre le raisonnement de la manière suivante :

-

Interprétation (LLM)

-

Planification (LLM)

-

Exécution par le biais d'un outil ou d'une base de connaissances

-

Construction de la réponse

-

-

Si un outil échoue ou ne renvoie pas suffisamment de données, l'agent peut replanifier ou reformuler la tâche de manière dynamique.

-

La mémoire (par exemple, un magasin de vecteurs à court terme) peut conserver son état d'une étape à l'autre

Plats à emporter

Alors que le modèle en saga gère les appels de service distribués selon une logique de compensation, le chaînage rapide gère les tâches de raisonnement grâce à un séquençage réflexif et à une replanification adaptative. Les deux systèmes permettent de réaliser des progrès progressifs, de décentraliser les points de décision et de remédier aux défaillances, et tout cela grâce à un raisonnement éclairé plutôt qu'à un retour en arrière rigide.

Le chaînage rapide introduit le raisonnement transactionnel, qui est l'équivalent cognitif des sagas. C'est-à-dire que chaque « pensée » est réévaluée, révisée ou abandonnée dans le cadre d'un dialogue plus large axé sur les objectifs.