Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

Créez des barrières de sécurité basées sur l'IA pour les agents Connect AI

Une barrière de protection d’IA est une ressource qui vous permet de mettre en œuvre des mesures de protection en fonction de vos cas d’utilisation et de vos politiques en matière d’IA responsable.

Les agents Connect AI utilisent les rambardes Amazon Bedrock. Vous pouvez créer et modifier ces barrières de protection sur le site Web d’administration Connect Customer .

Table des matières

Points importants à connaître

-

Vous pouvez créer jusqu’à trois barrières de protection personnalisées.

-

Les agents Guardrails for Connect AI sont disponibles dans les mêmes langues que le niveau classique d'Amazon Bedrock. Pour obtenir la liste des langues prises en charge, consultez Langues prises en charge par les barrières de protection Amazon Bedrock. L’évaluation du contenu du texte dans d’autres langues sera inefficace.

-

Lorsque vous configurez ou modifiez une barrière de protection, nous vous recommandons vivement d’expérimenter et de comparer différentes configurations. Il est possible que certaines de vos combinaisons aient des conséquences imprévues. Testez la barrière de protection pour vous assurer que les résultats répondent aux exigences de votre cas d’utilisation.

-

Lorsque les barrières de sécurité sont activées pour les réponses en streaming, il y a une latence supplémentaire car les fragments de texte doivent être mis en mémoire tampon et scannés avant d'être livrés. Cela affecte principalement time-to-first-token (TTFT), car le système doit accumuler suffisamment de texte pour effectuer une évaluation significative du garde-fou avant de diffuser le premier morceau à l'utilisateur final. Une latence supplémentaire mineure en plus du TTFT est attendue, en fonction de la configuration du garde-corps. Les réponses plus courtes peuvent entraîner une latence proportionnellement plus importante, car le scan du garde-corps doit tout de même traiter un minimum de texte en mémoire tampon. Il s'agit d'un compromis inhérent entre la sécurité du contenu, la précision et la vitesse de réponse. Si votre cas d'utilisation est sensible à la latence, déterminez si des barrières de sécurité sont nécessaires pour toutes les interactions ou si elles peuvent être appliquées de manière sélective. Pour plus d'informations sur le mode de diffusion synchrone par garde-corps, consultez Configurer le comportement de réponse au streaming pour filtrer le contenu dans le guide de l'utilisateur d'Amazon Bedrock.

Comment créer une barrière de protection d’IA

-

Connectez-vous au site Web Connect Customer d'administration avec un compte doté d'AI Agent Designer, AI Guardrails - Créez une autorisation dans son profil de sécurité.

-

Sur le site Web Connect Customer d'administration, dans le menu de navigation de gauche, choisissez AI Agent Designer, AI Guardrails.

-

Sur la page Barrières de protection, choisissez Créer une barrière de protection.

-

Dans la boîte de dialogue Créer une barrière de protection d’IA, entrez le nom et la description de la barrière de protection, puis choisissez Créer.

-

Sur la page Générateur de barrières de protection d’IA, complétez les champs suivants selon vos besoins pour créer des politiques pour votre barrière de protection :

-

Filtres de contenu : ajustez l’intensité des filtres pour bloquer les invites de saisie ou modéliser les réponses présentant du contenu préjudiciable. Le filtrage est effectué sur la base de la détection de certaines catégories de contenus préjudiciables prédéfinies : haine, insultes, relations sexuelles, violence, inconduite et attaque d’invites.

-

Sujets refusés : définissez un ensemble de sujets indésirables dans le contexte de votre application. Le filtre aidera à les bloquer s’ils sont détectés dans les requêtes des utilisateurs ou dans les réponses des modèles. Vous pouvez ajouter jusqu’à 30 sujets refusés.

-

Contrôle de l’ancrage contextuel : détectez et filtrez les hallucinations dans les réponses du modèle en fonction de l’ancrage dans une source et de la pertinence par rapport à la requête de l’utilisateur.

-

Filtres de mots : configurez des filtres pour bloquer les mots, les phrases et les grossièretés indésirables (correspondance exacte). Ces mots peuvent inclure des termes offensants, des noms de concurrents, etc.

-

Filtres d’informations sensibles : configurez des filtres pour aider à bloquer ou à masquer les informations sensibles, telles que les données d’identification personnelle (PII), ou des expressions régulières personnalisées dans les entrées utilisateur et les réponses du modèle.

Le blocage ou le masquage sont effectués sur la base de la détection probabiliste d’informations sensibles dans des formats standard dans des entités telles que le numéro SSN, la date de naissance, l’adresse, etc. Cela permet également de configurer la détection basée sur des expressions régulières de modèles pour les identifiants.

-

Messagerie bloquée : personnalisez le message par défaut affiché à l’utilisateur si votre barrière de protection bloque l’entrée ou le modèle de réponse.

Amazon Connect ne prend pas en charge le filtre de contenu d’image pour aider à détecter et à filtrer le contenu d’image inapproprié ou toxique.

-

-

Lorsque votre barrière de protection est terminée, choisissez Enregistrer.

Lors de la sélection dans la liste déroulante des versions, Latest:Draft renvoie toujours l’état enregistré de la barrière de protection d’IA.

-

Choisissez Publier. Les mises à jour de la barrière de protection d’IA sont enregistrées, le statut de visibilité de la barrière de protection d’IA est défini sur Publié et une nouvelle version de la barrière de protection d’IA est créée.

Lors de la sélection dans la liste déroulante des versions, Latest:Published renvoie toujours l’état enregistré de la barrière de protection d’IA.

Modification du message bloqué par défaut

Cette section explique comment accéder au générateur et à l’éditeur de barrière de protection d’IA sur le site Web d’administration Connect Customer , en utilisant l’exemple de modification du message bloqué affiché aux utilisateurs.

L’image suivante montre un exemple de message bloqué par défaut affiché pour un utilisateur. Le message par défaut est « Texte saisi bloqué par une barrière de protection ».

Pour modifier le message bloqué par défaut

-

Connectez-vous au site Web d' Connect Customer administration à l'adresse https ://

instance name.my.connect.aws/. Utilisez un compte administrateur ou un compte chez AI Agent Designer - AI Guardrails - Créez une autorisation dans son profil de sécurité. -

Dans le menu de navigation, choisissez AI Agent Designer, AI Guardrails.

-

Sur la page Barrières de protection d’IA, choisissez Créer une barrière de protection d’IA. Une boîte de dialogue s’affiche pour vous permettre d’attribuer un nom et une description.

-

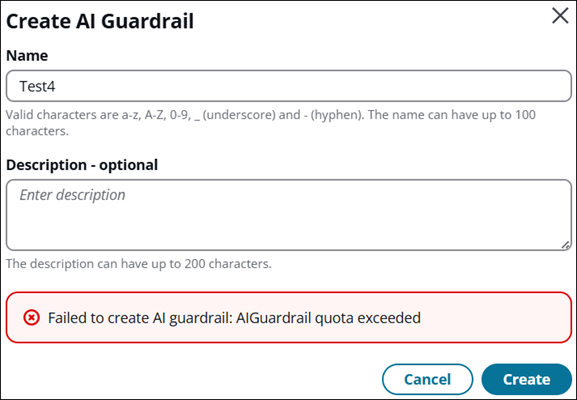

Dans la boîte de dialogue Créer une barrière de protection d’IA, entrez un nom et une description, puis choisissez Créer. Si votre entreprise dispose déjà de trois barrières de protection, vous recevrez un message d’erreur, comme illustré dans l’image suivante.

Si vous recevez ce message, au lieu de créer une autre barrière de protection, pensez à modifier une barrière de protection existante pour répondre à vos besoins. Vous pouvez également en supprimer une pour en créer une autre.

-

Pour modifier le message par défaut qui s’affiche lorsque la barrière de protection bloque la réponse du modèle, accédez à la section Messagerie bloquée.

-

Entrez le texte du message de blocage que vous souhaitez afficher, choisissez Enregistrer, puis Publier.

Exemples de commandes de l’interface CLI pour configurer les politiques de barrières de protection d’IA

Vous trouverez ci-dessous des exemples de configuration des politiques de barrières de protection d’IA à l’aide de l’interface AWS CLI.

Blocage des sujets indésirables

Utilisez l'exemple de commande AWS CLI suivant pour bloquer les sujets indésirables.

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "topicPolicyConfig": { "topicsConfig": [ { "name": "Financial Advice", "definition": "Investment advice refers to financial inquiries, guidance, or recommendations with the goal of generating returns or achieving specific financial objectives.", "examples": ["- Is investment in stocks better than index funds?", "Which stocks should I invest into?", "- Can you manage my personal finance?"], "type": "DENY" } ] } }

Filtrage des contenus dangereux et inappropriés

Utilisez l'exemple de commande AWS CLI suivant pour filtrer les contenus dangereux et inappropriés.

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "contentPolicyConfig": { "filtersConfig": [ { "inputStrength": "HIGH", "outputStrength": "HIGH", "type": "INSULTS" } ] } }

Filtrez les termes dangereux et inappropriés

Utilisez l'exemple de commande AWS CLI suivant pour filtrer les mots dangereux et inappropriés.

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "wordPolicyConfig": { "wordsConfig": [ { "text": "Nvidia", }, ] } }

Détection des hallucinations dans les réponses du modèle

Utilisez l'exemple de commande AWS CLI suivant pour détecter des hallucinations dans la réponse du modèle.

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "contextualGroundPolicyConfig": { "filtersConfig": [ { "type": "RELEVANCE", "threshold": 0.50 }, ] } }

Suppression d’informations sensibles

Utilisez l'exemple de commande AWS CLI suivant pour supprimer des informations sensibles telles que des informations personnelles identifiables (PII).

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "sensitiveInformationPolicyConfig": { "piiEntitiesConfig": [ { "type": "CREDIT_DEBIT_CARD_NUMBER", "action":"BLOCK", }, ] } }