Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

Mise en cache des invites pour une inférence de modèle plus rapide

La mise en cache des invites est une fonctionnalité facultative que vous pouvez utiliser avec les modèles pris en charge dans Amazon Bedrock afin de réduire la latence des réponses d’inférence et les coûts des jetons d’entrée. En ajoutant des parties de votre contexte à un cache, le modèle peut tirer parti du cache pour ignorer le recalcul des entrées, ce qui permet à Bedrock de partager les économies de calcul et de réduire les latences de réponse.

La mise en cache des invites peut être utile lorsque des charges de travail comportant des contextes longs et répétés sont fréquemment réutilisées pour plusieurs requêtes. Par exemple, si vous avez un chatbot où les utilisateurs peuvent charger des documents et poser des questions à leur sujet, le modèle peut prendre beaucoup de temps à traiter les documents chaque fois que l’utilisateur fournit des entrées. Grâce à la mise en cache des invites, vous pouvez mettre le document en cache afin que les futures requêtes contenant le document n’aient pas besoin de le retraiter.

Lorsque vous utilisez la mise en cache des invites, vous êtes facturé à un tarif réduit pour les jetons lus depuis le cache. Selon le modèle, les jetons écrits dans le cache peuvent être facturés à un tarif supérieur à celui des jetons d’entrée non mis en cache. Tous les jetons non lus depuis le cache, ou écrits dans ce dernier, sont facturés au tarif de jeton d’entrée standard pour ce modèle. Pour plus d’informations, consultez la page Tarification Amazon Bedrock

Comment ça marche

Si vous choisissez d’utiliser la mise en cache des invites, Amazon Bedrock crée un cache composé de points de contrôle du cache. Il s’agit de marqueurs qui définissent la sous-section contiguë de l’invite que vous souhaitez mettre en cache (souvent appelée préfixe d’invite). Ces préfixes d’invite doivent être statiques entre les demandes. Les modifications apportées au préfixe d’invite dans les demandes suivantes entraîneront des échecs de cache.

Les points de contrôle du cache comportent un nombre minimum et maximum de jetons, selon le modèle spécifique que vous utilisez. Vous ne pouvez créer un point de contrôle du cache que si le nombre total de préfixes d’invite correspond au nombre minimum de jetons. Par exemple, le modèle Anthropic Claude 3.7 Sonnet nécessite au moins 1 024 jetons par point de contrôle du cache. Cela signifie que votre premier point de contrôle du cache peut être défini au bout de 1 024 jetons et que le deuxième point de contrôle du cache peut être défini au bout de 2 048 jetons. Si vous essayez d’ajouter un point de contrôle du cache avant d’atteindre le nombre minimum de jetons, l’inférence réussira tout de même, mais le préfixe ne sera pas mis en cache. Le cache possède un Time To Live (TTL), qui est réinitialisé à chaque accès réussi au cache. Pendant cette période, le contexte en cache est conservé. Si aucun accès au cache ne se produit pendant la période TTL, celui-ci expire. La plupart des modèles prennent en charge un TTL de 5 minutes, tandis que le format Claude Opus 4,5Claude Haiku 4.5, et Claude Sonnet 4.5 proposent également une option TTL prolongée d'une heure.

Vous pouvez utiliser la mise en cache des invites chaque fois que vous obtenez une inférence de modèle dans Amazon Bedrock pour les modèles pris en charge. La mise en cache des invites est prise en charge par les fonctionnalités Amazon Bedrock suivantes :

- Converse et ConverseStream APIs

-

Vous pouvez poursuivre une conversation avec un modèle dans lequel vous spécifiez les points de contrôle du cache dans les invites.

- InvokeModel et InvokeModelWithResponseStream APIs

-

Vous pouvez soumettre des demandes d’invite uniques dans lesquelles vous activez la mise en cache des invites et spécifiez vos points de contrôle du cache.

- Mise en cache des invites avec inférence entre régions

-

La mise en cache des invites peut être utilisée conjointement avec l’inférence entre régions. L'inférence interrégionale sélectionne automatiquement la AWS région optimale au sein de votre zone géographique pour répondre à votre demande d'inférence, maximisant ainsi les ressources disponibles et la disponibilité des modèles. En période de forte demande, ces optimisations peuvent entraîner une augmentation du nombre d’écritures dans le cache.

- Amazon Bedrock Prompt Management

-

Lorsque vous créez ou modifiez une invite, vous pouvez choisir d’activer la mise en cache des invites. Selon le modèle, vous pouvez mettre en cache les invites système, les instructions système et les messages (utilisateur et assistant). Vous pouvez également choisir de désactiver la mise en cache des invites.

Ils vous APIs offrent le maximum de flexibilité et de contrôle granulaire sur le cache des invites. Vous pouvez définir un point de contrôle du cache individuel au sein des invites. Vous pouvez ajouter du contenu au cache en créant d’autres points de contrôle du cache, dans la limite du nombre maximum de points de contrôle du cache autorisés pour le modèle spécifique. Pour de plus amples informations, veuillez consulter Modèles, régions et limites pris en charge.

Modèles, régions et limites pris en charge

Le tableau suivant répertorie les modèles pris en charge ainsi que le nombre minimum de jetons, le nombre maximum de points de contrôle du cache et les champs autorisant les points de contrôle du cache.

Pour savoir quels modèles prennent en charge la mise en cache rapide, reportez-vous à la section Modèles en un coup d'œil, puis choisissez le modèle qui vous intéresse. Le tableau suivant montre la mise en cache rapide pour les modèles qui ne sont pas présents dans models-at-a-glance.

| Nom du modèle | ID du modèle | Type de version | Nombre minimum de jetons par point de contrôle du cache | Nombre maximum de points de contrôle du cache par demande | TTL pris en charge | Champs qui acceptent les points de contrôle de mise en cache des invites |

|---|---|---|---|---|---|---|

Claude Opus 4 |

anthropic.claude-opus-4-20250514-v1:0 |

Disponibilité générale |

1,024 |

4 |

5 minutes |

`système`, `messages` et `outils` |

Claude 3.7 Sonnet |

anthropic.claude-3-7-sonnet-20250219-v1:0 |

Disponibilité générale |

1,024 |

4 |

5 minutes |

`système`, `messages` et `outils` |

Claude 3.5 Sonnet v2 |

anthropic.claude-3-5-sonnet-20241022-v2:0 |

Version préliminaire |

1,024 |

4 |

5 minutes |

`système`, `messages` et `outils` |

Pour utiliser l'option TTL d'une heure avec les modèles pris en charge (Claude Opus4.5, etClaude Sonnet 4.5)Claude Haiku 4.5, spécifiez le ttl champ dans votre point de contrôle du cache. Dans l'API Converse, ajoutez-le "ttl": "1h" à votre cachePoint objet. Dans l' InvokeModel API pour les modèles Claude, ajoutez-les "ttl": "1h" à votre cache_control objet. Si aucune ttl valeur n'est fournie, le comportement de mise en cache de 5 minutes par défaut s'applique. Le TTL d'une heure est utile pour les sessions de longue durée ou les scénarios de traitement par lots dans lesquels vous souhaitez conserver le cache pendant de longues périodes.

Amazon Nova propose la mise en cache automatique des invites pour toutes les invites de texte, y compris les messages User et System. Ce mécanisme peut présenter des avantages concernant la latence lorsque les invites commencent par des parties répétitives, même en l’absence de configuration explicite. Cependant, pour bénéficier d’économies et garantir des avantages de performance plus constants, nous vous recommandons d’activer la mise en cache des invites explicite.

Gestion du cache simplifiée pour les modèles Claude

Pour les modèles Claude, Amazon Bedrock propose une approche simplifiée de la gestion du cache qui réduit la complexité du placement manuel des points de contrôle du cache. Au lieu de vous obliger à spécifier des emplacements précis pour les points de contrôle du cache, vous pouvez utiliser la gestion automatique du cache avec un seul point d’arrêt à la fin de votre contenu statique.

Lorsque vous activez la gestion simplifiée du cache, le système vérifie automatiquement les accès au cache aux limites des blocs de contenu précédents, en remontant jusqu’à environ 20 blocs de contenu par rapport au point d’arrêt spécifié. Cela permet au modèle de trouver le préfixe correspondant le plus long dans votre cache sans que vous ayez à prévoir l’emplacement optimal des points de contrôle. Pour l’utiliser, placez un point de contrôle du cache unique à la fin de votre contenu statique, avant tout contenu dynamique ou variable. Le système trouvera automatiquement la meilleure correspondance dans le cache.

Pour un contrôle plus précis, vous pouvez toujours utiliser plusieurs points de contrôle du cache (jusqu’à 4 pour les modèles Claude) pour définir les limites exactes du cache. Vous devez utiliser plusieurs points de contrôle du cache si vous mettez en cache des sections qui changent à des fréquences différentes ou si vous souhaitez mieux contrôler exactement ce qui est mis en cache.

Important

La vérification automatique des préfixes ne prend en compte qu’une vingtaine de blocs de contenu depuis le point de contrôle du cache. Si votre contenu statique dépasse cette plage, envisagez d’utiliser plusieurs points de contrôle du cache ou de restructurer votre invite pour placer le contenu le plus fréquemment réutilisé dans cette plage.

Comment utiliser efficacement la mise en cache rapide

Si vous avez des instructions qui sont utilisées à une cadence normale (c'est-à-dire des instructions système utilisées plus fréquemment que toutes les 5 minutes), continuez à utiliser le cache de 5 minutes, car celui-ci continuera à être actualisé sans frais supplémentaires.

Il est préférable d'utiliser le cache d'une heure dans les scénarios suivants :

-

Lorsque vous recevez des instructions qui sont probablement utilisées moins de 5 minutes, mais plus fréquemment que toutes les heures. Par exemple, lorsqu'un agent secondaire agentic prend plus de 5 minutes, ou lorsque vous enregistrez une longue conversation de chat avec un utilisateur et que vous vous attendez généralement à ce que celui-ci ne réponde pas dans les 5 prochaines minutes.

-

Lorsque la latence est importante et que vos instructions de suivi peuvent être envoyées au-delà de 5 minutes.

-

Lorsque vous souhaitez améliorer l'utilisation de votre limite de débit, car les accès au cache ne sont pas déduits de votre limite de débit.

Vous pouvez utiliser des contrôles de cache d'une heure et de 5 minutes dans la même demande, mais avec une contrainte importante : les entrées de cache avec un TTL plus long doivent apparaître avant le plus court TTLs (c'est-à-dire qu'une entrée de cache d'une heure doit apparaître avant toute entrée de cache de 5 minutes).

Prise en main

Les sections suivantes présentent un bref aperçu de l’utilisation de la fonctionnalité de mise en cache des invites pour chaque méthode d’interaction avec les modèles via Amazon Bedrock.

L’API Converse fournit des options avancées et flexibles pour implémenter une mise en cache des invites dans les conversations complexes. Pour plus d’informations sur les exigences d’invite pour chaque modèle, consultez la section précédente : Modèles, régions et limites pris en charge.

Exemple de demande

Les exemples suivants montrent un point de contrôle du cache défini dans les champs messages, system ou tools, ou d’une demande à l’API Converse. Vous pouvez placer des points de contrôle à n’importe lequel de ces emplacements pour une demande donnée. Par exemple, si vous envoyez une demande au modèle Claude 3.5 Sonnet v2, vous pouvez placer deux points de contrôle du cache dans messages, un point de contrôle du cache dans system et un autre dans tools. Pour plus de détails et des exemples de structuration et d’envoi de demandes d’API Converse, consultez Mener une conversation avec les opérations d’API Converse.

Spécifiez la valeur ttl souhaitée comme ci-dessous, lorsque la valeur ttl n'est pas spécifiée, le comportement par défaut de 5 minutes de mise en cache s'applique.

"cachePoint" : { "type": "default", "ttl" : "5m | 1h" }

Le modèle de réponse de l'ConverseAPI inclut trois nouveaux champs spécifiques à la mise en cache rapide. Les valeurs CacheReadInputTokens et CacheWriteInputTokens vous indiquent combien de jetons ont été lus depuis le cache et combien de jetons ont été écrits dans le cache à la suite de votre précédente demande. Les CacheDetails valeurs indiquent le ttl utilisé pour le nombre de jetons écrits dans le cache. Il s’agit de valeurs qui vous sont facturées par Amazon Bedrock, à un tarif inférieur au coût de l’inférence de modèle complète.

La mise en cache rapide est activée par défaut lorsque vous appelez l'InvokeModelAPI. Vous pouvez définir des points de contrôle du cache à tout moment dans le corps de votre demande, comme dans l’exemple précédent pour l’API Converse.

Pour plus d'informations sur l'envoi d'une InvokeModel demande, consultezSoumettez une seule invite avec InvokeModel.

Dans un terrain de jeu de discussion de la console Amazon Bedrock, vous pouvez activer l’option de mise en cache des invites. Ensuite, Amazon Bedrock crée automatiquement des points de contrôle du cache pour vous.

Suivez les instructions de Génération de réponses dans la console à l’aide de terrains de jeu pour commencer à recevoir des invites dans un terrain de jeu Amazon Bedrock. Pour les modèles pris en charge, la mise en cache des invites est automatiquement activée dans le terrain de jeu. Toutefois, si ce n’est pas le cas, procédez comme suit pour activer la mise en cache des invites :

-

Dans le panneau latéral gauche, ouvrez le menu Configurations.

-

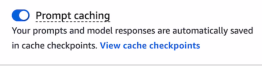

Activez la bascule Mise en cache des invites.

-

Exécutez vos invites.

Une fois que vos réponses combinées d’entrée et de modèle atteignent le nombre minimum de jetons requis pour un point de contrôle (qui varie selon le modèle), Amazon Bedrock crée automatiquement le premier point de contrôle du cache pour vous. Au fur et à mesure que vous poursuivez la discussion, chaque fois que vous atteignez le nombre minimum de jetons, un nouveau point de contrôle est créé, dans la limite du nombre maximum de points de contrôle autorisé pour le modèle. Vous pouvez consulter les points de contrôle de votre cache à tout moment en choisissant Afficher les points de contrôle du cache en regard de la bascule Mise en cache des invites, comme le montre la capture d’écran suivante.

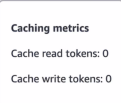

Vous pouvez voir le nombre de jetons qui sont lus depuis et écrits dans le cache en raison de chaque interaction avec le modèle en consultant la fenêtre contextuelle Métriques de mise en cache (

![]() ) dans les réponses du terrain de jeu.

) dans les réponses du terrain de jeu.

Si vous désactivez la bascule de mise en cache des invites alors que vous êtes au milieu d’une conversation, vous pouvez continuer à discuter avec le modèle.