Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

Modelos de orquestación: desde los basados en reglas hasta los nativos de la IA

En los sistemas de IA sin servidor basados en eventos, la orquestación es la lógica de conexión que determina cómo los eventos desencadenan y moldean el comportamiento del sistema. En AWS, la orquestación puede seguir dos modelos principales:

-

Los desarrolladores definen la orquestación basada en reglas mediante flujos de trabajo y máquinas de estados.

-

La orquestación nativa de la IA está impulsada por agentes y grandes modelos de lenguaje (LLMs) que razonan, planifican y actúan en función de la intención y el contexto.

Cada modelo desempeña una función distinta en la creación de sistemas flexibles, reactivos e inteligentes. Juntos, permiten a los desarrolladores pasar de la automatización de procedimientos a sistemas autónomos y orientados a objetivos.

Orquestación basada en reglas con AWS Step Functions

Step Functions proporciona un motor de flujo de trabajo visual para organizar servicios como Amazon AWS Lambda SageMaker, Amazon Bedrock, Amazon DynamoDB y Amazon Simple Storage Service (Amazon S3). La lógica es determinista en el sentido de que los pasos se definen de forma explícita y las transiciones se basan en las condiciones.

Entre las principales ventajas de la orquestación basada en reglas con Step Functions se incluyen las siguientes:

-

Excelente auditabilidad y visibilidad a través de una consola de flujo de trabajo visual

-

Gestión de errores, reintentos y paralelismo integrados

-

Ideal para flujos de control lineales o ramificados con rutas bien definidas

El siguiente diagrama muestra el flujo de trabajo de un ejemplo de caso práctico de ingesta y procesamiento de documentos.

En este ejemplo, una firma de abogados automatiza el análisis de los contratos cargados en los siguientes pasos:

-

Activador de eventos: los documentos legales se cargan en un bucket de Amazon S3, lo que desencadena un EventBridge evento de Amazon, que se dirige a un flujo de trabajo de Step Functions.

-

Workflow — Step Functions lleva a cabo los siguientes pasos:

-

Procesamiento de documentos: una función Lambda limpia y realiza el reconocimiento óptico de caracteres (OCR) inicial en el documento.

-

Extracción de texto: Amazon Textract extrae el texto y los datos clave del documento.

-

Análisis: Amazon Comprehend analiza el texto para clasificar los niveles de riesgo y el sentimiento.

-

Resumen: Amazon Bedrock genera un resumen conciso del contrato.

-

Almacenamiento de datos: los resultados se escriben en Amazon OpenSearch Service para su indexación.

-

-

Recuperación: el equipo legal puede buscar, filtrar y visualizar el análisis de los contratos a través de paneles.

Esta arquitectura aprovecha las capacidades de integración del AWS SDK de Step Functions para interactuar directamente con cada una de las partes del flujo Servicio de AWS de trabajo. Este enfoque reduce la complejidad y elimina la necesidad de funciones Lambda independientes entre cada paso del procesamiento. La última escritura en el OpenSearch servicio también se gestiona mediante la integración del SDK. Como resultado, Step Functions puede indexar los resultados del análisis de documentos, las clasificaciones de riesgo, el análisis de opiniones y los resúmenes generados por la IA directamente en Service. OpenSearch El equipo legal puede acceder a la información a través de paneles para buscar, filtrar y visualizar el análisis de los contratos.

Cada tarea es un estado definido con una gestión de errores integrada. La IA no toma ninguna decisión y la organización es explícita.

Orquestación nativa de IA con Amazon Bedrock Agents

Mientras que Step Functions gestiona cómo suceden las cosas, los agentes de Amazon Bedrock deciden qué debe suceder en función de los objetivos de los usuarios. Un agente o agentes de Amazon Bedrock basados en Amazon Bedrock AgentCore combinan lo siguiente:

-

Un LLM como Anthropic Claude o Amazon Nova

-

Un conjunto de integraciones de herramientas, como funciones Lambda (o un cliente de Model Context Protocol (MCP) para ejecutar integraciones de MCP)

-

Bases de conocimiento opcionales para una base contextual

-

Memoria integrada y seguimiento de objetivos

Los agentes interpretan las entradas en lenguaje natural, razonan al respecto e invocan las herramientas de forma autónoma para cumplir con la intención del usuario, lo que transfiere la lógica de orquestación al modelo.

Entre las principales ventajas de la orquestación nativa de la IA con Amazon Bedrock Agents se incluyen las siguientes:

-

Flexibilidad semántica: interprete diversas entradas de lenguaje natural.

-

Autonomía de las herramientas: seleccione las herramientas adecuadas en tiempo de ejecución.

-

Base contextual: cite el contenido de la base de conocimientos con precisión.

-

Mantenimiento mínimo para los desarrolladores: defina las herramientas y no el flujo.

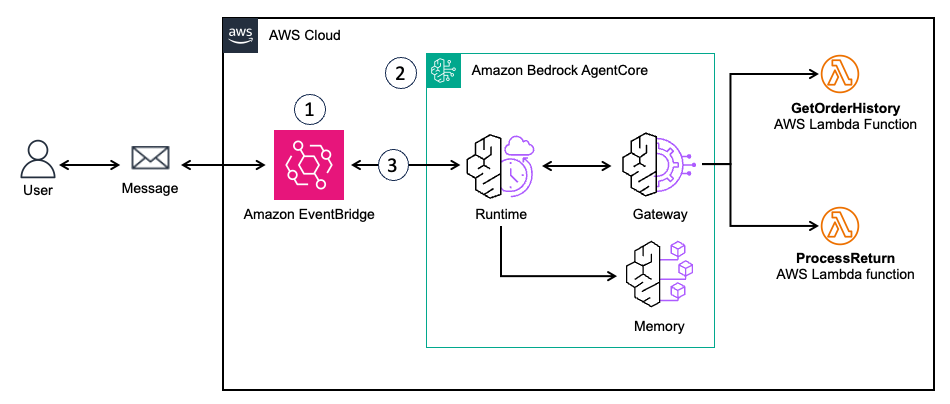

El siguiente diagrama muestra el flujo de trabajo de un ejemplo de caso práctico de automatización de la atención al cliente con Amazon Bedrock Agents.

En este ejemplo, un usuario de un sitio web de venta minorista escribe un mensaje en el chatbot de soporte. Se produce el siguiente flujo de trabajo:

-

Las acciones que desencadenan el evento son las siguientes:

-

El usuario envía un mensaje: «Necesito devolver los zapatos que pedí la semana pasada. ¿Puedes ayudarme?»

-

El mensaje se recibe y se envía. EventBridge

-

EventBridge activa el agente Amazon Bedrock.

-

-

El proceso de razonamiento del agente es el siguiente:

-

Extracción de intenciones: el agente identifica la intención como «orden de devolución».

-

Recuperación de datos: el agente consulta el sistema CRM mediante la función

GetOrderHistoryLambda. -

Verificación de elegibilidad: el agente llama a la función

ProcessReturnLambda para verificar la elegibilidad de la devolución. -

Generación de respuestas: el agente formula la respuesta adecuada.

-

-

La acción de comunicación con el cliente se produce cuando el agente responde: «Su devolución se está procesando». Espere recibir un correo electrónico de confirmación en breve.

Todo el flujo de trabajo demuestra cómo Amazon Bedrock Agents organiza una lógica empresarial compleja mediante grupos de acción definidos. Al conectar la intención del cliente con los sistemas y procesos internos, ofrece una experiencia de servicio al cliente automatizada pero adaptada al contexto.

Amazon Bedrock AgentCore amplía el ecosistema de Amazon Bedrock más allá de los agentes individuales para proporcionar una arquitectura completa de tiempo de ejecución y memoria para sistemas de IA autónomos y basados en eventos.

Los agentes de Amazon Bedrock se centran en organizar secuencias de razonamiento y acción para una sola tarea o dominio. AgentCore proporciona la infraestructura subyacente para componer, coordinar y conservar los flujos de trabajo de varios agentes en entornos distribuidos sin servidor.

En el siguiente diagrama se muestra el flujo de trabajo de un ejemplo de caso práctico de automatización del servicio de atención al cliente con. AgentCore

En este ejemplo se siguen las mismas acciones que en el ejemplo anterior de Amazon Bedrock Agents: un usuario de un sitio web de venta minorista escribe un mensaje en el chatbot de soporte. Se produce el siguiente flujo de trabajo:

-

El usuario envía un mensaje: «Necesito devolver los zapatos que pedí la semana pasada. ¿Puedes ayudarme?»

-

El mensaje se recibe y se envía. EventBridge

-

EventBridge activa el punto final del AgentCore tiempo de ejecución.

AgentCore presenta tres capacidades clave que complementan los modelos de orquestación existentes:

-

AgentCore Runtime: un entorno de ejecución gestionado para ejecutar en AWSél una lógica de agente personalizada. Se integra de forma nativa con AWS Lambda Amazon ECS para escalar el comportamiento de los agentes bajo demanda, lo que elimina la necesidad de administrar manualmente la infraestructura de contenedores o funciones.

-

AgentCore Memoria: proporciona almacenamiento estructurado y persistente para el contexto, el estado y el historial de tareas. Esto permite a los agentes mantener la continuidad entre las invocaciones y los flujos de trabajo, y es compatible con los modos de memoria efímera y a largo plazo. Los datos de memoria se pueden sincronizar con DynamoDB o Amazon Simple Storage Service (Amazon S3) para garantizar la observabilidad y la conformidad.

-

AgentCore Gateway: interfaces administradas para invocar de forma segura Servicios de AWS y externas APIs a través del Model Context Protocol (MCP). Estos conectores permiten a los agentes interactuar directamente con los datos, las herramientas y las aplicaciones empresariales, lo que permite una organización más completa sin necesidad de un código de integración personalizado.

En conjunto, estos componentes permiten crear sistemas adaptables y multiagente que funcionan en arquitecturas sin servidor y basadas en eventos. Por ejemplo, AgentCore Runtime puede alojar varios agentes especializados que se coordinan a través EventBridge de Step Functions, utilizando AgentCore Memory para compartir el contexto y garantizar resultados deterministas y auditables.

Al conectar la intención del cliente con los sistemas y procesos internos, AgentCore ofrece una experiencia de servicio al cliente automatizada pero adaptada al contexto.

La organización no está codificada de forma rígida. El LLM determina el flujo de trabajo de forma dinámica, lo que hace que el sistema sea más resistente a la variación y la ambigüedad de las entradas.

Basado en reglas o nativo de la IA: ¿cuándo usar cuáles?

AWS Step Functions y Amazon Bedrock Agents destacan en diferentes escenarios de orquestación. Como práctica recomendada, utilice Step Functions para los procesos controlados y Amazon Bedrock Agents para la interacción en lenguaje natural y el cumplimiento flexible de los objetivos. En la siguiente tabla se comparan estos servicios en varios tipos de casos de uso.

Tipo de caso de uso |

Step Functions (basadas en reglas) |

Amazon Bedrock Agents (nativos de IA) |

|---|---|---|

Flujo de trabajo determinista |

Ideal |

No es necesario. |

Entrada de usuario no estructurada |

Rígido |

Interpreta y adapta. |

Reglas comerciales complejas |

Modele mediante el uso de condiciones |

Puede inferir mediante el uso del razonamiento semántico. |

Requiere un registro de auditoría detallado |

Rastreo completo del estado |

Rastreo limitado, según los registros de los agentes. Sin embargo, herramientas como las ponderaciones, los sesgos y el registro de invocación de modelos pueden mitigar esta limitación. |

Automatización sensible a la latencia |

Coordinación en tiempo real |

En tiempo real, aunque ligeramente superior debido al procesamiento LLM. |

Experiencias de usuario orientadas a objetivos |

Requiere un diseño explícito |

El agente puede deducir el objetivo y componer el flujo. |

Orquestación basada en eventos

Ya sea que se utilice una orquestación basada en reglas o nativa de la IA, los eventos son el mecanismo que activa la inteligencia en un sistema sin servidor. En ambos modelos de orquestación, se produce la siguiente secuencia:

-

Se emite un evento a través de EventBridge. Algunos ejemplos de eventos son las entradas de los usuarios, las cargas de documentos y las transacciones.

-

Ese evento activa el orquestador apropiado:

-

Step Functions si la lógica es determinista

-

AWS Lambda o tareas de Amazon ECS para tiempo de ejecución AWS nativo suscritas EventBridge para un diseño coreografiado

-

Amazon Bedrock Agents si la lógica es dinámica o conversacional

-

-

AgentCore los agentes pueden emitir EventBridge eventos y suscribirse a ellos de forma nativa mediante el SDK. AgentCore

Con este enfoque, los agentes participan directamente en los flujos de trabajo sin servidor y, al mismo tiempo, mantienen el contexto a largo plazo a través AgentCore de Memory. Esta integración forma una doble capa de comunicación: -

EventBridge proporciona un enrutamiento de eventos determinista y auditable.

-

AgentCore La memoria y el Agent2Agent protocolo (A2A) permiten compartir estados semánticos y descubrir capacidades.

-

-

Cada orquestador coordina los servicios de IA y emite otros eventos, como la finalización, el error y los desencadenantes posteriores.

Este modelo reactivo garantiza la escalabilidad, la resiliencia y el diseño modular, lo que permite que partes del sistema evolucionen de forma independiente.

Perspectiva estratégica

EDA admite modelos de orquestación basados en reglas y modelos de orquestación nativos de la IA, y permite que ambos modelos coexistan. Step Functions proporciona una automatización fiable y repetible, y Amazon Bedrock Agents introduce inteligencia dinámica y sensible al contexto.

En conjunto, ofrecen a las organizaciones la capacidad de hacer lo siguiente:

-

Automatice los procesos repetitivos y de gran volumen

-

Ofrezca asistentes inteligentes y adaptables orientados al usuario

-

Amplíe la IA sin atascos ni rigidez arquitectónica

La orquestación ya no se basa solo en las reglas, sino en la interpretación de la intención, la selección de herramientas y la ejecución autónoma. Serverless on se AWS combina AWS Step Functions para flujos de trabajo estructurados y Amazon Bedrock Agents para la orquestación semántica. Este marco unificado permite crear la próxima generación de sistemas de IA agénticos y sin servidores.