Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Globale Interpretierbarkeit

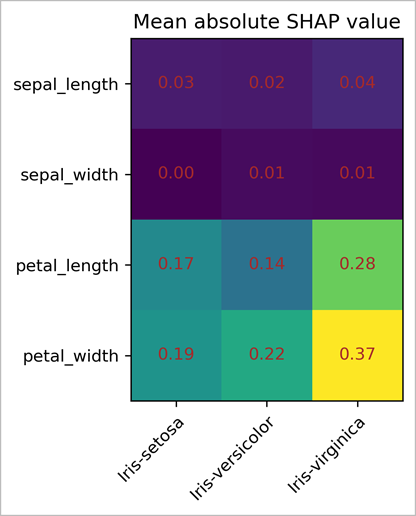

Wenn man versteht, wie Merkmale zur Gesamtleistung eines Modells beitragen, erhält man allgemeine Erkenntnisse, die für die Merkmalsauswahl und Modellentwicklung nützlich sind. Um die Wirkung des Hinzufügens eines neuen Features zu messen, führen Sie in der Regel eine Kreuzvalidierung mit und ohne das Feature durch. Eine Kreuzvalidierung für alle Feature-Kombinationen und alle betrachteten Modelltypen ist jedoch aufgrund des Rechenaufwands oft nicht durchführbar. Andere Methoden zur Bestimmung der Bedeutung von Merkmalen sind daher nützlich, um schnelle Entscheidungen zu treffen. Unsere Empfehlung zur Bestimmung globaler Feature-Attributionen besteht darin, die im vorherigen Abschnitt empfohlenen Werte für die lokale Feature-Zuordnung für alle Daten zu aggregieren. Wir empfehlen außerdem, die Änderung des Kreuzvalidierungswerts zu berechnen, wenn ein Feature entfernt wird, sofern Zeit- und Rechenbeschränkungen dies zulassen. Das folgende Beispiel veranschaulicht die Aggregation der lokalen Attributionswerte. Es berechnet den Durchschnitt der Größen der SHAP-Werte für das Iris-Klassifikationsmodell (aus der Übersicht) und stellt sie als Heatmap dar. Sie können sehen, dass die Kelchblattmaße im Modell zur Bestimmung der Irisklasse keine große Rolle spielen.

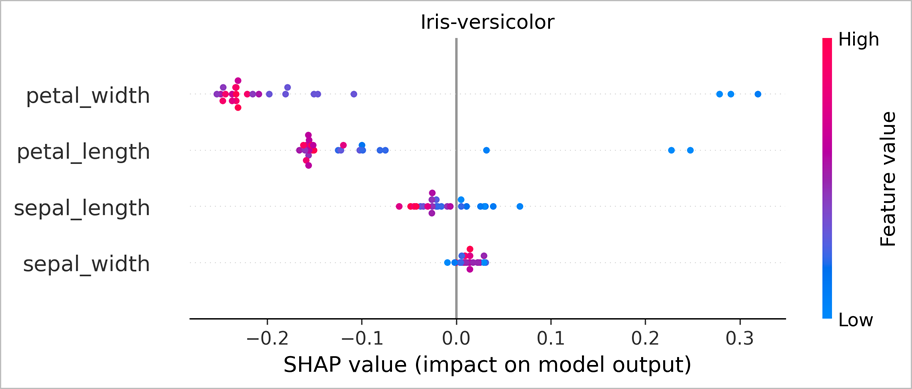

Für eine bestimmte Modellausgabe kann die Erfassung von SHAP-Werten in allen Bewertungsinstanzen in einem Bienenschwarmplot visualisiert werden, wie im folgenden Diagramm dargestellt (für eine Teilmenge von Daten aus dem Iris-Datensatz [4]). Hier können Sie sehen, dass das petal_width Attribut die größte Auswirkung auf die Modellausgabe für die Klasse Iris-versicolor hat und dass ein hoher petal_width Wert negativ zur Klassenvorhersage beiträgt. Wenn mehr als ein Datenpunkt denselben oder einen sehr ähnlichen Feature-Attributionswert hat, werden die Punkte gestapelt, um die größere Prävalenz an dieser Position anzuzeigen.