Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Lokale Interpretierbarkeit

Die beliebtesten Methoden zur lokalen Interpretierbarkeit komplexer Modelle basieren entweder auf Shapley Additive Explanations (SHAP) [8] oder integrierten Gradienten [11]. Jede Methode hat eine Reihe von Varianten, die für einen Modelltyp spezifisch sind.

Verwenden Sie für Tree-Ensemble-Modelle Tree SHAP

Bei baumbasierten Modellen ermöglicht die dynamische Programmierung eine schnelle und genaue Berechnung der Shapley-Werte

Verwenden Sie für neuronale Netze und differenzierbare Modelle integrierte Gradienten und Leitwerte

Integrierte Gradienten bieten eine einfache Möglichkeit, Merkmalszuweisungen in neuronalen Netzen zu berechnen. Die Leitfähigkeit basiert auf integrierten Gradienten und hilft Ihnen dabei, Attributionen von Teilen neuronaler Netze wie Schichten und einzelnen Neuronen zu interpretieren. (Siehe [3,11], die Implementierung befindet sich unter https://captum.ai/.)

Verwenden Sie für alle anderen Fälle Kernel SHAP

Sie können Kernel-SHAP verwenden, um Feature-Attributionen für jedes Modell zu berechnen, aber es ist eine Annäherung an die Berechnung der vollständigen Shapley-Werte und bleibt rechenintensiv (siehe [8]). Die für Kernel-SHAP benötigten Rechenressourcen wachsen schnell mit der Anzahl der Funktionen. Dies erfordert Näherungsmethoden, die die Genauigkeit, Wiederholbarkeit und Robustheit der Erklärungen verringern können. Amazon SageMaker AI Clarify bietet praktische Methoden, mit denen vorgefertigte Container für die Berechnung von Kernal-SHAP-Werten in separaten Instanzen bereitgestellt werden. (Ein Beispiel finden Sie im GitHub Repository Fairness and Explainability

Bei Einzelbaummodellen bieten die geteilten Variablen und Blattwerte ein sofort erklärbares Modell, und die zuvor erörterten Methoden bieten keine zusätzlichen Erkenntnisse. In ähnlicher Weise bieten die Koeffizienten bei linearen Modellen eine klare Erklärung des Modellverhaltens. (SHAP und integrierte Gradientenmethoden geben beide Beiträge zurück, die durch die Koeffizienten bestimmt werden.)

Sowohl SHAP als auch integrierte Gradientenmethoden weisen Schwächen auf. SHAP erfordert, dass Attributionen aus einem gewichteten Durchschnitt aller Merkmalskombinationen abgeleitet werden. Auf diese Weise gewonnene Zuschreibungen können bei der Schätzung der Merkmalsbedeutung irreführend sein, wenn eine starke Wechselwirkung zwischen Merkmalen besteht. Methoden, die auf integrierten Gradienten basieren, können aufgrund der großen Anzahl von Dimensionen, die in großen neuronalen Netzen vorhanden sind, schwierig zu interpretieren sein, und diese Methoden reagieren empfindlich auf die Wahl eines Basispunkts. Allgemeiner gesagt können Modelle Merkmale auf unerwartete Weise verwenden, um ein bestimmtes Leistungsniveau zu erreichen, und diese können je nach Modell variieren — die Bedeutung von Merkmalen ist immer modellabhängig.

Empfohlene Visualisierungen

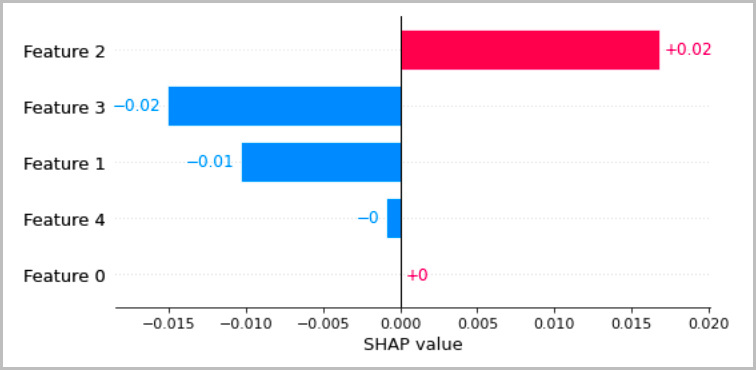

Die folgende Tabelle enthält mehrere empfohlene Methoden zur Visualisierung der lokalen Interpretationen, die in den vorherigen Abschnitten erörtert wurden. Für tabellarische Daten empfehlen wir ein einfaches Balkendiagramm, das die Attributionen zeigt, sodass sie leicht verglichen und daraus abgeleitet werden können, wie das Modell Vorhersagen trifft.

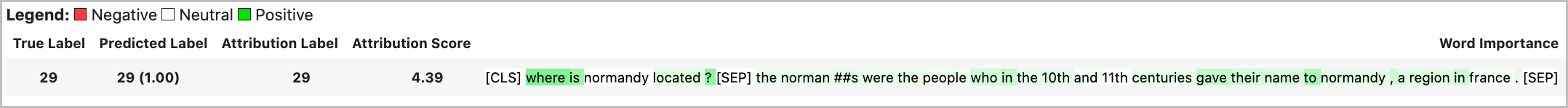

Bei Textdaten führt das Einbetten von Tokens zu einer großen Anzahl skalarer Eingaben. Die in den vorherigen Abschnitten empfohlenen Methoden führen zu einer Zuordnung für jede Dimension der Einbettung und für jede Ausgabe. Um diese Informationen in einer Visualisierung zusammenzufassen, können die Attributionen für ein bestimmtes Token summiert werden. Das folgende Beispiel zeigt die Summe der Attributionen für das BERT-basierte Modell zur Beantwortung von Fragen, das mit dem SQUAD-Datensatz trainiert wurde. In diesem Fall ist das Etikett „vorhergesagt und wahr“ das Synonym für das Wort „Frankreich“.

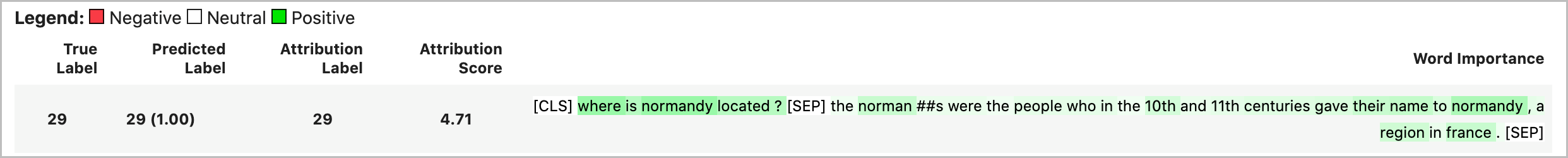

Andernfalls kann die Vektornorm der Token-Attributionen als Gesamtattributionswert zugewiesen werden, wie im folgenden Beispiel gezeigt.

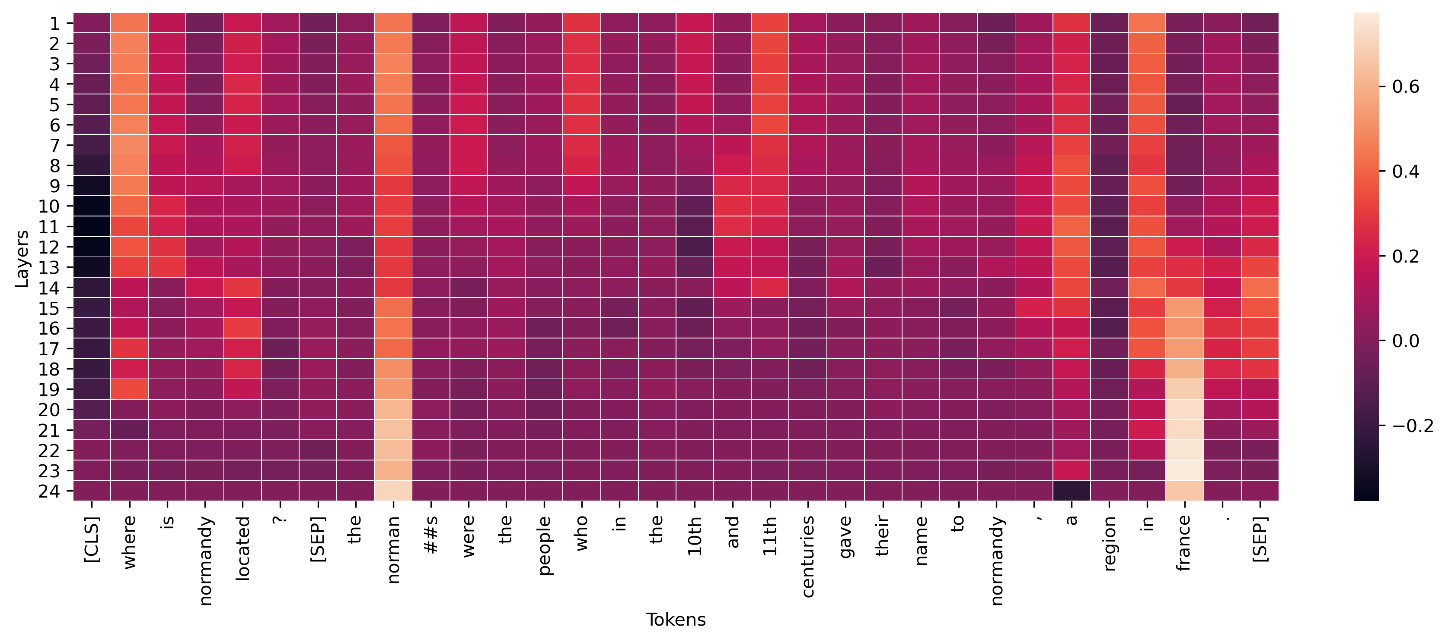

Für Zwischenschichten in Deep-Learning-Modellen können ähnliche Aggregationen zur Visualisierung auf Leitfähigkeiten angewendet werden, wie im folgenden Beispiel gezeigt. Diese Vektornorm der Token-Leitfähigkeit für Transformatorschichten zeigt die letztendliche Aktivierung für die End-Token-Vorhersage („Frankreich“).

Konzeptaktivierungsvektoren bieten eine Methode, um tiefe neuronale Netze genauer zu untersuchen [6]. Diese Methode extrahiert Merkmale aus einer Schicht in einem bereits trainierten Netzwerk und trainiert einen linearen Klassifikator anhand dieser Merkmale, um Rückschlüsse auf die Informationen in der Schicht zu ziehen. Möglicherweise möchten Sie beispielsweise ermitteln, welche Ebene eines BERT-basierten Sprachmodells die meisten Informationen über die einzelnen Spracharten enthält. In diesem Fall könnten Sie für jede Layer-Ausgabe ein lineares part-of-speech Modell trainieren und grob abschätzen, dass der Layer, der die meisten Informationen enthält, der Klassifikator mit der besten Leistung zugeordnet ist. part-of-speech Wir empfehlen diese Methode zwar nicht als primäre Methode zur Interpretation neuronaler Netze, sie kann jedoch eine Option für detailliertere Studien und als Unterstützung beim Entwurf der Netzwerkarchitektur sein.