Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

KI-Leitplanken für Connect AI-Agenten erstellen

Der KI-Integritätsschutz ist eine Ressource, mit der Sie Schutzmaßnahmen implementieren können, die auf Ihren Anwendungsfällen und auf den Richtlinien für eine verantwortungsvolle KI basieren.

Connect-KI-Agenten verwenden Amazon Bedrock Guardrails. Sie können diesen Integritätsschutz auf der Connect Customer -Admin-Website erstellen und bearbeiten.

Inhalt

Wissenswertes

-

Sie können bis zu drei benutzerdefinierte Integritätsschutzmaßnahmen erstellen.

-

Guardrails for Connect AI-Agenten unterstützen dieselben Sprachen wie Amazon Bedrock Guardrails Classic-Stufe. Eine Liste der unterstützten Sprachen finden Sie unter Vom Amazon-Bedrock-Integritätsschutz unterstützte Sprachen. Die Bewertung von Textinhalten in anderen Sprachen ist ineffektiv.

-

Bei der Konfiguration oder Bearbeitung eines Integritätsschutzes empfehlen wir dringend, verschiedenen Konfigurationen zu experimentieren und Benchmark-Tests durchzuführen. Es ist möglich, dass einige Ihrer Kombinationen unbeabsichtigte Folgen haben. Testen Sie den Integritätsschutz, um sicherzustellen, dass die Ergebnisse den Anforderungen Ihres Anwendungsfalls entsprechen.

-

Wenn Guardrails mit Streaming-Antworten aktiviert sind, kommt es zu zusätzlicher Latenz, da Textblöcke vor der Zustellung zwischengespeichert und gescannt werden müssen. Dies wirkt sich hauptsächlich auf time-to-first-token (TTFT) aus, da das System genügend Text sammeln muss, um eine aussagekräftige Guardrail-Evaluierung durchzuführen, bevor der erste Teil an den Endbenutzer gestreamt wird. Abhängig von den Guardrail-Konfigurationen ist zusätzlich zu TTFT mit einer geringfügigen zusätzlichen Latenz zu rechnen. Bei kürzeren Antworten kann es zu einer proportional stärkeren Latenz kommen, da der Guardrail-Scan immer noch einen minimalen Textpuffer verarbeiten muss. Dies ist ein inhärenter Kompromiss zwischen der Genauigkeit der Inhaltssicherheit und der Reaktionsgeschwindigkeit. Wenn Ihr Anwendungsfall latenzabhängig ist, sollten Sie überlegen, ob Leitplanken für alle Interaktionen erforderlich sind oder ob sie selektiv angewendet werden können. Weitere Informationen zum synchronen Guardrail-Streaming-Modus finden Sie unter Konfigurieren des Streaming-Antwortverhaltens zum Filtern von Inhalten im Amazon Bedrock-Benutzerhandbuch.

Entwickeln eines KI-Integritätsschutzes

-

Melden Sie sich auf der Connect Customer Admin-Website mit einem Konto an, dessen Sicherheitsprofil über die Berechtigung AI Agent Designer, AI guardrails — Create, verfügt.

-

Wählen Sie auf der Connect Customer Admin-Website im linken Navigationsmenü die Optionen AI Agent Designer, AI guardrails aus.

-

Wählen Sie auf der Seite Integritätsschutz die Option Integritätsschutz erstellen aus.

-

Geben Sie im Dialogfeld KI-Integritätsschutz erstellen einen Namen und eine Beschreibung für den Integritätsschutz ein, und wählen Sie dann Erstellen aus.

-

Füllen Sie auf der Seite KI-Integritätsschutz-Builder die folgenden Felder nach Bedarf aus, um Richtlinien für den Integritätsschutz zu erstellen:

-

Inhaltsfilter: Passen Sie die Filterstärke an, um Prompts zu blockieren oder Antworten mit schädlichen Inhalten zu modellieren. Die Filterung erfolgt auf der Grundlage der Erkennung bestimmter vordefinierter Kategorien für schädliche Inhalte: Hass, Beleidigung, Sexualität, Gewalt, Fehlverhalten und Prompt-Angriffe.

-

Abgelehnte Themen: Definieren Sie eine Reihe von Themen, die im Kontext Ihrer Anwendung unerwünscht sind. Der Filter hilft dabei, sie zu blockieren, wenn sie in Benutzeranfragen oder Modellantworten entdeckt werden. Sie können bis zu 30 abgelehnte Themen hinzufügen.

-

Kontextueller Grounding-Check: Hilft dabei, Halluzinationen in Modellantworten zu erkennen und zu filtern, basierend auf dem Grounding in einer Quelle und der Relevanz für die Benutzeranfrage.

-

Wortfilter: Konfigurieren Sie Filter, um unerwünschte Wörter, Wortgruppen und Schimpfwörter (exakte Übereinstimmung) zu blockieren. Solche Wörter können beleidigende Begriffe, Namen von Wettbewerbern usw. enthalten.

-

Filter für vertrauliche Informationen: Konfigurieren Sie Filter, um vertrauliche Informationen wie persönlich identifizierbare Informationen (PII) oder benutzerdefinierte reguläre Ausdrücke in Benutzereingaben und Modellantworten zu blockieren oder zu maskieren.

Das Blockieren oder Maskieren erfolgt auf der Grundlage der probabilistischen Erkennung vertraulicher Informationen in Standardformaten in Entitäten wie SSN-Nummer, Geburtsdatum, Adresse usw. Dies ermöglicht auch die Konfiguration der Erkennung von Mustern für Identifikatoren, die auf regulären Ausdrücken basieren.

-

Meldung „Blockiert“: Passen Sie die Standardnachricht an, die dem Benutzer angezeigt wird, wenn der Integritätsschutz die Eingabe oder die Modellantwort blockiert.

Amazon Connect unterstützt keinen Bildinhaltsfilter zur Erkennung und Filterung unangemessener oder toxischer Bildinhalte.

-

-

Wenn der Integritätsschutz fertig ist, klicken Sie auf Speichern.

Wenn Sie eine Auswahl im Dropdown-Menü „Versionen“ treffen, gibt die Option Neuestes: Entwurf immer den gespeicherten Status des KI-Integritätsschutzes zurück.

-

Wählen Sie Publish. Aktualisierungen am KI-Integritätsschutz werden gespeichert, der Status für die Sichtbarkeit des KI-Integritätsschutzes wird auf Veröffentlicht gesetzt, und eine neue Version des KI-Integritätsschutzes wird erstellt.

Wenn Sie eine Auswahl im Dropdown-Menü „Versionen“ treffen, gibt die Option Neuestes: Veröffentlicht immer den gespeicherten Status des KI-Integritätsschutzes zurück.

Ändern der Standardmeldung „Blockiert“

In diesem Abschnitt wird anhand des Beispiels der Änderung der Meldung für blockierte Inhalte, die Benutzern angezeigt wird, erklärt, wie Sie auf der Connect Customer -Admin-Website auf den KI-Integritätsschutz-Builder und -Editor zugreifen können.

Die folgende Abbildung zeigt ein Beispiel für die Standardmeldung für blockierte Inhalte, die einem Benutzer angezeigt wird. Die Standardmeldung lautet „Eingabetext wurde durch den Integritätsschutz blockiert“.

So ändern Sie die Standardmeldung „Blockiert“

-

Melden Sie sich auf der Connect Customer Admin-Website unter https://

instance name.my.connect.aws/ an. Verwenden Sie ein Administratorkonto oder ein Konto beim AI Agent Designer — AI guardrails — Create Permission in seinem Sicherheitsprofil. -

Wählen Sie im Navigationsmenü AI Agent Designer, AI Guardrails aus.

-

Wählen Sie auf der Seite KI-Integritätsschutz die Option KI-Integritätsschutz erstellen aus. Es wird ein Dialogfeld angezeigt, in dem Sie einen Namen und eine Beschreibung angeben können.

-

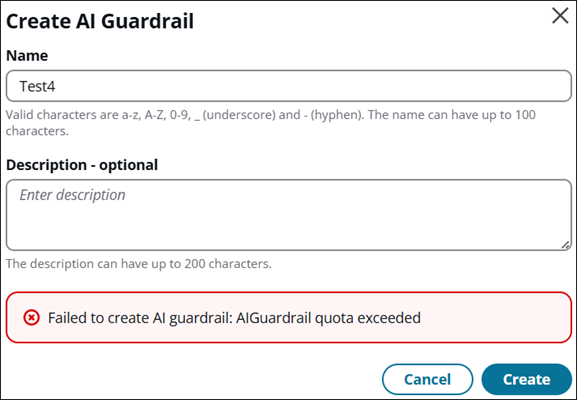

Geben Sie im Dialogfeld KI-Integritätsschutz erstellen einen Namen und eine Beschreibung fein, und wählen Sie dann Erstellen aus. Wenn Ihr Unternehmen bereits über drei Integritätsschutzmaßnahmen verfügt, wird eine Fehlermeldung angezeigt, wie auf der folgenden Abbildung zu sehen.

Wenn Sie diese Nachricht erhalten, sollten Sie einen bestehenden Integritätsschutz an Ihren Bedarf anpassen, anstatt einen weiteren zu erstellen. Alternativ können Sie auch einen Integritätsschutz löschen, um einen weiteren erstellen können.

-

Um die Standardmeldung zu ändern, die angezeigt wird, wenn der Integritätsschutz die Modellantwort blockiert, scrollen Sie zum Abschnitt Meldung „Blockiert“.

-

Geben Sie den Text der Blockierungsmeldung ein, der angezeigt werden soll, klicken Sie auf Speichern und dann auf Veröffentlichen.

CLI-Beispielbefehle zur Konfiguration von KI-Integritätsschutzrichtlinien

Im Folgenden finden Sie Beispiele für die Konfiguration der KI-Integritätsschutzrichtlinien mithilfe der AWS -CLI.

Blockieren unerwünschter Themen

Verwenden Sie den folgenden AWS CLI-Beispielbefehl, um unerwünschte Themen zu blockieren.

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "topicPolicyConfig": { "topicsConfig": [ { "name": "Financial Advice", "definition": "Investment advice refers to financial inquiries, guidance, or recommendations with the goal of generating returns or achieving specific financial objectives.", "examples": ["- Is investment in stocks better than index funds?", "Which stocks should I invest into?", "- Can you manage my personal finance?"], "type": "DENY" } ] } }

Filtern von schädlichen und unangemessenen Inhalten

Verwenden Sie den folgenden AWS CLI-Beispielbefehl, um schädliche und unangemessene Inhalte zu filtern.

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "contentPolicyConfig": { "filtersConfig": [ { "inputStrength": "HIGH", "outputStrength": "HIGH", "type": "INSULTS" } ] } }

Filtern von schädlichen und unangemessenen Wörtern

Verwenden Sie den folgenden AWS CLI-Beispielbefehl, um schädliche und unangemessene Wörter zu filtern.

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "wordPolicyConfig": { "wordsConfig": [ { "text": "Nvidia", }, ] } }

Erkennen von Halluzinationen in der Modellreaktion

Verwenden Sie den folgenden AWS CLI-Beispielbefehl, um Halluzinationen in der Modellantwort zu erkennen.

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "contextualGroundPolicyConfig": { "filtersConfig": [ { "type": "RELEVANCE", "threshold": 0.50 }, ] } }

Redigieren von sensiblen Daten

Verwenden Sie den folgenden AWS CLI-Beispielbefehl, um vertrauliche Informationen wie personenbezogene Daten (PII) zu redigieren.

aws qconnect update-ai-guardrail --cli-input-json { "assistantId": "a0a81ecf-6df1-4f91-9513-3bdcb9497e32", "aiGuardrailId": "9147c4ad-7870-46ba-b6c1-7671f6ca3d95", "blockedInputMessaging": "Blocked input text by guardrail", "blockedOutputsMessaging": "Blocked output text by guardrail", "visibilityStatus": "PUBLISHED", "sensitiveInformationPolicyConfig": { "piiEntitiesConfig": [ { "type": "CREDIT_DEBIT_CARD_NUMBER", "action":"BLOCK", }, ] } }