As traduções são geradas por tradução automática. Em caso de conflito entre o conteúdo da tradução e da versão original em inglês, a versão em inglês prevalecerá.

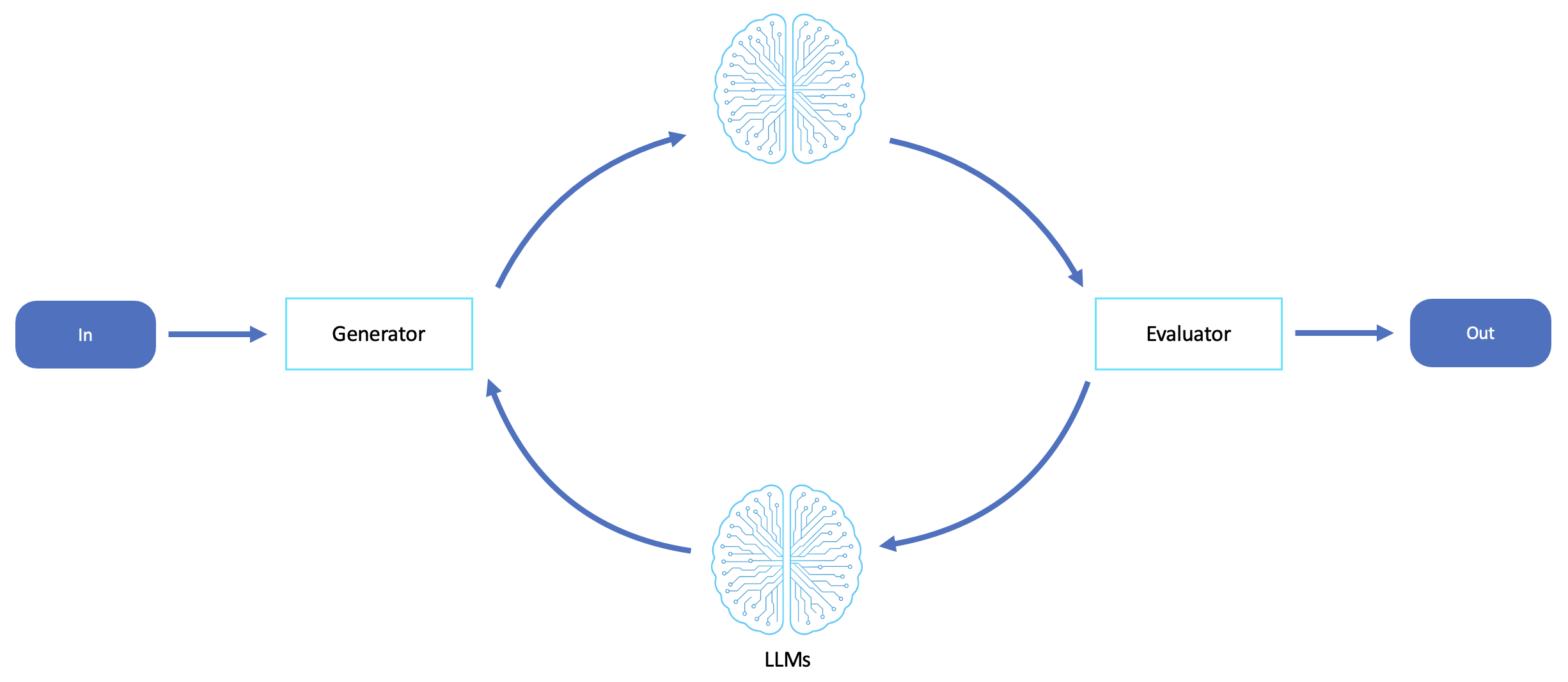

Fluxo de trabalho para avaliadores e ciclos de reflexão e refinamento

Esse fluxo de trabalho fornece um ciclo de feedback em que um LLM gera um resultado e outro avalia ou critica o resultado. Isso promove autorreflexão, otimização e melhorias iterativas.

O fluxo de trabalho do avaliador é ideal para cenários em que a qualidade, a precisão e o alinhamento da saída são importantes e em que a geração de passagem única não é confiável ou é insuficiente. Esse fluxo de trabalho é excelente quando os agentes precisam fazer uma autocrítica, iterar e refinar seus resultados, seja para atender a um padrão mais alto de exatidão ou para explorar alternativas aprimoradas com base no feedback.

Esse fluxo de trabalho é particularmente eficaz quando:

-

A saída envolve métricas de qualidade subjetivas (por exemplo, estilo, tom e legibilidade) ou critérios objetivos (por exemplo, exatidão, segurança e desempenho).

-

O agente deve raciocinar por meio de compensações, avaliar restrições ou otimizar em direção a uma meta.

-

Você precisa de redundância e garantia de qualidade integradas, especialmente em domínios regulamentados, voltados para o cliente ou criativos.

-

Human-in-the-loop a revisão é cara ou não está disponível, e a validação autônoma é desejada.

Esse fluxo de trabalho é usado para geração de conteúdo, síntese e revisão de código, aplicação de políticas, verificação de alinhamento, ajuste de instruções e pós-processamento de RAG. Também é útil para agentes de autoaperfeiçoamento, onde o feedback contínuo ajuda a moldar respostas melhores ao longo do tempo para criar ciclos de decisão autônomos e confiáveis.

Casos de uso comuns

-

Agentes da equipe vermelha em comparação com agentes da equipe azul

-

Agentes que geram, avaliam e revisam códigos ou planos

-

Garantia de qualidade, detecção de alucinações e aplicação de estilo

Capacidades

-

Suporta geração e avaliação dissociadas usando modelos diferentes (por exemplo, Claude para geração e Mistral para avaliação)

-

O feedback é estruturado e usado para gerar resultados revisados

-

Suporta várias iterações ou limites de convergência