翻訳は機械翻訳により提供されています。提供された翻訳内容と英語版の間で齟齬、不一致または矛盾がある場合、英語版が優先します。

Saga パターンのプロンプト連鎖

LLM プロンプトチェーンをイベント駆動型サガとして再解釈することで、ワークフローが分散され、回復可能になり、自律型エージェント間で意味的に調整される、新しい運用モデルが生まれます。各プロンプト/レスポンスステップは、アトミックタスクとして再フレームされ、イベントとして出力され、専用エージェントによって消費され、コンテキストメタデータで強化されます。

次の図は、LLM プロンプトの連鎖の例です。

Saga コレオグラフィ

Saga コレオグラフィパターンは、中央コーディネーターを持たない分散システムにおける実装アプローチです。代わりに、各サービスまたはコンポーネントは、次のワークフローアクションをトリガーするイベントを発行します。このパターンは、複数のサービス間でトランザクションを管理するために分散システムで広く使用されています。Saga では、システムは一連の調整されたローカルトランザクションを実行します。失敗した場合、システムは整合性を維持するために補償アクションをトリガーします。

次の図は、Saga コレオグラフィの例です。

-

インベントリを予約する

-

支払いを承認する

-

配送注文を作成する

ステップ 3 が失敗すると、システムは補償アクション (支払いのキャンセルやインベントリのリリースなど) を呼び出します。

このパターンは、サービスが疎結合され、部分的な障害がある場合でも、時間の経過とともに状態を一貫して解決する必要があるイベント駆動型アーキテクチャで特に役立ちます。

プロンプトの連鎖パターン

プロンプトの連鎖は、構造と目的の両方で saga パターンに似ています。コンテキストを保持し、ロールバックとリビジョンを許可しながら、順次構築する一連の推論ステップを実行します。

エージェントコレオグラフィ

-

LLM は複雑なユーザークエリを解釈し、仮説を生成します

-

LLM がタスクを解決するための計画を策定する

-

LLM がサブタスクを実行する (ツール呼び出しの使用や知識の取得など)

-

LLM は、結果が不十分であると判断した場合、出力を絞り込むか、前のステップを再検討します。

中間結果に欠陥がある場合、システムは次のいずれかを実行できます。

-

別のアプローチを使用してステップを再試行する

-

前のプロンプトに戻って再計画する

-

評価者ループ (評価者最適化パターンなど) を使用して障害を検出して修正する

Saga パターンと同様に、プロンプトの連鎖により、部分的な進行とロールバックのメカニズムが可能になります。これは、データベーストランザクションを補償するのではなく、反復的な絞り込みと LLM 指向の修正によって行われます。

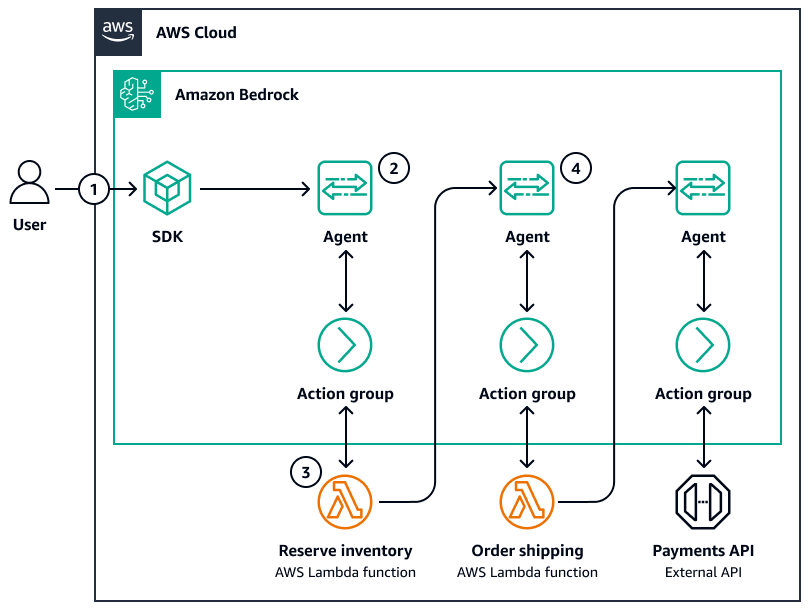

次の図は、エージェントのコレオグラフィの例です。

-

ユーザーは SDK を介してクエリを送信します。

-

Amazon Bedrock エージェントは、次のように推論を調整します。

-

解釈 (LLM)

-

計画 (LLM)

-

ツールまたはナレッジベースによる実行

-

レスポンスの構築

-

-

ツールが失敗するか、十分なデータが返されない場合、エージェントはタスクを動的に再計画または再フレーズできます。

-

メモリ (短期ベクトルストアなど) はステップ間で状態を保持できます

重要な点

Saga パターンが補償ロジックを使用して分散型サービス呼び出しを管理する場合、プロンプトチェーンはリフレクティブシーケンスと適応型再計画を使用して推論タスクを管理します。どちらのシステムも、段階的な進行、分散された決定ポイント、障害復旧を可能にし、厳格なロールバックではなく、情報に基づいた推論を通じてこれらをすべて実行します。

プロンプト連鎖では、トランザクションの推論が導入されます。これは、Sagas と認識的に同等です。つまり、より広範な目標指向の対話の一環として、各「思考」が再評価、改訂、または中止されます。