翻訳は機械翻訳により提供されています。提供された翻訳内容と英語版の間で齟齬、不一致または矛盾がある場合、英語版が優先します。

イベント駆動型システムから認識拡張型システムへ

最新のクラウドアーキテクチャ、特にサーバーレスおよびイベント駆動型の原則に基づいて構築されたものは、従来、応答性が高くスケーラブルなシステムを作成するために、ルーティング、ファンアウト、エンリッチメントなどのパターンに依存してきました。エージェント AI システムは、LLM で強化された推論と認知の柔軟性を中心に再構築しながら、これらの基盤の上に構築されます。このアプローチにより、より高度な問題解決機能と自動化機能が可能になり、クラウド環境での複雑なタスクの処理方法に変革をもたらす可能性があります。

イベント駆動型アーキテクチャ

次の図は、一般的な分散システムを示しています。

-

ユーザーは Amazon API Gateway にリクエストを送信します。

-

Amazon API Gateway は、リクエストを AWS Lambda 関数にルーティングします。

-

AWS Lambda Amazon Aurora データベースをクエリしてデータエンリッチメントを実行する

-

Amazon API Gateway は、エンリッチされたペイロードを呼び出し元に返します。

この構造は信頼性が高くスケーラブルですが、基本的には静的です。ビジネスルールとロジックパスは明示的にコーディングする必要があり、変化するコンテキストや不完全な情報への適応は制限されます。

認知拡張ワークフロー

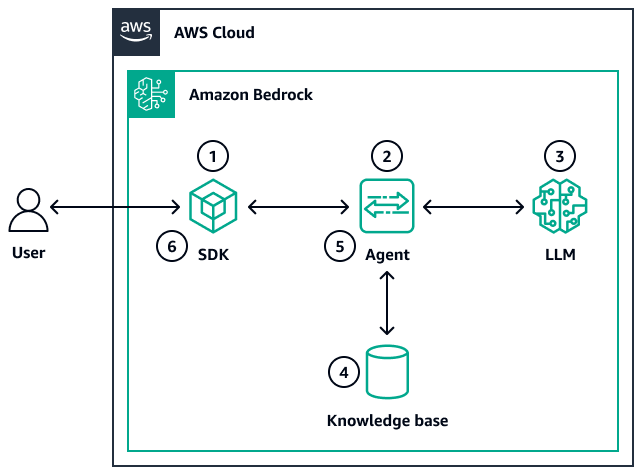

エージェントアーキテクチャは、イベント駆動型システムに認知拡張を追加します。次の図は、同等のエージェントを示しています。

-

ユーザーは SDK または API コールを通じてクエリを送信します。

-

Amazon Bedrock エージェントはクエリを受け取ります。

-

エージェントは LLM を呼び出してクエリを解釈します

-

エージェントは、Amazon Bedrock ナレッジベースまたは他の外部データソースを検索してセマンティックエンリッチメントを実行します。

-

LLM は、コンテキストが豊富な目標に沿ったレスポンスを合成します。

-

システムは合成されたレスポンスをユーザーに返します。

このフローでは、LLM はロジックを使用し、インテントを理解し、関連するコンテキストを取得して組み合わせ、最適な応答方法を決定します。このパターンは、メッセージが外部データで拡張されてからさらにルーティングされる従来のエンリッチメントパターンを反映しています。ただし、エージェントシステムでは、このエンリッチメントは静的ルックアップではありません。代わりに、エンリッチメントは動的で、意味的にガイドされ、目的によって駆動されます。

コアインサイト

各 LLM ワークフローは、従来のイベント駆動型アーキテクチャスタイルをミラーリングして進化させるエージェントワークフローパターンにマッピングできます。エージェントワークフローの基本的な構成要素は、LLM のコンテキストをデータ、ツール、メモリで拡張できることです。これにより、通知され、適応的で、ユーザーのインテントに沿った推論ループが作成されます。従来のシステムがルックアップデータでメッセージを強化する場合、エージェントシステムはソフトウェアがスクリプトのように動作したり、インテリジェントな共同作業者のように動作したりすることを可能にします。