Le traduzioni sono generate tramite traduzione automatica. In caso di conflitto tra il contenuto di una traduzione e la versione originale in Inglese, quest'ultima prevarrà.

Scala della temperatura

Nei problemi di classificazione, si presume che le probabilità previste (output softmax) rappresentino la vera probabilità di correttezza per la classe prevista. Tuttavia, sebbene questa ipotesi potesse essere ragionevole per i modelli di dieci anni fa, non è vera per i moderni modelli di rete neurale di oggi (Guo et al. 2017). La perdita di connessione tra le probabilità di previsione dei modelli e la fiducia delle previsioni dei modelli impedirebbe l'applicazione dei moderni modelli di rete neurale ai problemi del mondo reale, come nei sistemi decisionali. Conoscere con precisione il punteggio di affidabilità delle previsioni dei modelli è una delle impostazioni di controllo del rischio più importanti necessarie per creare applicazioni di machine learning solide e affidabili.

I modelli di rete neurale moderni tendono ad avere architetture di grandi dimensioni con milioni di parametri di apprendimento. La distribuzione delle probabilità di previsione in tali modelli è spesso fortemente distorta verso 1 o 0, il che significa che il modello è troppo sicuro di sé e il valore assoluto di queste probabilità potrebbe essere privo di significato. (Questo problema è indipendente dal fatto che nel set di dati sia presente uno squilibrio di classe). Negli ultimi dieci anni sono stati sviluppati vari metodi di calibrazione per creare un punteggio di confidenza di previsione attraverso fasi di post-elaborazione per ricalibrare le probabilità ingenue del modello. Questa sezione descrive un metodo di calibrazione chiamato scala della temperatura, che è una tecnica semplice ma efficace per ricalibrare le probabilità di previsione (Guo et al. 2017). Il ridimensionamento della temperatura è una versione a parametro singolo di Platt Logistic Scaling (Platt 1999).

Il ridimensionamento della temperatura utilizza un singolo parametro scalare T > 0, dove T è la temperatura, per ridimensionare i punteggi logit prima di applicare la funzione softmax, come mostrato nella figura seguente. Poiché lo stesso T viene utilizzato per tutte le classi, l'output softmax con scaling ha una relazione monotona con l'output non scalato. Quando T = 1, si recupera la probabilità originale con la funzione softmax predefinita. Nei modelli troppo sicuri in cui T > 1, le probabilità ricalibrate hanno un valore inferiore rispetto alle probabilità originali e sono distribuite in modo più uniforme tra 0 e 1.

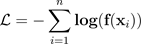

Il metodo per ottenere una temperatura ottimale T per un modello addestrato consiste nel ridurre al minimo la probabilità logaritmica negativa per un set di dati di convalida esaurito.

Si consiglia di integrare il metodo di ridimensionamento della temperatura come parte del processo di addestramento del modello: dopo aver completato l'addestramento del modello, estrai il valore di temperatura T utilizzando il set di dati di convalida, quindi ridimensiona i valori di logit utilizzando T nella funzione softmax. Sulla base di esperimenti in attività di classificazione del testo utilizzando modelli basati su Bert, la temperatura T di solito è compresa tra 1,5 e 3.

La figura seguente illustra il metodo di ridimensionamento della temperatura, che applica il valore di temperatura T prima di passare il punteggio logit alla funzione softmax.

Le probabilità calibrate mediante la scala della temperatura possono rappresentare approssimativamente il punteggio di confidenza delle previsioni dei modelli. Questo può essere valutato quantitativamente creando un diagramma di affidabilità (Guo et al. 2017), che rappresenta l'allineamento tra la distribuzione dell'accuratezza prevista e la distribuzione delle probabilità di previsione.

La scala della temperatura è stata anche valutata come un modo efficace per quantificare l'incertezza predittiva totale nelle probabilità calibrate, ma non è affidabile nel catturare l'incertezza epistemica in scenari come le derive dei dati (Ovadia et al. 2019). Considerando la facilità di implementazione, consigliamo di applicare la scalatura della temperatura all'output del modello di deep learning per creare una soluzione robusta per quantificare le incertezze predittive.