Le traduzioni sono generate tramite traduzione automatica. In caso di conflitto tra il contenuto di una traduzione e la versione originale in Inglese, quest'ultima prevarrà.

Esempio: utilizzo di Application Signals per risolvere i problemi delle applicazioni di IA generativa che interagiscono con i modelli Amazon Bedrock

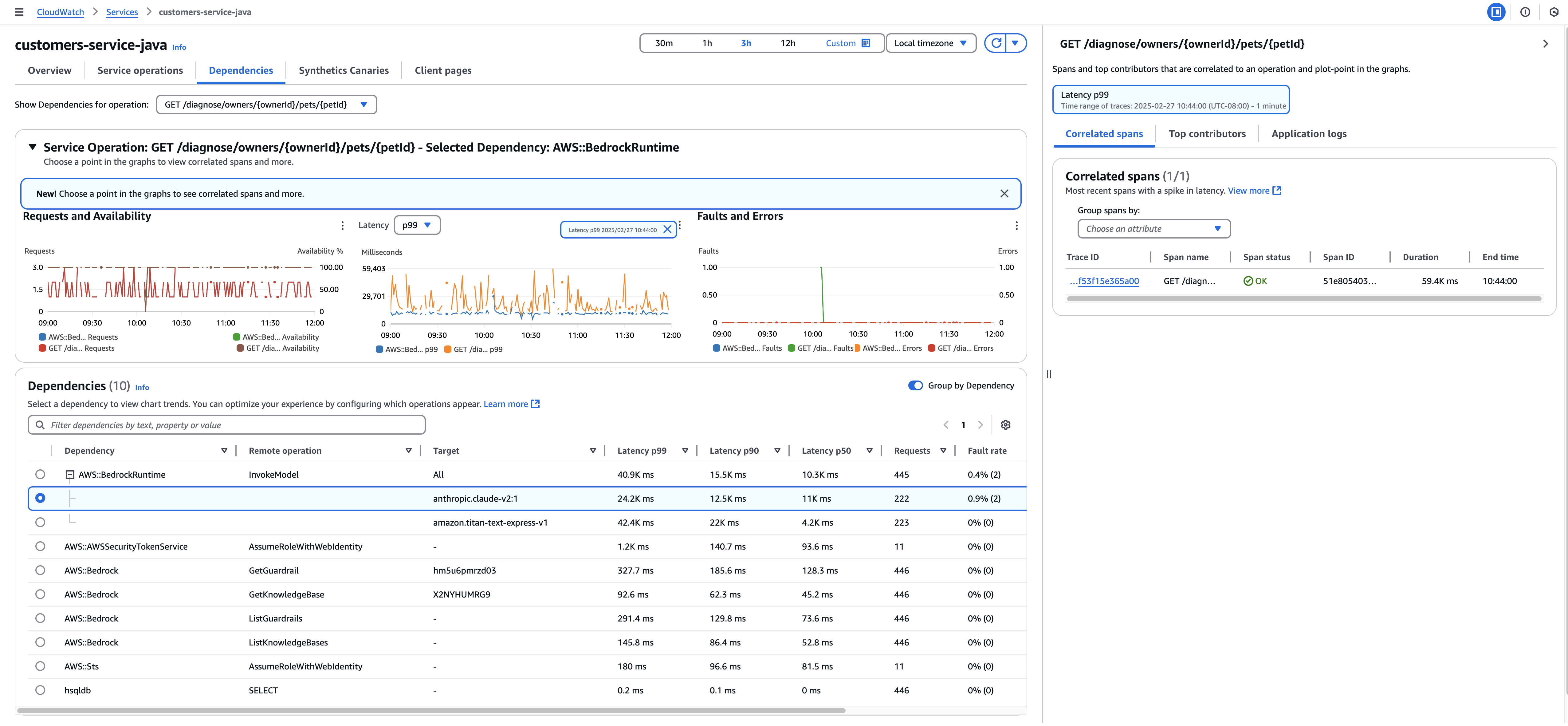

Puoi utilizzare Application Signals per risolvere i problemi delle tue applicazioni di IA generativa che interagiscono con i modelli Amazon Bedrock. Application Signals semplifica questo processo fornendo dati di telemetria pronti all'uso, offrendo informazioni più approfondite sulle interazioni dell'applicazione con i modelli LLM. Aiuta a risolvere casi d'uso chiave come:

Problemi di configurazione del modello

Costi di utilizzo del modello

Latenza del modello

Motivi dell'interruzione nella generazione delle risposte del modello

L'abilitazione di Application Signals con l'osservabilità di LLM/IA offre visibilità in tempo reale sulle interazioni dell'applicazione con i servizi Amazon Bedrock. Application Signals genera e correla automaticamente le metriche e le tracce delle prestazioni per le chiamate API Amazon Bedrock.

Application Signals attualmente supporta i seguenti modelli LLM di Amazon Bedrock.

AI21 Jamba

Amazon Titan

Anthropic Claude

Cohere Command

Meta Llama

Mistral AI

Nova

Metriche e tracce granulari

Per ogni chiamata API Amazon Bedrock, Application Signals genera metriche dettagliate sulle prestazioni a livello di risorsa, tra cui:

ID modello

ID guardrail

ID Knowledge Base

ID dell'agente Bedrock

Inoltre, gli intervalli di traccia correlati allo stesso livello aiutano a fornire una visione completa dell'esecuzione delle richieste e delle dipendenze.

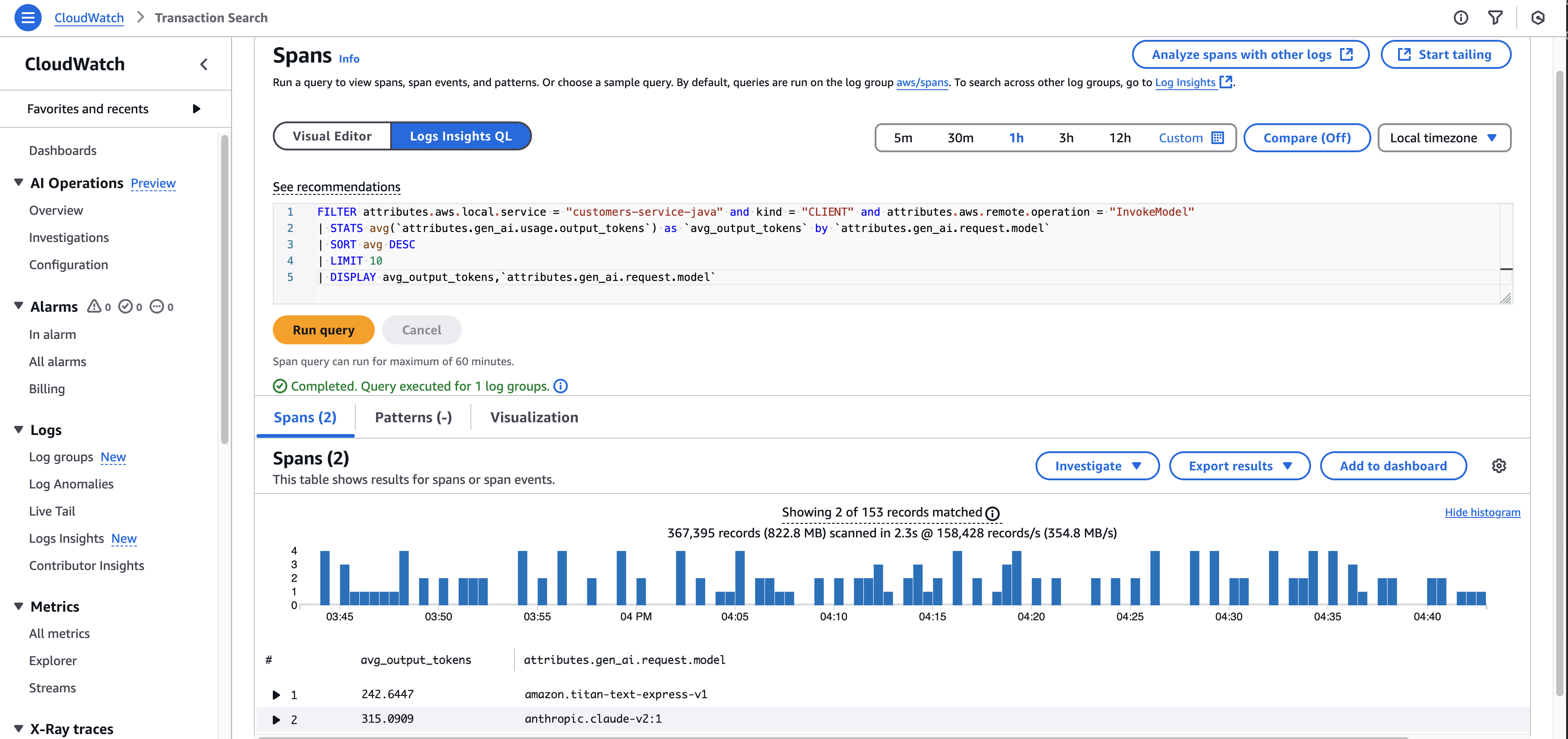

Supporto degli attributi di IA generativa di OpenTelemetry

Application Signals genera i seguenti attributi di IA generativa per le chiamate API Amazon Bedrock con la convenzione semantica OpenTelemetry. Questi attributi aiutano ad analizzare l'utilizzo del modello, i costi e la qualità della risposta e possono essere impiegati con Transaction Search per ottenere informazioni più approfondite.

gen_ai.system

gen_ai.request.model

gen_ai.request.max_tokens

gen_ai.request.temperature

gen_ai.request.top_p

gen_ai.usage.input_tokens

gen_ai.usage.output_tokens

gen_ai.response.finish_reasons

Ad esempio, è possibile sfruttare la capacità analitica di Transaction Search per confrontare l'utilizzo e il costo dei token tra diversi modelli LLM per lo stesso prompt, consentendo di selezionare i modelli in base all'efficienza in termini di costi.

Per ulteriori informazioni, consulta Improve Amazon Bedrock Observability with CloudWatch Application Signals