Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

Échelle de température

Dans les problèmes de classification, les probabilités prédites (sortie softmax) sont supposées représenter la vraie probabilité d'exactitude pour la classe prédite. Cependant, bien que cette hypothèse ait pu être raisonnable pour les modèles d'il y a dix ans, elle n'est pas vraie pour les modèles de réseaux neuronaux modernes d'aujourd'hui (Guo et al. 2017). La perte de lien entre les probabilités de prédiction des modèles et la fiabilité des prédictions des modèles empêcherait l'application des modèles de réseaux neuronaux modernes à des problèmes du monde réel, comme dans les systèmes de prise de décision. Connaître précisément le score de confiance des prédictions du modèle est l'un des paramètres de contrôle des risques les plus critiques requis pour créer des applications d'apprentissage automatique robustes et fiables.

Les modèles de réseaux neuronaux modernes ont tendance à avoir de grandes architectures avec des millions de paramètres d'apprentissage. La distribution des probabilités de prédiction dans de tels modèles est souvent fortement asymétrique, soit 1 soit 0, ce qui signifie que le modèle est trop sûr et que la valeur absolue de ces probabilités peut être dénuée de sens. (Ce problème est indépendant de la présence ou non d'un déséquilibre des classes dans l'ensemble de données.) Diverses méthodes d'étalonnage pour créer un score de confiance prédictif ont été développées au cours des dix dernières années par le biais d'étapes de post-traitement afin de recalibrer les probabilités naïves du modèle. Cette section décrit une méthode d'étalonnage appelée échelle de température, qui est une technique simple mais efficace pour recalibrer les probabilités de prédiction (Guo et al. 2017). La mise à l'échelle de la température est une version à paramètre unique de Platt Logistic Scaling (Platt 1999).

La mise à l'échelle de la température utilise un seul paramètre scalaire T > 0, où T est la température, pour redimensionner les scores logit avant d'appliquer la fonction softmax, comme le montre la figure suivante. Comme le même T est utilisé pour toutes les classes, la sortie softmax avec mise à l'échelle a une relation monotone avec la sortie non mise à l'échelle. Lorsque T = 1, vous récupérez la probabilité initiale avec la fonction softmax par défaut. Dans les modèles trop sûrs où T > 1, les probabilités recalibrées ont une valeur inférieure aux probabilités d'origine, et elles sont réparties de manière plus uniforme entre 0 et 1.

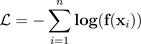

La méthode pour obtenir une température optimale T pour un modèle entraîné consiste à minimiser la probabilité logarithmique négative pour un ensemble de données de validation conservé.

Nous vous recommandons d'intégrer la méthode de mise à l'échelle de la température dans le cadre du processus d'apprentissage du modèle : une fois l'entraînement du modèle terminé, extrayez la valeur de température T à l'aide du jeu de données de validation, puis redimensionnez les valeurs logit en utilisant T dans la fonction softmax. Sur la base d'expériences menées dans le cadre de tâches de classification de texte à l'aide de modèles basés sur Bert, la température T varie généralement entre 1,5 et 3.

La figure suivante illustre la méthode de mise à l'échelle de la température, qui applique la valeur de température T avant de transmettre le score logit à la fonction softmax.

Les probabilités étalonnées par mise à l'échelle de la température peuvent représenter approximativement le score de confiance des prédictions du modèle. Cela peut être évalué quantitativement en créant un diagramme de fiabilité (Guo et al. 2017), qui représente l'alignement entre la distribution de la précision attendue et la distribution des probabilités de prédiction.

La mise à l'échelle de la température a également été évaluée comme un moyen efficace de quantifier l'incertitude prédictive totale dans les probabilités calibrées, mais elle n'est pas robuste pour capturer l'incertitude épistémique dans des scénarios tels que les dérives de données (Ovadia et al. 2019). Compte tenu de la facilité de mise en œuvre, nous vous recommandons d'appliquer une échelle de température aux résultats de votre modèle d'apprentissage profond afin de créer une solution robuste permettant de quantifier les incertitudes prédictives.