Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

Fonctionnement des agents Amazon Bedrock

|

Accélérez la mise en production des agents avec Amazon Bedrock AgentCore. AgentCore est une plateforme agentic permettant de créer, de déployer et d'exploiter des agents hautement performants en toute sécurité et à grande échelle. Pour plus d'informations, consultez le guide du AgentCore développeur. |

Les agents Amazon Bedrock comprennent les deux principaux ensembles d’opérations d’API suivants pour vous aider à configurer et à exécuter un agent :

-

Opérations d’API de développement pour créer, configurer et gérer vos agents et leurs ressources associées

-

Exécutez des opérations d’API pour invoquer votre agent avec les données saisies par l’utilisateur et pour lancer l’orchestration nécessaire à l’exécution d’une tâche

Configuration de développement

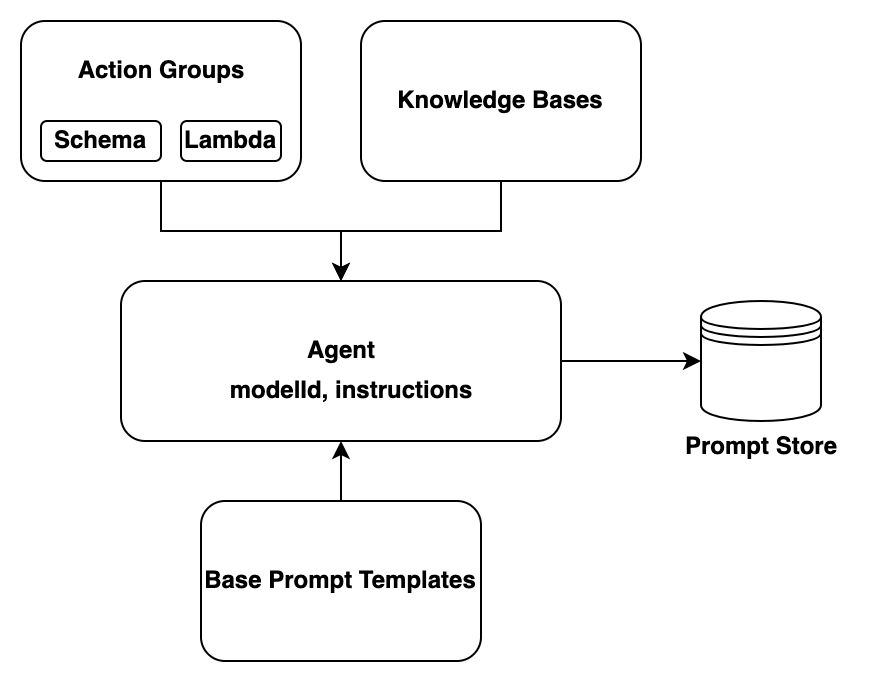

Un agent se compose des éléments suivants :

-

Modèle de fondation : vous choisissez un modèle de fondation (FM) que l’agent invoque pour interpréter les entrées utilisateur et les invites ultérieures dans le cadre de son processus d’orchestration. L’agent invoque également le modèle FM pour générer des réponses et des étapes de suivi de son processus.

-

Instructions : rédigez des instructions qui décrivent ce pour quoi l’agent est conçu. Grâce aux invites avancées, vous pouvez personnaliser davantage les instructions pour l’agent à chaque étape de l’orchestration et inclure des fonctions Lambda pour analyser le résultat de chacune de ces étapes.

-

Au moins l’un des éléments suivants :

-

Groupes d’actions : vous définissez les actions que l’agent doit effectuer pour l’utilisateur (en fournissant les ressources suivantes) :

-

L’un des schémas suivants pour définir les paramètres que l’agent doit obtenir de l’utilisateur (chaque groupe d’actions peut utiliser un schéma différent) :

-

Schéma OpenAPI permettant de définir les API que l’agent peut invoquer pour effectuer ses tâches. Le schéma OpenAPI inclut les paramètres qui doivent être obtenus auprès de l’utilisateur.

-

Schéma détaillé des fonctions pour définir les paramètres que l’agent peut obtenir de l’utilisateur. Ces paramètres peuvent ensuite être utilisés pour une orchestration plus poussée par l’agent, ou vous pouvez définir comment les utiliser dans votre propre application.

-

-

(Facultatif) : fonction Lambda avec les entrées et sorties suivantes :

-

Entrée : and/or paramètres de fonctionnement de l'API identifiés lors de l'orchestration.

-

Sortie : réponse de l’invocation de l’API ou réponse de l’invocation de la fonction.

-

-

-

Bases de connaissances : associez des bases de connaissances à un agent. L’agent interroge la base de connaissances pour obtenir du contexte supplémentaire et compléter ainsi la génération de réponses et la saisie dans les étapes du processus d’orchestration.

-

-

Modèles d’invite : les modèles d’invite sont à la base de la création d’invites à fournir au modèle FM. Les agents for Amazon Bedrock exposent les modèles d’invite de base par défaut utilisés lors du prétraitement, de l’orchestration, de la génération des réponses de la base de connaissances et du post-traitement. Vous pouvez modifier ces modèles d’invite de base pour personnaliser le comportement de l’agent à chaque étape de sa séquence. Vous pouvez également désactiver les étapes à des fins de dépannage ou si vous jugez qu’une étape n’est pas nécessaire. Pour de plus amples informations, veuillez consulter Amélioration de la précision des agents à l’aide de modèles d’invite avancés dans Amazon Bedrock.

Au moment de la création, tous ces composants sont rassemblés pour construire des invites de base pour l’agent afin d’effectuer l’orchestration jusqu’à ce que la demande de l’utilisateur aboutisse. Grâce aux invites avancées, vous pouvez modifier ces invites de base à l’aide d’une logique supplémentaire et de quelques exemples pour améliorer la précision de chaque étape de l’invocation de l’agent. Les modèles d’invite de base contiennent des instructions, des descriptions d’actions, des descriptions de la base de connaissances et un historique des conversations, que vous pouvez personnaliser pour adapter l’agent au mieux à vos besoins. Vous préparez ensuite l’agent, qui regroupe tous les composants des agents, y compris les configurations de sécurité. La préparation de l’agent le place dans un état où il peut être testé au moment de l’exécution. L’image suivante schématise la manière dont les opérations d’API de développement construisent votre agent.

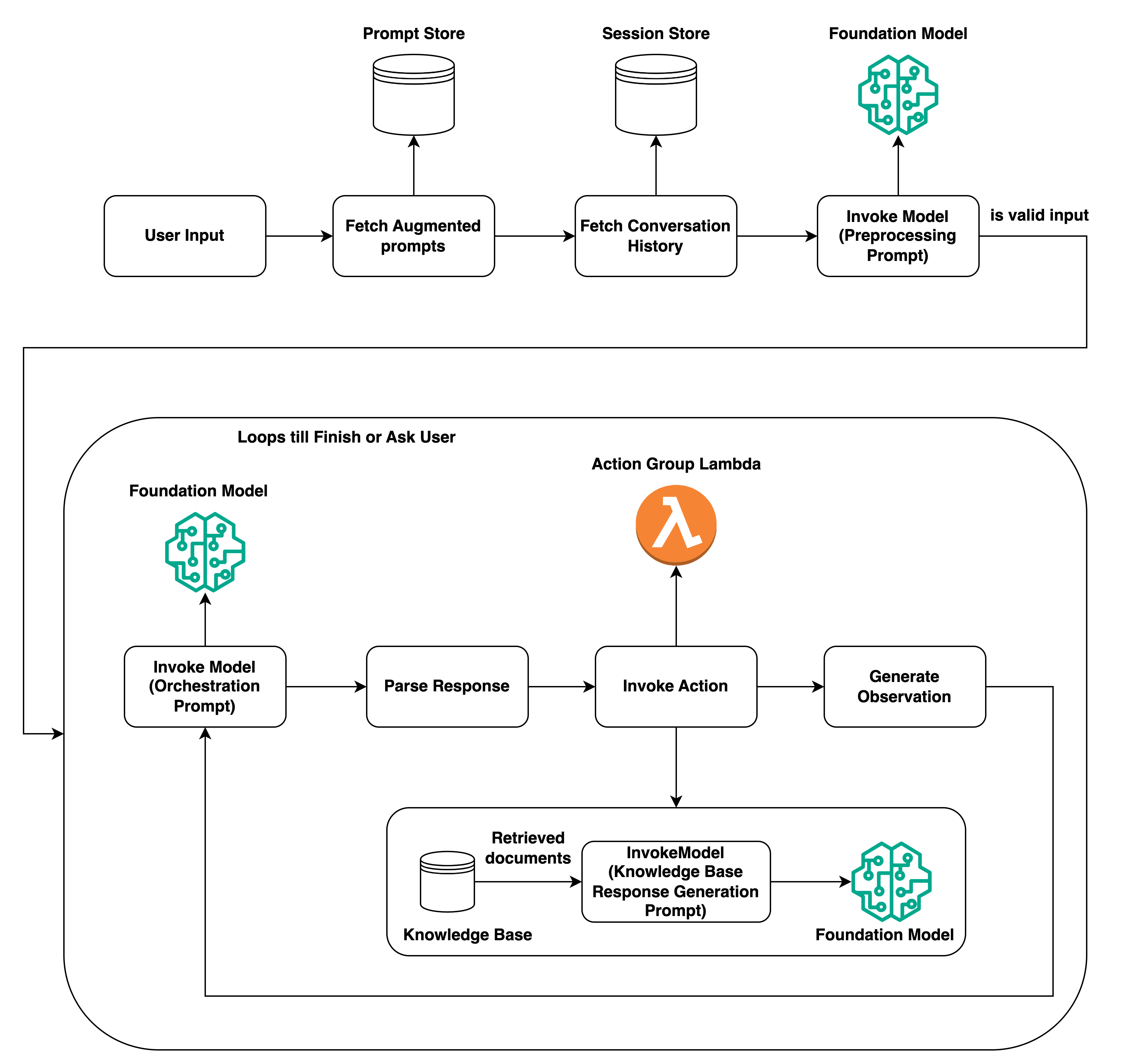

Processus d’exécution

L’exécution est gérée par l’opération d’API InvokeAgent. Cette opération démarre la séquence d’agents, qui comprend les trois étapes principales suivantes.

-

Prétraitement : gère la manière dont l’agent contextualise et catégorise les entrées utilisateur, ainsi que leur validité.

-

Orchestration : interprète les entrées utilisateur, invoque des groupes d’actions et interroge les bases de connaissances, et renvoie les résultats à l’utilisateur ou en tant qu’entrée pour une orchestration continue. L’orchestration comprend les étapes suivantes :

-

L’agent interprète l’entrée à l’aide d’un modèle de fondation et génère une justification qui expose la logique pour la prochaine étape à suivre.

-

L’agent prédit l’action d’un groupe d’actions qu’il doit invoquer ou la base de connaissances qu’il doit interroger.

-

Si l’agent prédit qu’il doit invoquer une action, il envoie les paramètres, déterminés à partir de l’invite de l’utilisateur, à la fonction Lambda configurée pour le groupe d’actions ou renvoie le contrôle en envoyant les paramètres dans la réponse InvokeAgent. Si l’agent ne dispose pas de suffisamment d’informations pour invoquer l’action, il peut effectuer l’une des actions suivantes :

-

Interroger une base de connaissances associée (génération de réponses de la base de connaissances) pour récupérer du contexte supplémentaire et synthétiser les données afin de compléter leur génération.

-

Demandez à nouveau à l’utilisateur de rassembler tous les paramètres requis pour l’action.

-

-

L'agent génère une sortie, connue sous le nom d'observation, en invoquant une action and/or résumant les résultats d'une base de connaissances. L’agent utilise l’observation pour compléter l’invite de base, qui sera ensuite interprétée à l’aide d’un modèle de fondation. L’agent détermine ensuite s’il doit réitérer le processus d’orchestration.

-

Cette boucle continue jusqu’à ce que l’agent soit prêt à renvoyer une réponse à l’utilisateur ou jusqu’à ce qu’il doive demander des informations supplémentaires à l’utilisateur.

Au cours de l’orchestration, le modèle d’invite de base est complété par les instructions de l’agent, les groupes d’actions et les bases de connaissances que vous avez ajoutés à l’agent. L’invite de base complétée est ensuite utilisée pour invoquer le modèle de fondation. Le modèle de fondation prédit les meilleures étapes et trajectoires possibles afin de répondre aux entrées utilisateur. À chaque itération de l’orchestration, le modèle de fondation prédit l’API à invoquer ou la base de connaissances à interroger.

-

-

Post-traitement : l’agent met en forme la réponse finale à renvoyer à l’utilisateur. Cette étape est désactivée par défaut.

Lorsque vous invoquez votre agent, vous pouvez activer une trace lors de l’exécution. Avec le trace, vous pouvez suivre le raisonnement, les actions, les requêtes et les observations de l’agent à chaque étape de sa séquence. Cette trace inclut l’invite complète envoyée au modèle de fondation à chaque étape et les résultats du modèle de fondation, les réponses de l’API et les requêtes de la base de connaissances. Vous pouvez utiliser cette logique pour comprendre le raisonnement de l’agent à chaque étape. Pour de plus amples informations, veuillez consulter Suivez le processus de step-by-step raisonnement de l'agent à l'aide de Trace.

Au fur et à mesure que la session utilisateur avec l’agent se poursuit suite à de nouvelles demandes InvokeAgent, l’historique des conversations est préservé. L’historique des conversations enrichit continuellement le modèle d’invite de base d’orchestration avec du contexte, ce qui contribue à améliorer la précision et les performances de l’agent. Le schéma suivant présente le processus de l’agent pendant l’exécution :