Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

Desde sistemas basados en eventos hasta sistemas con cognición aumentada

Las arquitecturas de nube modernas, especialmente las que se basan en los principios de la ausencia de servidores y las basadas en eventos, se han basado tradicionalmente en patrones como el enrutamiento, la distribución y el enriquecimiento para crear sistemas escalables y con capacidad de respuesta. Los sistemas de inteligencia artificial de las agencias se basan en estos fundamentos y, al mismo tiempo, los reformulan en torno al razonamiento y la flexibilidad cognitiva aumentados por la LLM. Este enfoque permite capacidades de automatización y resolución de problemas más sofisticadas, lo que podría revolucionar la forma en que se gestionan las tareas complejas en los entornos de nube.

Arquitectura basada en eventos

El siguiente diagrama muestra un sistema distribuido típico:

-

Un usuario envía una solicitud a Amazon API Gateway.

-

Amazon API Gateway enruta la solicitud a una AWS Lambda función.

-

AWS Lambda enriquece los datos consultando una base de datos de Amazon Aurora

-

Amazon API Gateway devuelve la carga útil enriquecida a la persona que llama.

Esta estructura es fiable y escalable, pero es fundamentalmente estática. Las reglas empresariales y las rutas lógicas deben codificarse de forma explícita, y la adaptación a los contextos cambiantes o a la información incompleta es limitada.

Flujos de trabajo con cognición aumentada

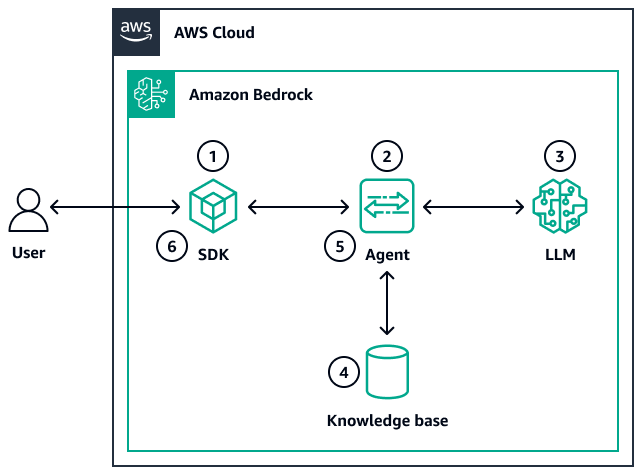

Las arquitecturas de los agentes añaden un aumento cognitivo a un sistema basado en eventos. El siguiente diagrama muestra el equivalente de un agente:

-

Un usuario envía una consulta a través de una llamada al SDK o a la API.

-

Un agente de Amazon Bedrock recibe la consulta.

-

El agente interpreta la consulta invocando un LLM

-

El agente realiza un enriquecimiento semántico buscando en la base de conocimiento de Amazon Bedrock u otras fuentes de datos externas.

-

El LLM sintetiza una respuesta rica en contexto y alineada con los objetivos.

-

El sistema devuelve una respuesta sintetizada al usuario.

En este flujo, el LLM utiliza la lógica, entiende la intención, recupera y combina el contexto relevante y, a continuación, decide la mejor manera de responder. Este patrón refleja el patrón de enriquecimiento tradicional, en el que los mensajes se complementan con datos externos antes de seguir enrutándolos. Sin embargo, en los sistemas de agencia, este enriquecimiento no es una búsqueda estática. Por el contrario, el enriquecimiento es dinámico, está guiado semánticamente y está impulsado por un propósito.

Perspectivas fundamentales

Cada flujo de trabajo de LLM se puede asignar a un patrón de flujo de trabajo de un agente, que refleja y evoluciona los estilos de arquitectura tradicionales basados en eventos. Un elemento básico de los flujos de trabajo de los agentes es la capacidad de aumentar el contexto de un LLM con datos, herramientas y memoria. Esto crea un ciclo de razonamiento informado, adaptable y alineado con la intención del usuario. Mientras que los sistemas tradicionales enriquecen los mensajes con datos de búsqueda, los sistemas de agencia permiten que el software actúe menos como guiones y más como colaboradores inteligentes.