Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Orchestrierungsmodelle: Von regelbasiert bis hin zu KI-nativ

In ereignisgesteuerten serverlosen KI-Systemen ist Orchestrierung die Verbindungslogik, die bestimmt, wie Ereignisse das Verhalten des Systems auslösen und prägen. Dabei AWS kann die Orchestrierung zwei Hauptmodellen folgen:

-

Die regelbasierte Orchestrierung wird von Entwicklern mithilfe von Workflows und Zustandsmaschinen definiert.

-

KI-native Orchestrierung basiert auf Agenten und großen Sprachmodellen (LLMs), die auf der Grundlage von Absicht und Kontext argumentieren, planen und handeln.

Jedes Modell spielt eine eigene Rolle beim Aufbau flexibler, reaktiver und intelligenter Systeme. Zusammen ermöglichen sie Entwicklern den Übergang von der Prozessautomatisierung zu autonomen, zielorientierten Systemen.

Regelbasierte Orchestrierung mit AWS Step Functions

Step Functions bietet eine visuelle Workflow-Engine zur Orchestrierung von Diensten wie Amazon AWS Lambda SageMaker, Amazon Bedrock, Amazon DynamoDB und Amazon Simple Storage Service (Amazon S3). Die Logik ist insofern deterministisch, als Schritte explizit definiert sind und Übergänge bedingungsbasiert sind.

Zu den wichtigsten Vorteilen der regelbasierten Orchestrierung mit Step Functions gehören:

-

Starke Überprüfbarkeit und Transparenz durch eine visuelle Workflow-Konsole

-

Integrierte Fehlerbehandlung, Wiederholungsversuche und Parallelität

-

Ideal für lineare oder verzweigte Kontrollabläufe mit klar definierten Pfaden

Das folgende Diagramm zeigt den Arbeitsablauf eines Beispielanwendungsfalls für die Erfassung und Verarbeitung von Dokumenten.

In diesem Beispiel automatisiert eine Anwaltskanzlei die Analyse hochgeladener Verträge in den folgenden Schritten:

-

Ereignisauslöser — Juristische Dokumente werden in einen Amazon S3 S3-Bucket hochgeladen, wodurch ein EventBridge Amazon-Ereignis ausgelöst wird, das an einen Step Functions Functions-Workflow weitergeleitet wird.

-

Workflow — Step Functions führt die folgenden Schritte aus:

-

Dokumentenverarbeitung — Eine Lambda-Funktion reinigt das Dokument und führt eine erste optische Zeichenerkennung (OCR) durch.

-

Textextraktion — Amazon Textract extrahiert wichtige Texte und Daten aus dem Dokument.

-

Analyse — Amazon Comprehend analysiert den Text, um das Risikoniveau und die Stimmung zu klassifizieren.

-

Zusammenfassung — Amazon Bedrock generiert eine kurze Zusammenfassung des Vertrags.

-

Datenspeicherung — Die Ergebnisse werden zur Indexierung in Amazon OpenSearch Service geschrieben.

-

-

Abruf — Die Rechtsabteilung kann Vertragsanalysen mithilfe von Dashboards suchen, filtern und visualisieren.

Diese Architektur nutzt die AWS SDK-Integrationsfunktionen von Step Functions, um direkt mit jedem AWS-Service im Workflow zu interagieren. Dieser Ansatz reduziert die Komplexität und macht separate Lambda-Funktionen zwischen den einzelnen Verarbeitungsschritten überflüssig. Das endgültige Schreiben in den OpenSearch Service wird ebenfalls über die SDK-Integration abgewickelt. Dadurch kann Step Functions die Ergebnisse der Dokumentenanalyse, Risikoklassifizierungen, Stimmungsanalysen und KI-generierte Zusammenfassungen direkt in Service indizieren. OpenSearch Das Rechtsteam kann über Dashboards auf die Informationen zugreifen, um Vertragsanalysen zu suchen, zu filtern und zu visualisieren.

Jede Aufgabe hat einen definierten Status mit integrierter Fehlerbehandlung. Die KI trifft keine Entscheidungen, und die Orchestrierung ist explizit.

KI-native Orchestrierung mit Amazon Bedrock Agents

Während Step Functions den Ablauf der Dinge verwaltet, entscheiden Agenten von Amazon Bedrock auf der Grundlage der Benutzerziele, was passieren soll. Ein Amazon Bedrock-Agent oder Agenten, die auf Amazon Bedrock basieren, AgentCore kombinieren Folgendes:

-

Ein LLM wie Anthropic Claude oder Amazon Nova

-

Eine Reihe von Tool-Integrationen wie Lambda-Funktionen (oder Model Context Protocol (MCP) -Client zur Ausführung von MCP-Integrationen)

-

Optionale Wissensdatenbanken zur kontextuellen Fundierung

-

Integrierter Speicher und Zielverfolgung

Agenten interpretieren Eingaben in natürlicher Sprache, analysieren sie und rufen selbständig Tools auf, um die Absicht des Benutzers zu erfüllen, wodurch die Orchestrierungslogik auf das Modell übertragen wird.

Zu den wichtigsten Vorteilen der KI-nativen Orchestrierung mit Amazon Bedrock Agents gehören:

-

Semantische Flexibilität — Interpretieren Sie verschiedene Eingaben in natürlicher Sprache.

-

Autonomie der Tools — Wählen Sie zur Laufzeit die richtigen Tools aus.

-

Kontextuelle Grundlage — Zitieren Sie Inhalte der Wissensdatenbank korrekt.

-

Minimaler Wartungsaufwand für Entwickler — Definieren Sie die Tools und nicht den Ablauf.

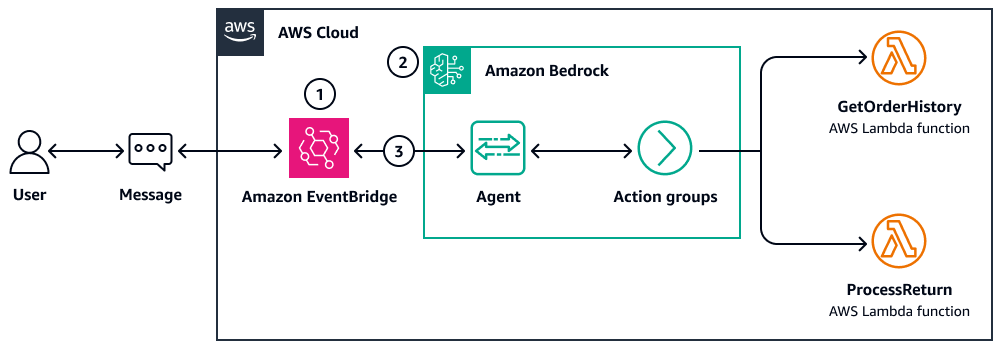

Das folgende Diagramm zeigt den Arbeitsablauf eines Beispielanwendungsfalls für die Automatisierung des Kundensupports mit Amazon Bedrock Agents.

In diesem Beispiel gibt ein Benutzer auf einer Einzelhandels-Website eine Nachricht in den Support-Chatbot ein. Der folgende Workflow findet statt:

-

Die Aktionen, die ein Ereignis auslösen, lauten wie folgt:

-

Der Benutzer sendet eine Nachricht: „Ich muss die Schuhe, die ich letzte Woche bestellt habe, zurückgeben. Kannst du helfen?“

-

Die Nachricht wurde empfangen und weitergeleitet EventBridge.

-

EventBridge löst den Amazon Bedrock-Agenten aus.

-

-

Der Argumentationsprozess des Agenten sieht wie folgt aus:

-

Extraktion der Absicht — Der Agent identifiziert die Absicht als „Rücksendeauftrag“.

-

Datenabruf — Der Agent fragt das CRM-System mithilfe der

GetOrderHistoryLambda-Funktion ab. -

Eignungsprüfung — Der Agent ruft die

ProcessReturnLambda-Funktion auf, um die Eignung für Rücksendungen zu überprüfen. -

Generierung von Antworten — Der Agent formuliert eine angemessene Antwort.

-

-

Die Aktion zur Kundenkommunikation erfolgt, wenn der Mitarbeiter antwortet: „Ihre Rücksendung wird bearbeitet. Erwarten Sie in Kürze eine Bestätigungs-E-Mail.“

Der gesamte Workflow zeigt, wie Amazon Bedrock Agents komplexe Geschäftslogik mithilfe definierter Aktionsgruppen orchestriert. Durch die Verbindung der Kundenabsichten mit Backend-Systemen und -Prozessen wird ein automatisiertes und dennoch kontextgerechtes Kundenservice-Erlebnis ermöglicht.

Amazon Bedrock AgentCore erweitert das Amazon Bedrock-Ökosystem über einzelne Agenten hinaus und bietet eine vollständige Laufzeit- und Speicherarchitektur für autonome, ereignisgesteuerte KI-Systeme.

Amazon Bedrock Agents konzentrieren sich auf die Orchestrierung von Argumentations- und Handlungssequenzen für eine einzelne Aufgabe oder Domäne. AgentCore stellt die zugrunde liegende Infrastruktur bereit, um Multi-Agent-Workflows in verteilten serverlosen Umgebungen zusammenzustellen, zu koordinieren und aufrechtzuerhalten.

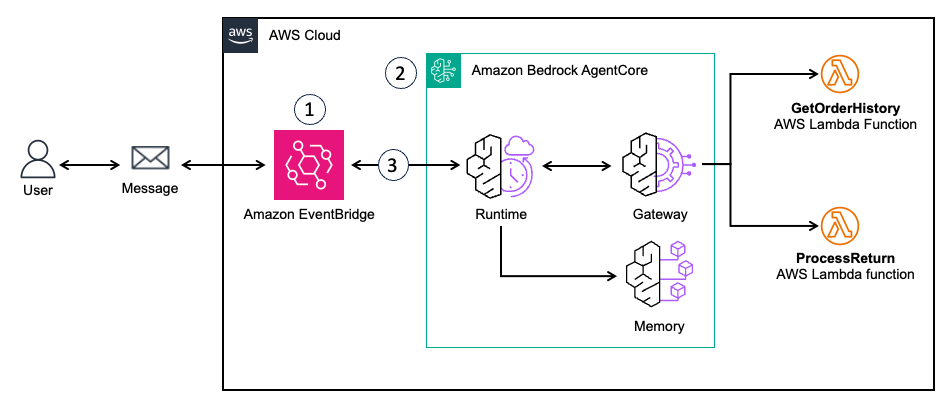

Das folgende Diagramm zeigt den Arbeitsablauf eines Beispielanwendungsfalls für die Automatisierung des Kundensupports mit. AgentCore

Dieses Beispiel folgt den gleichen Aktionen wie das vorherige Beispiel für Amazon Bedrock Agents: Ein Benutzer auf einer Einzelhandels-Website gibt eine Nachricht in den Support-Chatbot ein. Der folgende Arbeitsablauf findet statt:

-

Der Benutzer sendet eine Nachricht: „Ich muss die Schuhe, die ich letzte Woche bestellt habe, zurückgeben. Kannst du helfen?“

-

Die Nachricht wurde empfangen und weitergeleitet EventBridge.

-

EventBridge löst den AgentCore Runtime-Endpunkt aus.

AgentCore führt drei wichtige Funktionen ein, die bestehende Orchestrierungsmodelle ergänzen:

-

AgentCore Runtime — Eine verwaltete Ausführungsumgebung, in AWS der benutzerdefinierte Agentenlogik ausgeführt wird. Es lässt sich nativ in Amazon ECS integrieren, um das Verhalten der Agenten nach Bedarf zu skalieren, sodass die Container- oder Funktionsinfrastruktur nicht manuell verwaltet werden muss. AWS Lambda

-

AgentCore Arbeitsspeicher — Bietet persistenten, strukturierten Speicher für Kontext, Status und Aufgabenverlauf. Auf diese Weise können Agenten die Kontinuität zwischen Aufrufen und Workflows aufrechterhalten und sowohl kurzlebige als auch Langzeitspeichermodi unterstützen. Speicherdaten können zur Überwachung und Einhaltung von Vorschriften mit DynamoDB oder Amazon Simple Storage Service (Amazon S3) synchronisiert werden.

-

AgentCore Gateway — Verwaltete Schnittstellen für sicheren AWS-Services und externen Zugriff APIs über Model Context Protocol (MCP). Diese Konnektoren ermöglichen es Agenten, direkt mit Unternehmensdaten, Tools und Anwendungen zu interagieren, was eine umfassendere Orchestrierung ohne benutzerdefinierten Integrationscode ermöglicht.

Zusammen ermöglichen diese Komponenten den Aufbau adaptiver Systeme mit mehreren Agenten, die in serverlosen, ereignisgesteuerten Architekturen eingesetzt werden können. AgentCoreRuntime kann beispielsweise mehrere spezialisierte Agenten hosten, die sich über EventBridge oder Step Functions koordinieren, wobei sie AgentCore Speicher verwenden, um den Kontext gemeinsam zu nutzen und deterministische, überprüfbare Ergebnisse sicherzustellen.

Durch die Verbindung von Kundeninteressen mit Backend-Systemen und -Prozessen wird ein automatisiertes und dennoch kontextgerechtes Kundenservice-Erlebnis AgentCore ermöglicht.

Die Orchestrierung ist nicht fest codiert. Das LLM bestimmt den Arbeitsablauf dynamisch, wodurch das System widerstandsfähiger gegenüber Schwankungen und Mehrdeutigkeiten bei Eingaben wird.

Regelbasiert oder KI-nativ: Wann sollte was verwendet werden?

AWS Step Functions und Amazon Bedrock Agents zeichnen sich jeweils durch unterschiedliche Orchestrierungsszenarien aus. Es hat sich bewährt, Step Functions für kontrollierte Prozesse und Amazon Bedrock Agents für Interaktionen in natürlicher Sprache und flexible Zielerfüllung zu verwenden. In der folgenden Tabelle werden diese Dienste für verschiedene Anwendungsfälle verglichen.

Art des Anwendungsfalls |

Step Functions (regelbasiert) |

Amazon Bedrock Agents (KI-nativ) |

|---|---|---|

Deterministischer Arbeitsablauf |

Ideal |

Nicht benötigt. |

Unstrukturierte Benutzereingaben |

Starr |

Interpretiert und passt sich an. |

Komplexe Geschäftsregeln |

Modellieren Sie mithilfe von Bedingungen |

Kann mithilfe von semantischem Denken folgern. |

Erfordert einen detaillierten Prüfpfad |

Vollständige Statusverfolgung |

Eingeschränkte Ablaufverfolgung, abhängig von den Agentenprotokollen. Tools wie Gewichtungen, Verzerrungen und die Protokollierung von Modellaufrufen können diese Einschränkung jedoch verringern. |

Latenzempfindliche Automatisierung |

Koordination in Echtzeit |

In Echtzeit, wenn auch aufgrund der LLM-Verarbeitung etwas höher. |

Zielgerichtete Benutzererlebnisse |

Erfordert explizites Design |

Der Agent kann das Ziel ableiten und den Ablauf zusammenstellen. |

Ereignisgesteuerte Orchestrierung

Unabhängig davon, ob regelbasierte oder KI-native Orchestrierung verwendet wird, sind Ereignisse der Mechanismus, der Intelligenz in einem serverlosen System aktiviert. In beiden Orchestrierungsmodellen tritt die folgende Reihenfolge auf:

-

Ein Ereignis wird durch EventBridge ausgelöst. Beispiele für ein Ereignis sind Benutzereingaben, Uploads von Dokumenten und Transaktionen.

-

Dieses Ereignis löst den entsprechenden Orchestrator aus:

-

Step Functions, wenn die Logik deterministisch ist

-

AWS Lambda oder Amazon ECS-Aufgaben für AWS native Runtime, die EventBridge für choreografiertes Design abonniert wurden

-

Amazon Bedrock Agents, wenn die Logik dynamisch oder dialogorientiert ist

-

-

AgentCore Agenten können EventBridge Ereignisse mithilfe des SDK nativ senden und abonnieren. AgentCore

Bei diesem Ansatz nehmen Agenten direkt an serverlosen Workflows teil und behalten gleichzeitig den langfristigen Kontext über den AgentCore Arbeitsspeicher bei. Diese Integration bildet eine duale Kommunikationsebene: -

EventBridge bietet deterministisches, überprüfbares Event-Routing.

-

AgentCore Memory plus the Agent2Agent Protocol (A2A) ermöglicht die gemeinsame Nutzung von semantischen Zuständen und die Erkennung von Fähigkeiten.

-

-

Jeder Orchestrator koordiniert KI-Dienste und sendet weitere Ereignisse wie Abschluss, Fehler und nachgeschaltete Trigger aus.

Dieses reaktive Modell gewährleistet Skalierbarkeit, Belastbarkeit und modulares Design, sodass sich Teile des Systems unabhängig voneinander weiterentwickeln können.

Strategische Perspektive

EDA unterstützt sowohl regelbasierte Orchestrierung als auch KI-native Orchestrierungsmodelle und ermöglicht die Koexistenz beider Modelle. Step Functions bietet zuverlässige, wiederholbare Automatisierung und Amazon Bedrock Agents bietet dynamische, kontextsensitive Intelligenz.

Zusammen bieten sie Unternehmen die Möglichkeit, Folgendes zu tun:

-

Automatisieren Sie sich wiederholende, umfangreiche Prozesse

-

Bieten Sie intelligente, anpassungsfähige, benutzerorientierte Assistenten

-

Skalieren Sie KI ohne Engpässe oder architektonische Starrheit

Bei der Orchestrierung geht es nicht mehr nur um Regeln, sondern auch um die Interpretation von Absichten, die Auswahl von Tools und die autonome Ausführung. Serverless On AWS kombiniert AWS Step Functions strukturierte Workflows und Amazon Bedrock Agents für semantische Orchestrierung. Dieses einheitliche Framework ermöglicht den Aufbau der nächsten Generation von agentischen, serverlosen KI-Systemen.