Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Toolbasierte Agenten zum Aufrufen von Funktionen

Toolbasierte Agenten erweitern die Fähigkeiten von Argumentationsagenten, indem sie externe Funktionen aufrufen oder Aufgaben erledigen, die über das rein APIs sprachliche Denken hinausgehen. Dieses Muster verwendet ein LLM, um zu entscheiden, welches Tool verwendet werden soll, generiert dann Anrufargumente und bezieht die Ergebnisse eines Tools in seine Argumentationsschleife ein.

Dieses Muster ermöglicht es den Agenten, zu handeln, anstatt nur Antworten zu geben. Die Tool-Schnittstelle steht für jede aufrufbare Funktion, von arithmetischen Berechnungen und Datenbankabfragen bis hin zu externen APIs Diensten und Cloud-Diensten.

Architektur

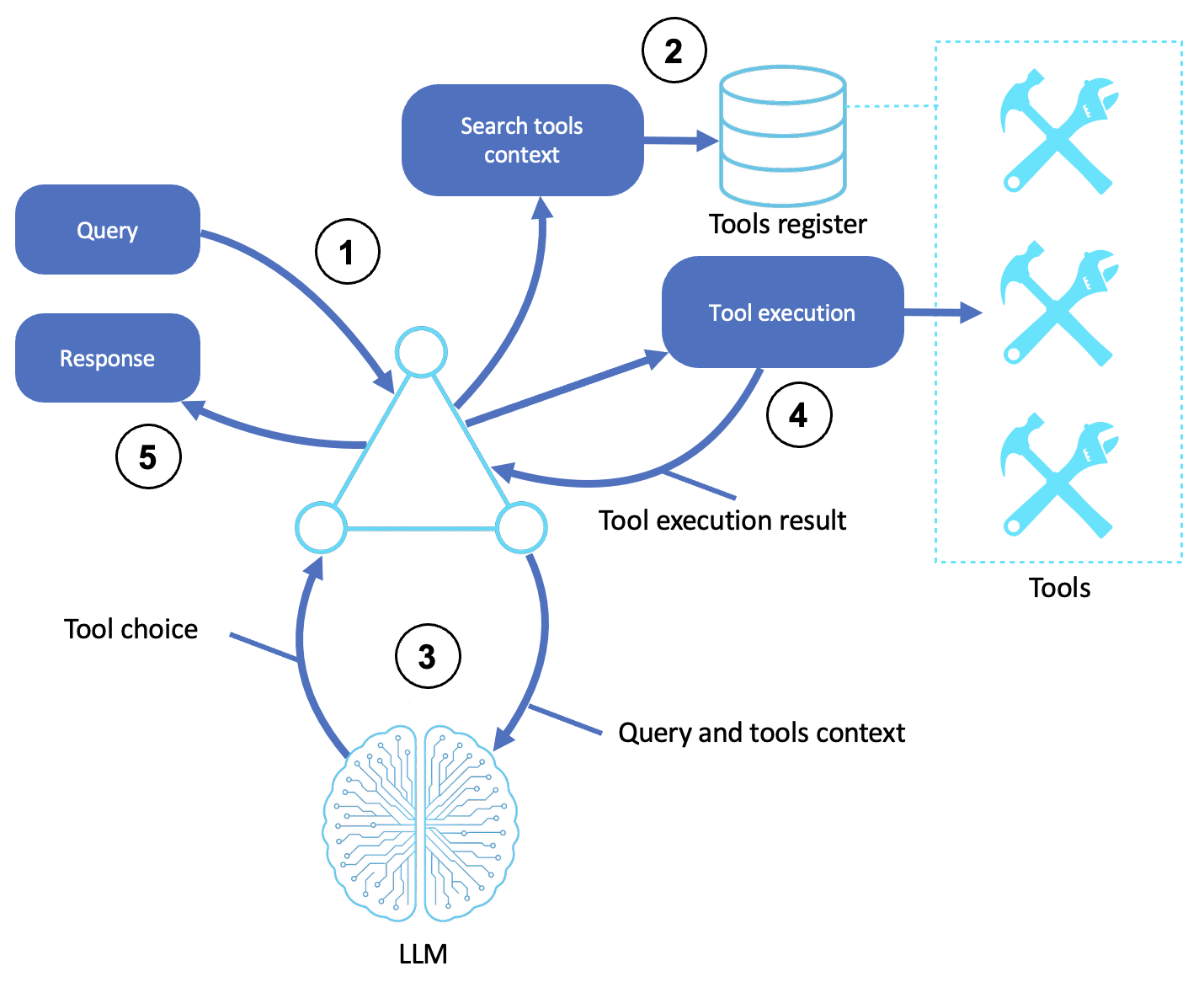

In der folgenden Abbildung ist ein toolbasierter Agent zum Aufrufen von Funktionen dargestellt:

Description

-

Empfängt eine Anfrage

-

Der Agent erhält eine Anfrage oder Aufgabe in natürlicher Sprache vom Benutzer oder vom aufrufenden System.

-

-

Sucht nach Tools

-

Der Agent verwendet interne Metadaten oder eine Tool-Registry, um nach verfügbaren Tools, Schemas und relevanten Funktionen zu suchen.

-

-

Wählt Tools aus und ruft sie auf

-

Das LLM empfängt die Abfrage- und Tool-Metadaten (z. B. Funktionsnamen, Eingabetypen und Beschreibungen) in seiner Eingabeaufforderung.

-

Es wählt das relevanteste Tool aus, konstruiert Eingabeargumente und gibt einen strukturierten Funktionsaufruf zurück.

-

-

Führt das gewählte Tool aus

-

Die Agent-Shell oder der Tool Runner führt die ausgewählte Funktion aus und gibt das Ergebnis zurück (z. B. eine API-Ausgabe, einen Datenbankwert oder eine Berechnung).

-

-

Gibt eine Antwort zurück

-

Das LLM leitet die Ergebnisse entweder direkt oder als Teil einer aktualisierten Aufforderung an den Agenten weiter. Anschließend wird ein Ergebnis in natürlicher Sprache zurückgegeben.

-

Capabilities

-

Dynamische Werkzeugauswahl basierend auf dem Aufgabenkontext

-

Schemabasierte Eingabeaufforderung (OpenAPI, JSON-Schema, Funktionsschnittstelle) AWS

-

Interpretation der Ergebnisse und Verkettung der Ergebnisse zu Argumenten

-

Zustandslose oder sitzungsabhängige Operationen

Häufige Anwendungsfälle

-

Virtuelle Assistenten mit externem Datenzugriff

-

Finanzrechner und Schätzer

-

API-basierte Wissensarbeiter

-

LLMs die SageMaker Amazon-Endpunkte und SaaS-Dienste aufrufen AWS Lambda

Implementierungsleitfaden

Verwenden Sie Folgendes, um toolbasierte Agenten zum Aufrufen von Funktionen zu erstellen:

-

Amazon Bedrock mit Unterstützung für Funktionsaufrufe (Anthropic Claude)

-

AWS Lambda als Backend für die Ausführung von Tools

-

Amazon API Gateway oder AWS Step Functions für die Orchestrierung von Tools

-

Amazon DynamoDB oder Amazon Relational Database Service (Amazon RDS) für kontextsensitive Tool-Metadaten

-

EventBridge Amazon-Pipelines oder AWS Step Functions die Staaten zuordnen, um Ausgaben weiterzuleiten

Zusammenfassung

Agenten, die über Tools Funktionen aufrufen, bedeuten eine Verlagerung vom Sprachverständnis hin zur Ausführung von Aktionen. Diese Agenten nutzen dynamische, kontextsensitive Tools und behalten gleichzeitig die LLM-Argumentation bei. Sie verwandeln passive Assistenten in Systeme, die Aufgaben erledigen, auf Dienste zugreifen und Geschäftsabläufe integrieren. Dieses Muster ist ein wichtiger Bestandteil der agentischen KI in Unternehmensumgebungen, insbesondere in Kombination mit deklarativen Schemas, Autorisierungs-Frameworks und Systemen mit mehreren Agenten.