Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Sofortige Verkettung von Saga-Mustern

Indem wir LLM-Prompt-Chaining als ereignisgesteuerte Saga neu erfinden, erschließen wir ein neues Betriebsmodell: Workflows werden auf autonome Agenten verteilt, wiederherstellbar und semantisch koordiniert. Jeder Prompt-Response-Schritt wird als atomare Aufgabe neu formuliert, als Ereignis ausgegeben, von einem speziellen Agenten verarbeitet und mit kontextuellen Metadaten angereichert.

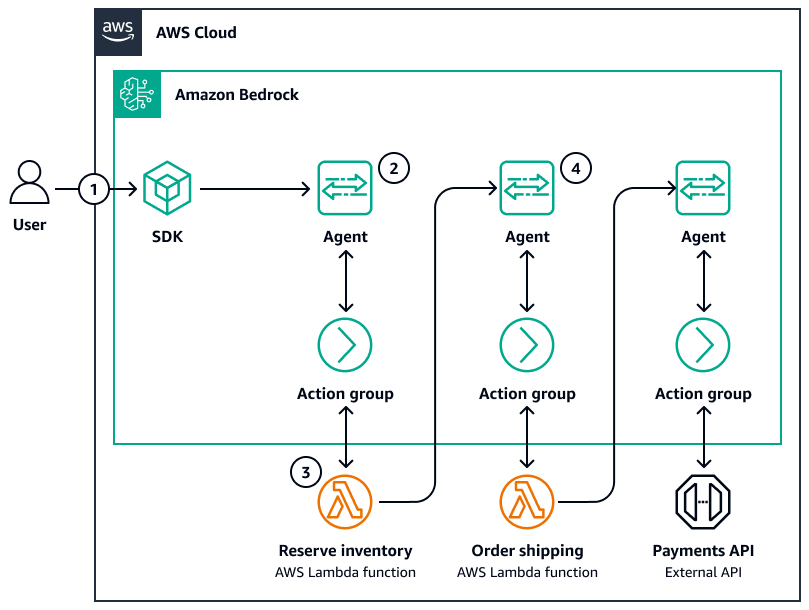

Das folgende Diagramm ist ein Beispiel für die Verkettung von LLM-Eingabeaufforderungen:

Saga-Choreographie

Das Saga-Choreographie-Muster ist ein Implementierungsansatz in verteilten Systemen, für den es keinen zentralen Koordinator gibt. Stattdessen veröffentlicht jeder Dienst oder jede Komponente Ereignisse, die die nächste Workflow-Aktion auslösen. Dieses Muster wird häufig in verteilten Systemen zur Verwaltung von Transaktionen über mehrere Dienste hinweg verwendet. In einer Saga führt das System eine Reihe koordinierter lokaler Transaktionen durch. Wenn eine davon ausfällt, löst das System Ausgleichsmaßnahmen aus, um die Konsistenz aufrechtzuerhalten.

Das folgende Diagramm ist ein Beispiel für eine Saga-Choreographie:

-

Inventar reservieren

-

Zahlung autorisieren

-

Versandauftrag erstellen

Schlägt Schritt 3 fehl, leitet das System Ausgleichsmaßnahmen ein (z. B. eine Zahlung stornieren oder Inventar freigeben).

Dieses Muster ist besonders nützlich in ereignisgesteuerten Architekturen, in denen Dienste lose miteinander verknüpft sind und Zustände im Laufe der Zeit konsistent behoben werden müssen, selbst bei teilweisem Ausfall.

Muster für die schnelle Verkettung

Die schnelle Verkettung ähnelt in ihrer Struktur und ihrem Zweck dem Saga-Muster. Es führt eine Reihe von Argumentationsschritten aus, die nacheinander aufgebaut werden, wobei der Kontext erhalten bleibt und Rollbacks und Überarbeitungen möglich sind.

Choreographie der Agenten

-

LLM interpretiert eine komplexe Benutzerabfrage und generiert eine Hypothese

-

LLM erarbeitet einen Plan zur Lösung der Aufgabe

-

LLM führt eine Unteraufgabe aus (z. B. mithilfe eines Tool-Aufrufs oder durch das Abrufen von Wissen)

-

LLM verfeinert die Ausgabe oder wiederholt einen früheren Schritt, wenn es ein Ergebnis für unbefriedigend hält

Wenn ein Zwischenergebnis fehlerhaft ist, kann das System einen der folgenden Schritte ausführen:

-

Wiederholen Sie die Schritte mit einem anderen Ansatz

-

Kehren Sie zu einer vorherigen Eingabeaufforderung zurück und planen Sie neu

-

Verwenden Sie eine Evaluatorschleife (z. B. anhand des Evaluator-Optimizer-Musters), um Fehler zu erkennen und zu korrigieren

Wie beim Saga-Muster ermöglicht die Verkettung von Eingabeaufforderungen teilweise Fortschritts- und Rollback-Mechanismen. Dies geschieht eher durch iterative Verfeinerung und LLM-gesteuerte Korrektur als durch kompensierende Datenbanktransaktionen.

Das folgende Diagramm ist ein Beispiel für die Choreographie eines Agenten:

-

Ein Benutzer sendet eine Anfrage über ein SDK.

-

Ein Amazon Bedrock-Agent orchestriert die Argumentation wie folgt:

-

Dolmetschen (LLM)

-

Planung (LLM)

-

Ausführung über ein Tool oder eine Wissensdatenbank

-

Konstruktion der Antwort

-

-

Wenn ein Tool ausfällt oder unzureichende Daten zurückgibt, kann der Agent die Aufgabe dynamisch neu planen oder umformulieren.

-

Speicher (z. B. ein kurzfristiger Vektorspeicher) kann seinen Zustand stufenübergreifend beibehalten

Imbissbuden

Während das Saga-Muster verteilte Serviceanrufe mit kompensierender Logik verwaltet, erledigt Prompt Chaining Denkaufgaben mit reflektierter Reihenfolge und adaptiver Neuplanung. Beide Systeme ermöglichen inkrementellen Fortschritt, dezentrale Entscheidungspunkte und die Behebung von Fehlern, und das alles durch fundierte Argumentation und nicht durch starres Rollback.

Prompt Chaining führt Transaktionsdenken ein, das kognitive Äquivalent von Sagen ist. Das heißt, jeder „Gedanke“ wird im Rahmen eines umfassenderen zielgerichteten Dialogs neu bewertet, überarbeitet oder aufgegeben.