Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Von ereignisgesteuerten zu kognitionserweiterten Systemen

Moderne Cloud-Architekturen, insbesondere solche, die auf serverlosen und ereignisgesteuerten Prinzipien basieren, verlassen sich traditionell auf Muster wie Routing, Fan-Out und Anreicherung, um reaktionsschnelle, skalierbare Systeme zu schaffen. Agentische KI-Systeme bauen auf diesen Grundlagen auf und orientieren sie gleichzeitig an LLM-gestütztem Denken und kognitiver Flexibilität. Dieser Ansatz ermöglicht ausgefeiltere Problemlösungs- und Automatisierungsfunktionen und könnte die Art und Weise, wie komplexe Aufgaben in Cloud-Umgebungen gehandhabt werden, revolutionieren.

Ereignisgesteuerte Architektur

Das folgende Diagramm zeigt ein typisches verteiltes System:

-

Ein Benutzer sendet eine Anfrage an Amazon API Gateway.

-

Amazon API Gateway leitet die Anfrage an eine AWS Lambda Funktion weiter.

-

AWS Lambda führt eine Datenanreicherung durch Abfrage einer Amazon Aurora Aurora-Datenbank durch

-

Amazon API Gateway gibt die angereicherte Nutzlast an den Aufrufer zurück.

Diese Struktur ist sowohl zuverlässig als auch skalierbar, aber sie ist grundsätzlich statisch. Geschäftsregeln und logische Pfade müssen explizit codiert werden, und die Anpassung an sich ändernde Kontexte oder unvollständige Informationen ist begrenzt.

Kognitionsgestützte Arbeitsabläufe

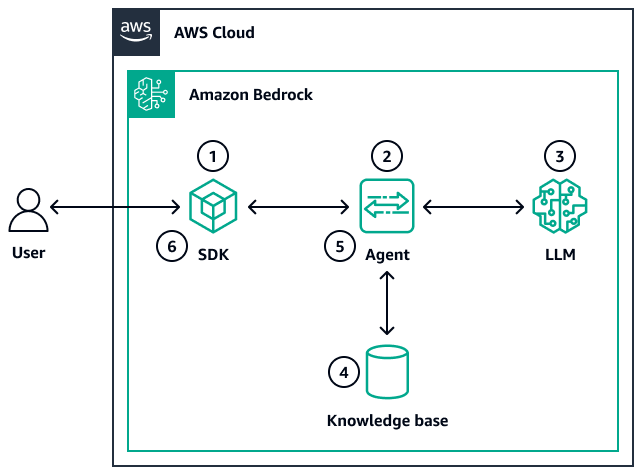

Agentenarchitekturen erweitern ein ereignisgesteuertes System um kognitive Augmentation. Das folgende Diagramm zeigt ein agentisches Äquivalent:

-

Ein Benutzer sendet eine Anfrage über einen SDK- oder API-Aufruf.

-

Ein Amazon Bedrock-Agent erhält die Anfrage.

-

Der Agent interpretiert die Anfrage, indem er ein LLM aufruft

-

Der Agent führt eine semantische Anreicherung durch, indem er die Amazon Bedrock-Wissensdatenbank oder andere externe Datenquellen durchsucht.

-

Das LLM synthetisiert eine kontextreiche, zielgerichtete Antwort.

-

Das System gibt dem Benutzer eine synthetisierte Antwort zurück.

In diesem Ablauf verwendet das LLM Logik, versteht die Absicht, ruft den relevanten Kontext ab, kombiniert ihn und entscheidet dann, wie am besten reagiert werden soll. Dieses Muster spiegelt das traditionelle Anreicherungsmuster wider, bei dem Nachrichten mit externen Daten angereichert werden, bevor sie weitergeleitet werden. In Agentensystemen handelt es sich bei dieser Anreicherung jedoch nicht um eine statische Suche. Stattdessen ist die Anreicherung dynamisch, semantisch gesteuert und zielgerichtet.

Die wichtigsten Erkenntnisse

Jeder LLM-Workflow kann einem zentralen Workflow-Muster zugeordnet werden, das traditionelle ereignisgesteuerte Architekturstile widerspiegelt und weiterentwickelt. Ein grundlegender Baustein agentischer Workflows ist die Fähigkeit, den Kontext eines LLM um Daten, Tools und Speicher zu erweitern. Dadurch entsteht eine Argumentationsschleife, die fundiert, anpassungsfähig und auf die Benutzerabsichten abgestimmt ist. Während herkömmliche Systeme Nachrichten mit Suchdaten anreichern, ermöglichen es Agentensysteme der Software, sich weniger wie Skripte, sondern eher wie intelligente Kollaborateure zu verhalten.