Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Schleifenmuster im Evaluator reflektieren/verfeinern

Aufgaben wie Codegenerierung, Zusammenfassung oder autonome Entscheidungsfindung profitieren in hohem Maße vom Feedback zur Laufzeit, sodass sich das System durch Beobachtung und Verfeinerung weiterentwickeln kann. Um dies zu operationalisieren, kann der Reflect-Refine-Zyklus als ereignisgesteuerter Feedback-Regelkreis implementiert werden — ein von der Systemtechnik inspiriertes Muster, das für autonome, intelligente Workflows angepasst ist.

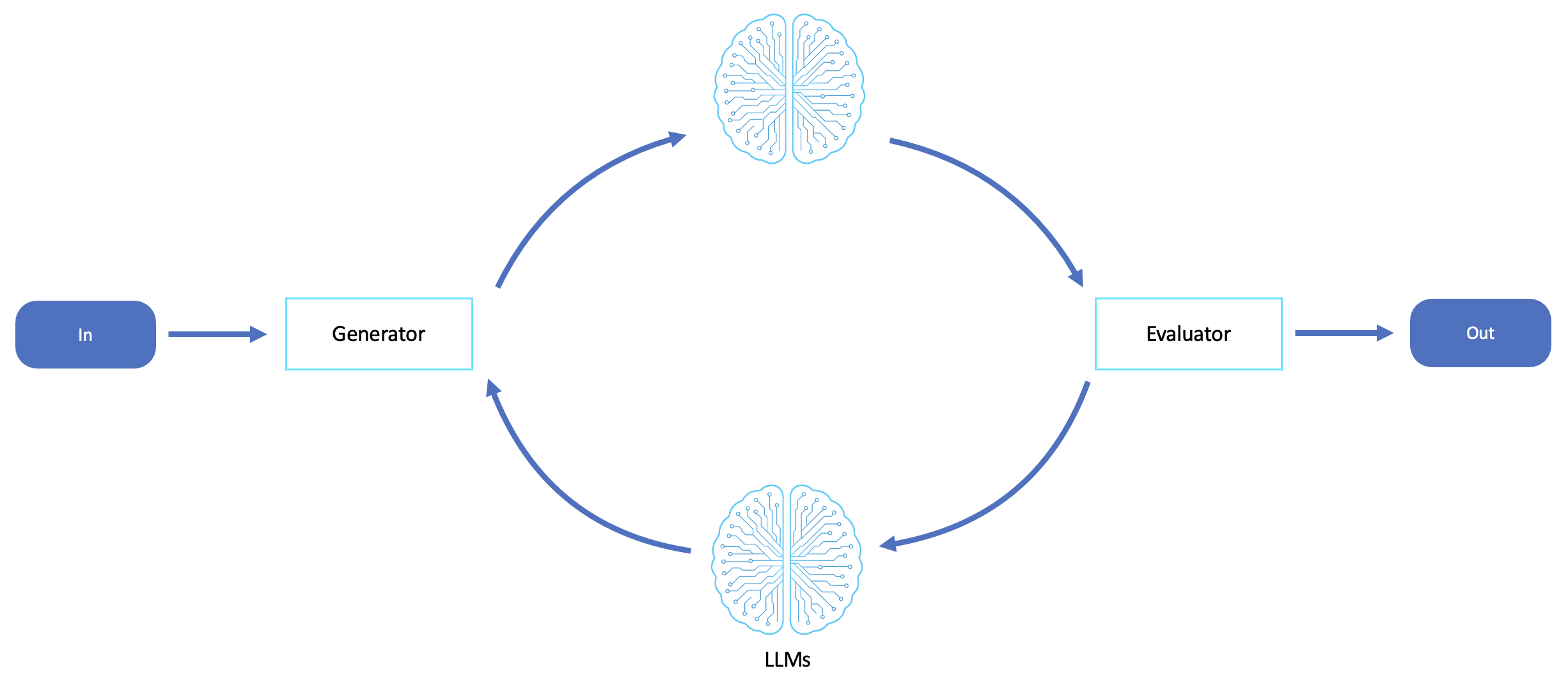

Das folgende Diagramm ist ein Beispiel für eine Reflect-Refine-Feedback-Schleife von Evaluatoren:

Regelkreis für Rückkopplung

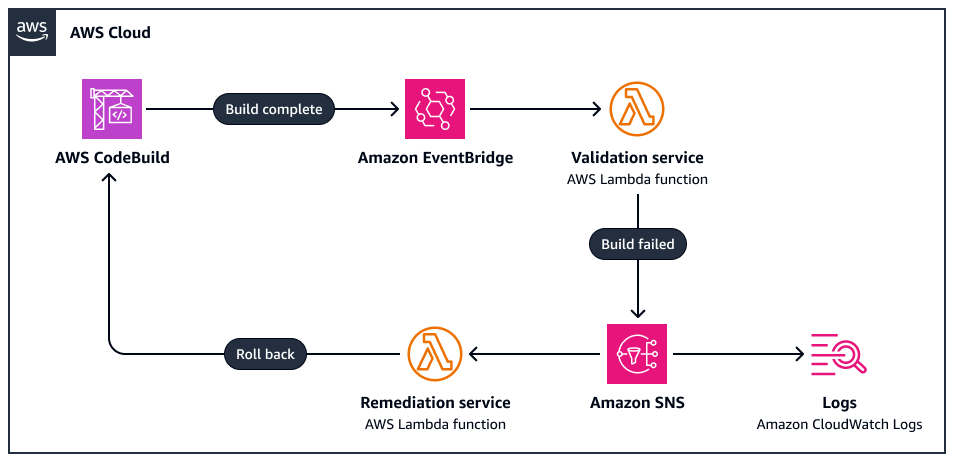

Ein Feedback-Regelkreis ist ein Muster, das seine eigenen Leistungen und Verhaltensweisen überwacht, sie anhand definierter Kriterien oder eines gewünschten Zustands bewertet und dann seine Aktionen entsprechend anpasst. Diese Architektur ist von der Regelungstheorie inspiriert und ist grundlegend für Bereiche wie Automatisierung, CI/CD-Pipelines (Continuous Integration and Continuous Delivery) und maschinelles Lernen.

Das folgende Diagramm ist ein Beispiel für einen Feedback-Regelkreis:

-

Eine Bereitstellungspipeline gibt ein BuildComplete-Ereignis aus.

-

Das Ereignis löst einen automatisierten Test- oder Evaluierungsjob aus, der den Build validiert.

-

Schlägt die Validierung fehl (z. B. aufgrund fehlgeschlagener Tests, Sicherheitsprobleme oder eines Richtlinienverstoßes), geht das System wie folgt vor:

-

Gibt ein BuildComplete-Ereignis aus

-

Protokolliert das Problem oder sendet eine Benachrichtigung

-

Löst eine Behebungs- oder Korrekturmaßnahme aus, z. B. ein Rollback, ein Patchen oder ein erneuter Versuch

-

Die Schleife wird fortgesetzt, bis ein akzeptables Ergebnis oder eine akzeptable Eskalation erzielt wird oder ein Timeout eintritt. Dieses Muster wird häufig für Folgendes verwendet:

-

EventBridge Amazon-Regeln für die Weiterleitung von Ereignissen an Evaluierungs- oder Problembehebungsaufgaben

-

AWS Step Functions für iterative Wiederholungslogik und Verzweigung der Evaluierungsergebnisse

-

Amazon Simple Notification Service (Amazon SNS) oder CloudWatch Amazon-Alarme für Feedback-Auslöser und Benachrichtigungen

-

AWS Lambda Funktionen oder Mitarbeiter in Containern, um Abhilfemaßnahmen zu ergreifen

Regelkreis für Rückkopplung (Evaluator)

Ein Evaluator-Workflow ist eine kognitive Feedback-Schleife, die von unseren Argumentatoren angetrieben LLMs wird. Der Prozess besteht aus den folgenden Schritten:

-

Ein Generator-Agent oder LLM erzeugt eine Ausgabe (z. B. einen Plan, eine Antwort oder einen Entwurf).

-

Ein Gutachter überprüft das Ergebnis anhand einer Aufforderung zur Kritik oder einer Bewertungsrubrik.

-

Auf der Grundlage des Feedbacks überarbeitet der ursprüngliche Agent oder ein neuer Optimierer-Agent die Ausgabe.

Die Schleife wird wiederholt, bis das Ergebnis eine Reihe von Kriterien erfüllt, genehmigt wurde oder ein Wiederholungslimit erreicht.

Evaluator

-

Ein Benutzer bittet einen Agenten, eine Richtlinienübersicht zu verfassen.

-

Der Generator-Agent entwirft sie.

-

Ein Gutachter überprüft den Umfang, den Ton und die rechtliche Richtigkeit.

-

Wenn die Antwort unzureichend ist, wird sie verfeinert und erneut eingereicht, bis die Feedback-Schleife zusammenläuft.

Dies ermöglicht eine Selbstbeurteilung, iterative Verfeinerung und adaptive Ausgabesteuerung — alles ohne menschliches Zutun.

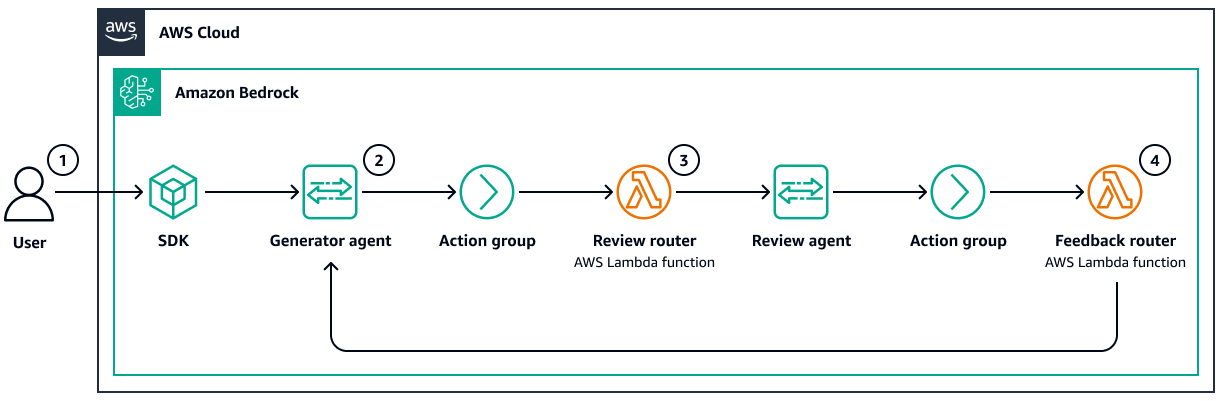

Das folgende Diagramm ist ein Beispiel für einen Feedback-Regelkreis (Evaluator):

-

Ein Benutzer gibt eine Aufgabe aus (z. B. Entwurf einer Geschäftsstrategie).

-

Ein Amazon Bedrock-Agent generiert mithilfe eines LLM einen ersten Entwurf.

-

Ein zweiter Mitarbeiter (oder eine Folgeaufforderung) führt eine strukturierte Bewertung durch (z. B. „Bewerten Sie dieses Ergebnis nach Klarheit, Vollständigkeit und Tonalität“).

-

Wenn die Bewertung unter einen Schwellenwert fällt, wird die Antwort wie folgt überarbeitet:

-

Den Generator mit einer eingebetteten Kritik erneut aufrufen

-

Senden des Feedbacks an einen spezialisierten Raffineriemitarbeiter

-

Iterieren, bis eine akzeptable Antwort erreicht ist

-

Optionale Komponenten wie AWS Lambda Controller AWS Step Functions können Feedback-Schwellenwerte, Wiederholungsversuche und Fallback-Strategien verwalten.

Imbissbuden

Während herkömmliche Feedback-Regelkreise Ereignisse, Metriken und Korrekturlogik verwenden, um das Systemverhalten zu validieren und anzupassen, verwenden behördliche Bewertungsschleifen Begründungsagenten, um Ergebnisse dynamisch zu bewerten, zu reflektieren und zu überarbeiten.

In beiden Paradigmen gilt:

-

Die Ausgabe wird ausgewertet, nachdem sie generiert wurde

-

Korrektur- oder Verbesserungsmaßnahmen werden auf der Grundlage von Feedback ausgelöst

-

Das System passt sich kontinuierlich an eine Zielqualität oder ein Ziel an

Die agentische Version wandelt die statische Validierung in eine semantische Reflexion um und ermöglicht es Agenten, sich selbst zu verbessern, ihre eigene Effektivität zu bewerten.