Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Agenten, die Computer verwenden

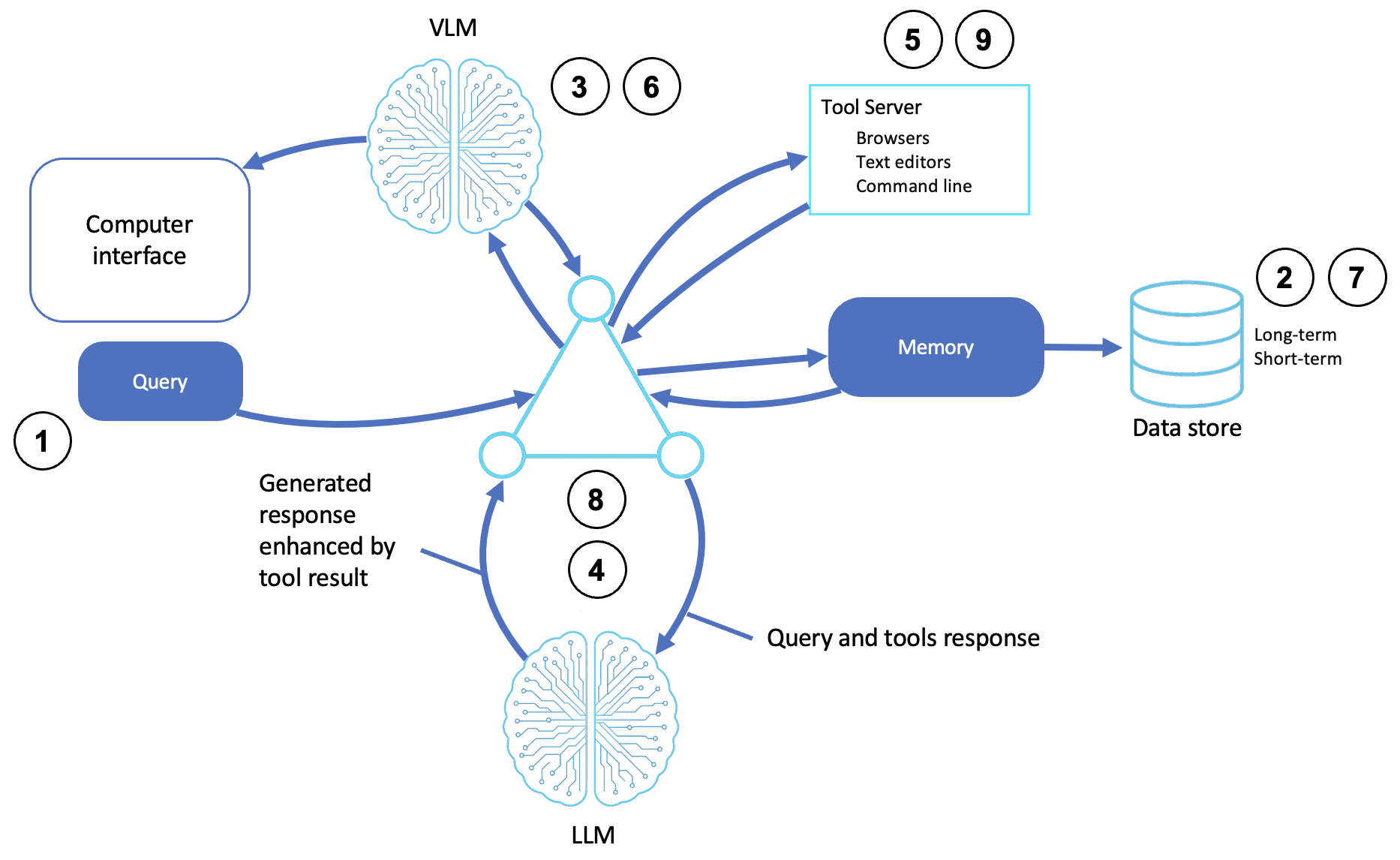

Computergestützte Agenten können digitale Umgebungen wie Browser, Terminals, Dateisysteme und Anwendungen simulieren oder steuern. Diese Agenten interpretieren Benutzerabsichten, interagieren mit visuellen und textuellen Benutzeroberflächen und führen zielgerichtete Aktionen durch, indem sie LLM-Argumentation, visuelle Sprachmodelle (VLMs) und Toolserver kombinieren, die Befehle ausführen oder Eingabeereignisse simulieren.

Dieses Muster ist wichtig für praktische KI-Automatisierungen, bei denen der Agent nicht nur als Assistent, sondern auch als Proxy fungiert, der Aktionen wie ein Mensch ausführt, häufig unter Verwendung derselben Tools und Umgebungen.

Architektur

In der folgenden Abbildung ist ein Muster für die Computernutzung durch Agenten dargestellt:

Description

-

Empfängt eine Anfrage

-

Eine Aufgabe oder Anfrage wird über eine Benutzeroberfläche, eine API oder eine Schnittstelle in natürlicher Sprache bereitgestellt.

-

-

Greift auf den Speicher zu

-

Der Agent ruft das Kurz- und Langzeitgedächtnis ab, um vergangene Befehle, Ziele und Systemzustände abzurufen.

-

-

Analysiert den visuellen Kontext

-

Ein VLM beobachtet den Computerbildschirm, den Systemstatus oder Elemente der Benutzeroberfläche, um einen bestimmten Kontext zu verstehen und umsetzbare Elemente zu identifizieren.

-

-

Gründe anhand eines LLM

-

Das LLM kombiniert die Abfrage, den Speicherstatus, das Tool und die Serverantwort, um die nächste Aktion zu bestimmen.

-

-

Interagiert mit dem Tool-Server

-

Der Agent ruft Tools auf, die auf einem Server gehostet werden. Dazu können folgende Tools gehören:

-

Browser (z. B. Headless Chrome) und Shell-Umgebungen

-

Text- und Code-Editoren

-

Benutzerdefinierte Skriptschnittstellen

-

-

-

Aktualisiert visuelle Eingaben

-

Wenn sich die Benutzeroberfläche des Systems ändert oder weitere Beobachtungen erforderlich sind, analysiert das VLM möglicherweise den Bildschirmstatus oder die Textpuffer erneut.

-

-

Aktualisiert den Speicher

-

Neue Erkenntnisse, Systemzustände oder Benutzerfeedback werden in das Kurz- und Langzeitgedächtnis geschrieben.

-

-

Formuliert endgültige Entscheidungen und Erklärungen

-

Das LLM fasst die Ergebnisse zusammen oder empfiehlt Maßnahmen auf der Grundlage der Abfrage und der Toolausgabe.

-

-

Gibt eine Antwort zurück

-

Der Agent gibt Ergebnisse an die Schnittstelle zurück (z. B. eine abgeschlossene Aufgabe, eine Bestätigung oder generierter Inhalt).

-

Capabilities

-

Multimodales Denken mit visuellen und textuellen Eingaben

-

Kontrolle über Anwendungen durch simulierte oder API-gesteuerte Eingaben

-

Speicherverwaltung für persistenten Zustand

-

Autonomie bei der Sequenzausführung (mehrstufige Abläufe)

Häufige Anwendungsfälle

-

KI-Entwickler, die Code schreiben und ausführen in IDEs

-

Computergestützte Agenten für sich wiederholende digitale Workflows

-

Simulierte Benutzer für Softwaretests und Qualitätssicherung

-

Agenten für Barrierefreiheit, mit denen Sie UIs mithilfe von Sprachanweisungen oder Anweisungen auf hoher Ebene navigieren können

-

Intelligente robotergestützte Prozessautomatisierung (RPA), die durch logisches Denken erweitert wird

Implementierungsleitfaden

-

Sie können dieses Muster wie folgt erstellen: AWS-Services

-

Amazon Bedrock für LLM-basierte Planung und Argumentation

-

Amazon Elastic Compute Cloud (Amazon EC2) oder SageMaker Amazon-Notebooks zum Ausführen von Toolservern mit simulierten Benutzeroberflächenumgebungen AWS Lambda

-

Amazon Simple Storage Service (Amazon S3) oder Amazon DynamoDB für Speicherpersistenz

-

Amazon Rekognition (oder benutzerdefinierte Modelle) für die UI-Bildanalyse in hybriden Szenarien

-

Amazon CloudWatch Logs oder AWS X-Ray für Beobachtbarkeit und Prüfprotokolle

Zusammenfassung

Agenten, die Computer nutzen, agieren als autonome digitale Operatoren und überbrücken die Lücke zwischen Interaktionen zwischen Mensch und Computer und KI-gesteuerten Aktionen. Durch die Integration von Speicher, Werkzeugorchestrierung und können diese Agenten adaptiv mit Systemen interagieren VLMs, die für Menschen konzipiert sind, Aktionen ausführen, Dateien aktualisieren, in Menüs navigieren und Antworten generieren.